AIの未来はどうなる? 日本が目指すべきAI研究・開発シンポジウムレポート

人工知能(AI)技術分野における大局的な研究開発のアクションプラン・シンポジウム―日本が目指すべきAIの社会実装の方向性― レポート

国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO)は2021年6月15日、「人工知能(AI)技術分野における大局的な研究開発のアクションプラン・シンポジウム」をオンラインで開催した。本記事では、同シンポジウムで実施されたパネルディスカッションについてレポートする。

AI産業が目指すべき方向性を提唱

自動運転車やスマート家電といった最新のIT産業から、農業・畜産業といった第一次産業、そして囲碁や将棋といった伝統的エンターテインメントに至るまで、今やAIが関わらない分野はないと言っても過言ではない。これらの研究はこれまで各国・各研究者や企業体においてバラバラに進められて発展してきたが、近年はいわゆるGAFAなどの大資本企業だけでなく、米国、中国、欧州などがそれぞれ、大規模な資本を投じて国ぐるみでの開発を進めていくようになっている。

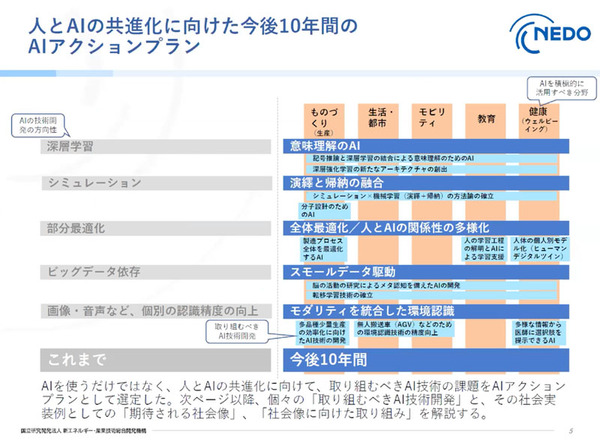

こうした動きを受けて、NEDOは今後日本におけるAI技術や関連する技術、AIを含む新技術に関する開発の方向性を大局的に検討・整理し、第6回アクションプラン策定委員会で承認された内容をもとに6月14日に「人工知能(AI)技術分野における大局的な研究開発のアクションプラン」(AIアクションプラン)として公表した。

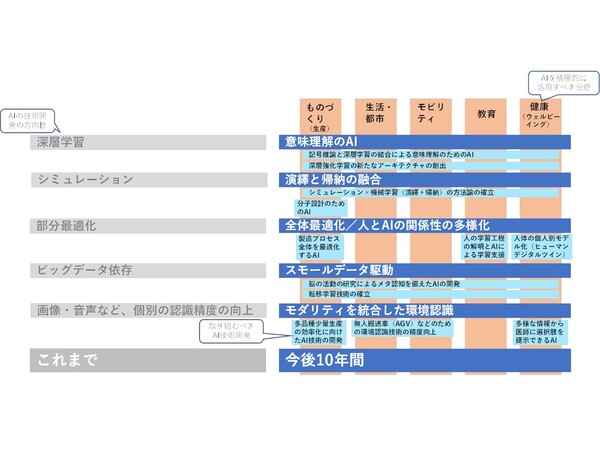

このアクションプランでは、今後AIを積極的に活用するべき分野として、農業などの第一次産業も含めた「ものづくり(生産)」「生活・都市」「モビリティー」「教育」「健康(ウェルビーイング)」の5分野をピックアップし、そこに今後注力するべきAI技術を掛け合わせ、12項目の「取り組むべきAI技術開発」を抽出している。

本シンポジウムは、学術界・産業界の有識者で構成され、同アクションプランの策定を行なった「AIアクションプラン策定委員会」の委員を招き、日本が目指すべきAIの社会実装の方向性について、パネルディスカッション形式での議論が行なわれた。

参加者は次の5名。

なお進行役は運営事務局である株式会社角川アスキー総合研究所の中西祥智氏が務めた。また当初参加が予定されていた、国立大学法人東京大学先端科学技術研究センター教授の稲見昌彦氏と、国立大学法人東京大学教授の松尾 豊氏は、都合により参加が見送られた。

AIはいつまでAIと呼ばれ続けるのか?

第一部のトークセッションは、「AIの社会実装はどこまで進んだか」がテーマ。冒頭、稲見氏の「(人工知能が)完成したらAIとは呼ばれなくなる」という言葉について、中島氏が「囲碁や将棋のプログラムでは人間を凌駕する性能になりながら、いまだにAIと呼ばれている」と指摘し、今後もAIと呼ばれ続けるのではないかと発言。

牛久氏は「人間の賢さを象徴する営みとして将棋があったのではないか」と指摘し、翻訳サービスを例に「『DeepL』は(AIを使いながら)すでに翻訳エンジンとしか呼ばれず、AIとは呼ばれていない。一方で将棋は人間のような賢さを感じるタスクなので昔からAIが存在したし、これからもAIと呼ばれ続けるのかもしれない」と予想した。

川上氏は「人間っぽい領域が大きくなると『AI』以外にいい言葉がないのではないか。自動運転でも、例えばサスペンションの制御だけならAIサスペンションとは言わないだろう」と指摘した。

これらを受けて中島氏は、「システムに組み込まれてしまわず、人間とインタラクションする部分があればAIと呼ばれるのではないか」と語った。

AIが普及すれば、当たり前のものとして目に見えなくなるかもしれないが、一方で人間らしさが重視される分野においては、ある種のインターフェースや擬人化として「AI」という言葉が残るのではないか、ということだろう。これは肌感覚として納得できる方向性だろう。

また、アクションプランの中に登場した「演繹と帰納の統合」に関して、丸山氏は「深層学習が進歩したためデータ万能主義みたいなところがあったが、今後は物理学や化学などの知識を使いつつ、データも使うようになる。社会実装の面では素材などの領域で大きなインパクトを与えるのではないか」と指摘した。

この点について、牛久氏はシミュレーションを機械学習と融合して、速度を千倍にするプロジェクトを始めたことを紹介しつつ、「演繹と帰納の統合がカギになる」と指摘。社会実装の例えとして東京大学の梅谷信行准教授の取組みを紹介し、「車のデザインでは、これまでモデルを作って風洞に入れたりシミュレーションをしたりする必要があったが、計測中、デザイナーは待っているしかなかった。これがシミュレーションの大まかな結果の予想をすぐに出せるAIが作れれば、すぐにデザイナーが動けるようになる」とした。

川上氏は、これまでAIをビジネス向けに実装してきた経験から、「シミュレーターが必須の領域について、時間やコスト的に何度もテストできないケースもある」とし、「人間の知見も加えながらシミュレーション結果を最適化できるようになればいい。演繹と帰納という形でシミュレーターがやりやすくなる環境になると感じている」と語った。

村川氏は「『ビッグデータ偏重をどう解決するか』というテーマにおいて、演繹と帰納とスモールデータ駆動が重要」であるとし、「シミュレーションの演算コストが高い領域では、機械学習をベースに少ないデータでどう学習するかを確立させる必要があり、その点においてメタ認知を備え、意味理解のできるAIが重要になってくる」と指摘。また個人的興味のある分野として「人間は抽象化して経験を新しいドメインに当てはめられる。そこをAIがうまくできるようになれば、システムに組み込まれない革新部分(=AIと呼ばれ続ける存在)になるのではないか」と述べた。

中島氏は「人間が『当たり前』と思っていることでもAIにとってはそうでない場合があり、教えなければならないことが莫大にある『フレーム問題』がある」と紹介し、生活しないと教えられないものをどうAIに教えるかが課題だとした。

【フレーム問題:AI(ロボット)に課題を実行させる際は、関係のあることだけを選び出して(フレームを設定して)取り組まなければならない。しかし人間が意識せずに当たり前のように行なっている課題でも、AI(ロボット)に対しては現実に起こりうるすべてのフレームを提示しなくてはならず、有限の能力のAI(ロボット)では対処できない。例えば自動運転でも、障害物は避ける、赤信号は止まるといったものから、ハリケーンに襲われそうなになったら突っ込まずに対処するといった、人間が意識しないフレームまであらかじめ用意しておかなくてはならない。AIにおける重要な難問の1つ。】

丸山氏は「仕様に書けない、人の心のような人工知能は、設計するのではなく育てるものと考える。『育てる』と『設計する』は直結しないので(環境を与えてもどう育つかは定かではない)、そもそも人工知能という言葉が自己矛盾しているのでは?」と指摘。

牛久氏は「フレーム問題に対して、AGIという呼び方で様々な分野のジェネラルな知能を実現しようという研究がある」と紹介。現在社会実装されているものは「弱いAI」で、機能特化している故に相対的にフレーム問題が少ないとし、「人とのインタラクションでより賢くなれるAIができれば社会実装が広がるのでは」と予想した。

日本のAI開発の障壁は?

第2部では「深層強化学習で日本はイニシアチブをとれるか」と題して、日本のAI開発の方向性や世界との比較についての議論となった。

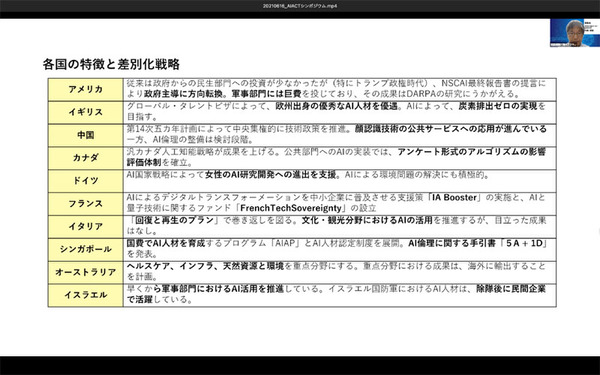

冒頭、各国のAI開発に関する調査の一覧が提示され、これに対する日本の現状に対する感想が各委員に問われた。

川上氏は「AIに限った話ではないが、日本の産業では『技術で勝って事業で負ける』と言われ続けてきた。AI分野は、技術と事業が密接に関連しており、技術で勝って事業で負けてができないと思っている。技術を使ってどうビジネスするかはもっと議論されなければならない」と指摘。また「海外、特に中印などではさまざまなPoC(概念実証)を行い、成功が見えれば、それを十数億人に広げるべく、一気にアクセルを踏むということが行われているが、日本ではまだそういった動きは少ない」と、述べた。

中島氏は「社会実装の足枷になっているのが法律の存在。法律は基本的に技術を後追いするものだが、日本では法律で規定されていないことについて『やってはいけない』というホワイトリスト方式を取るのに対し、海外(特に米国)はやってはいけないことを規定するブラックリスト方式なので、自動運転実験などでどんどん他国に遅れていく。AI開発についてはとにかく法律が壁になっている」と、率直な感想を述べた。

意味や文脈を理解できるAIは登場するのか?

続いて、出席予定だった松尾氏の代わりに中島氏が「タスクの意味と価値を理解できるAIは構築可能か」というテーマを展開。例として、AIは風土を理解しにくいため、料理の創作などは難しいことや、機械学習には学習データの隙間を突かれると騙されやすいという弱点があることを指摘。

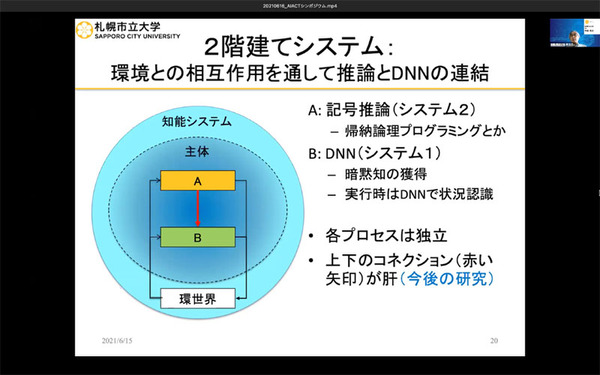

また、AIは様々な仕事の優秀な助手になり得るが、人間とは価値観が異なることから、フレーム問題や記号設置問題(シンボルグラウンディング問題)によって、タスク(ゴール)を正しく伝えられないかもしれないという問題があるという。その上で、機械学習と記号推論のハイブリッドとなる手法をとることで、騙されにくく、フレーム問題や記号設置問題を解決できるのではないかとした。

また、心理学でいうところの「システム1・システム2」というキーワードを挙げ、思考には直感的な「システム1」は速く、推論的な「システム2」は時間がかかるが、精緻な思考を伴うものがあると指摘。アルファ碁では「次の1手」はシステム1で処理しているが、加えて先読みをシステム2に近い手法で行なうハイブリッドであると紹介し、AIではシステム1を深層学習が、システム2を記号推論が受け持つべきとしつつ、システム2からシステム1へのコネクションをどう構築するかが今後の検討課題だとした。

意味理解AIの開発に対し、村川氏は「最初に着手するときに何をターゲットにするかが難しい」と指摘。目的によってシステム1・2を構成する要素も異なってくるため、「実用上役に立つものが出てくれば研究開発が活発になるのではないか」と指摘。

丸山氏は「公平性には機会(プロセス)の公平性と結果の公平性という2種類の概念がある。機械学習のレンズを通して見ると、より正確に公平性という意味が定義できるのではないか」と語り、「認知バイアスを持つシステムができれば面白いのではないか」と提案していた。

今回のシンポジウムでは、AI開発の先端を行く人材が集まっただけあって、かなりディープな話題にも触れつつ、示唆に富んだトークセッションとなった。前日に発表されたアクションプランを理解するうえでも、また将来のAI開発に関する方向性を定める上でも、有益な機会となったのではないだろうか。

本記事はアフィリエイトプログラムによる収益を得ている場合があります