Midjourneyの生成画像にDepthを加えて背景にしてみた

そして、もう1つのアプローチは、生成した画像データにDepth情報を与えることで、3Dモデルとして扱える情報に変えてしまうというものです。一度3Dモデル化ができれば、ゲーム内で静的に扱うこともできます。

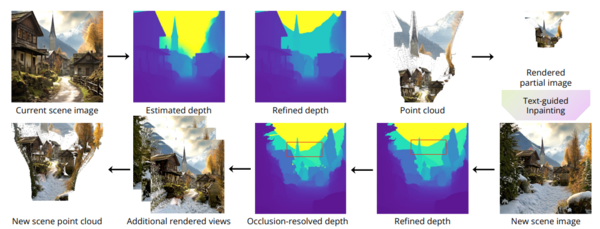

12月にスタンフォード大学とグーグルが発表した「WonderJourney」という研究では、入力されたプロンプトから連続的な3Dシーンを生成することができるとされています。

入力したプロンプトから大規模言語モデル(LLM)を使って関連要素を抽出し、Depth情報を生成。画像を立体化し、カメラ位置を動かしながら、画面に新たに入ってくるものをどんどん追加で生成していく方式です。計算量としてはかなり重いため、まだリアルタイムに動作させることはできませんが、一度生み出した世界であれば動けるようにできる可能性があります。残念ながら一般には未公開の技術なので、検証ができないのですが……。

Depthデータを利用して3Dモデルや3D空間を作ろうというアプローチは現在も続けられています。扱いが比較的簡単なためです。ただ、正面向きの画像からしか生成できないため、表示できる空間には限界があります。

#MidjourneyV6 で生成した画像をMarigoldを使ってDepthを生成、その後、Blenderで3D化。FBXにして #LumePad2 のLeiaViewerで3D表示。とてもしっかり3D立体視で出てる。これをやりたかった。 pic.twitter.com/IH5eAkMxBb

— 新清士@(生成AI)インディゲーム開発者 (@kiyoshi_shin) January 6, 2024

▲筆者が作成した、Midjourneyの画像にDepthデータを生成して、Blenderで3Dモデル化したケース。横顔の情報はないので、左頬は伸びてしまっている

空間をただ横に動くだけなどであればそれでもいいわけですが、移動をさせようと思うと、やっぱりDepthが必要です。そこでDepth情報をなんとかできるかと試してみたところ、今のBlenderの環境でも生成ができてしまいました。もちろん時間はかかりますが、そこも高速化すれば、最終的には立体空間ができてしまいます。

ということで、Midjourneyで生成した画像をもとにDepth情報を作り、3D化して、背景としてUE5に持ち込んでみたケースがこちらです。

#midjourneyV6 で背景も生成して、FBX化して #UE5 で歩けるように環境を整えてみた。Depthは結局は存在しないデータはないので、それなりに動けるようにしようとするとノビノビになってしまう。なので、直接行けない背景だと使えるけど、ゲームにそのまま取り込むのは難しいなあと改めて。 pic.twitter.com/3GbKk3rifp

— 新清士@(生成AI)インディゲーム開発者 (@kiyoshi_shin) January 7, 2024

無理やり引っ張っているので基本的に伸び伸びで、近寄ると非常に粗いんですが、そうしたアプローチを取れることはわかりました。ゲームなどに組み合わせるには使いどころが難しそうですが。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第154回

AI

ChatGPTの画像生成AIが強すぎる AI画像が世界中に氾濫する時代へ -

第153回

AI

ChatGPTの画像生成AIが「Nano Banana」超え? 漫画や動画風カットが実用レベルに -

第152回

AI

Seedance 2.0×AIエージェントでAI動画が激変 “AI脚本家”や“AI絵コンテ作家”との共同作業で、アニメ制作が身近に -

第151回

AI

画像・動画生成AIの常識が変わる、Claude Codeに全部やらせる方法論 -

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった - この連載の一覧へ