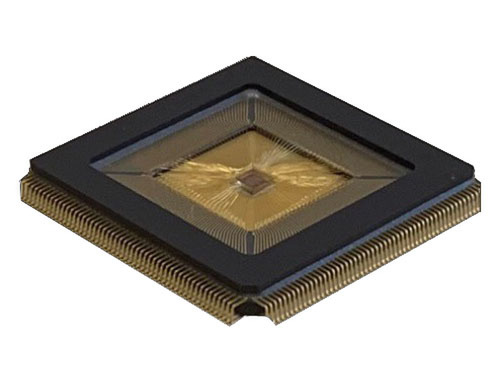

今回取り上げるEnCharge AIは、創業したのが昨年2月なので、やっと1年経ったばかりというできたてホヤホヤなスタートアップ企業である。一応プロトタイプのシリコンは存在するようだが、外部に評価用チップを出荷できるような状況ではない。

さらに言えば同社がステルスモードを抜けたのは今年1月のこと。今年1月に同社は総額2170万ドルの投資を複数のベンチャーキャピタルやファンドから受けており、これに合わせてステルスモードから抜けた格好だ。なのだが、実は同社の技術は過去6年に渡って蓄積されてきたものである。

創業者はNaveen Verma教授(CEO)とKailash Gopalakrishnan博士(Chief Product Officer)、Echere Iroaga博士(COO)の3人である。Verma教授はプリンストン大のECE(Electrical and Computer Engineering)学部の教授職を現在も継続しながらEnCharge AIを立ち上げた格好だが、CPOのGopalakrishnan博士は2022年3月まではIBMのフェロー職にあり、COOのIroaga博士はIkanos CommunicationsからApplied Micro経由で、EnCharge AIに合流直前まではMACOMでVP&GM, Connectivity Business Unitというポジションにおられた。

ちなみにApplied Microは2017年にMACOMに買収された(連載446回参照)ので、これにともなってApplied MicroからMACOMに移籍された格好だ。

長年研究してきた演算ユニット内蔵メモリーを商品化

そんなEnCharge AIであるが、核となる技術はアナログベースのCIM(Compute-In-Memory)である。実はこれはVerma教授の研究テーマでもあり、プリンストン大でVerma教授はこの技術をずっと研究してきていた。冒頭に書いた過去6年の技術と言うのは、プリンストン大の中で行なわれてきた研究をさしている。

実際この技術は2021年のISSCCで“A Programmable Neural-Network Inference Accelerator Based on Scalable In-Memory Computing”として発表されている。発表したのはHongyang Jia博士以下7名であるが、これはVerma教授の研究室のメンバーであり、それもあって最後に指導教官であるVerma教授も名前を連ねている。ここで研究してきた技術をベースに実製品を構築する目的で創業されたのがEnCharge AIというわけだ。

さてそのEnCharge AIのコアであるが、先に書いたようにアナログベースのCIMである。CIMはこれまでも何度か説明してきたように、メモリーアクセスのコスト(主に消費電力)が圧倒的に低下することもあり、性能/消費電力比を引き上げるのには非常に効果的な仕組みとなっている。

デジタルベースで言えばSamsungのPIMやSK HynixのGDDR6-AiMがそうだし、Compute-Near-Memoryで言えばCerebrasのWSEやGraphCoreのTSPやインテルの試作AIプロセッサーなど多数ある。

ただデジタルベースでは、現実的には膨大なSRAMを搭載してここに演算ユニットを埋め込む形になるので、とにかくダイサイズが巨大化するという欠点があった(CerebrasのWSEなどその極北に位置する製品である)。

別のアプローチが、SRAM以外のメモリーを利用する方式である。TetraMemのmemristorやNORフラッシュを使うMythicのAMPやSyntiantのNDPなどがその例で、メモリー素子を利用してそのままアナログ的に畳み込み演算をすることで高効率化を図るというアプローチだ。EnCharge AIのアプローチも、このアナログ演算に近いのだが、最大の違いはメモリスタでもNORフラッシュでもないことである。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第869回

PC

半導体プロセスの新たな覇権! インテルのDNNプロセッサーはAMDやMetaを凌駕する配線密度と演算密度 -

第868回

PC

物理IPには真似できない4%の差はどこから生まれるか? RTL実装が解き放つDimensity 9500の真価 -

第867回

PC

計算が速いだけじゃない! 自分で電圧を操って実力を出し切る賢すぎるAIチップ「Spyre」がAI処理を25%も速くする -

第866回

PC

NVIDIAを射程に捉えた韓国の雄rebellionsの怪物AIチップ「REBEL-Quad」 -

第865回

PC

1400WのモンスターGPU「Instinct MI350」の正体、AMDが選んだ効率を捨ててでも1.9倍の性能向上を獲る戦略 -

第864回

PC

なぜAMDはチップレットで勝利したのか? 2万ドルのウェハーから逆算する経済的合理性 -

第863回

PC

銅配線はなぜ限界なのか? ルテニウムへの移行で変わる半導体製造の常識と課題 -

第862回

PC

「ビル100階建て相当」の超難工事! DRAM微細化が限界を超え前人未到の垂直化へ突入 -

第861回

PC

INT4量子化+高度な電圧管理で消費電力60%削減かつ90%性能アップ! Snapdragon X2 Eliteの最先端技術を解説 -

第860回

PC

NVIDIAのVeraとRubinはPCIe Gen6対応、176スレッドの新アーキテクチャー搭載! 最高クラスの性能でAI開発を革新 -

第859回

デジタル

組み込み向けのAMD Ryzen AI Embedded P100シリーズはZen 5を最大6コア搭載で、最大50TOPSのNPU性能を実現 - この連載の一覧へ