アクセラレーターが3次キャッシュや

メモリーに直接読み書きできる

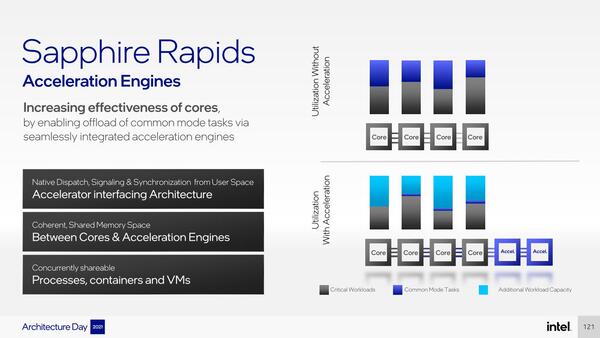

次の話がAiA(Accelerator interfacing Architecture)である。要するに、より効率的にアクセラレーターを利用できるようにするというもので、具体的にはアクセラレーターに対してキャッシュコヒーレンシなメモリーアクセスが可能というものだ。

つまりアクセラレーターが3次キャッシュやメモリーに直接読み書きを可能にできるというものだ。おそらくはCXL経由でのアクセラレーターも、このAiAに対応したものであればやはりキャッシュコヒーレンシを保つ形でアクセス可能になっているものと思われる。

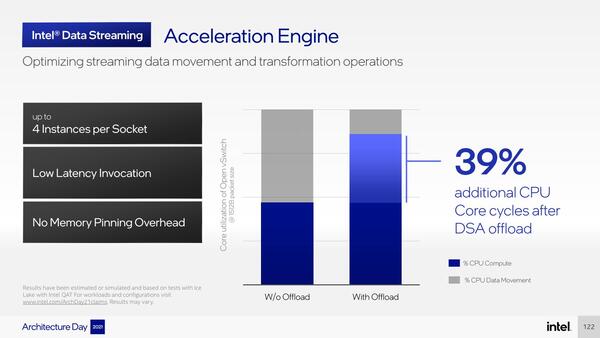

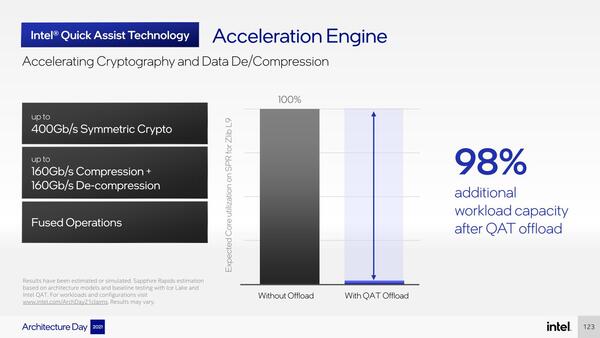

このAiAの上に載る形で、先に書いたAMXのほかにDSA(Data Streaming Acceleration)EngineやIntel QAT(Quick Assist Technology)などが搭載されるが、今回初搭載のDSAはともかく、QATそのものは以前から提供されていた技術である。ただこちらもAiAを利用することで大幅に効率が上がったようで、実にCPU処理の98%をオフロードできるとしている。

Intel DSAはインテルのウェブサイトに仕様が公開されているが、PCI Expressデバイスの転送処理をCPUに代わって実施できるアクセラレーターである

Intel QATそのものはそれこそ2013年のRangeleyにも搭載されている、古くからあるアクセラレーターだが、ここまで性能が上がったのはやはりAiA対応ではないかと思われる

多数の仮想マシンからデバイスを利用できる

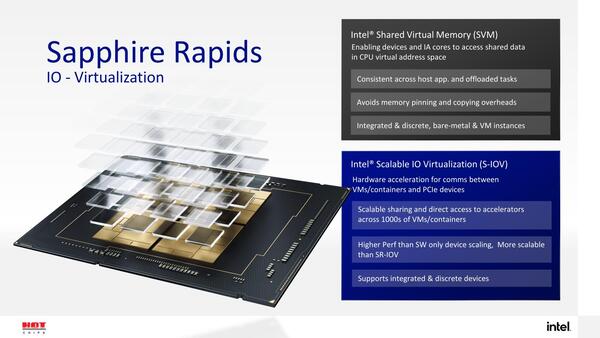

次が、これはHotChipsで発表された話だが、SVM(Shared Virtual Memory)とS-IOV(Scalable IO Virtualization)の実装である。SVMそのものは以前からあり、OpenCLなどですでに対応している

S-IOVの仕様そのものは2018年に発表されており、最新版は2020年9月のRevision 1.1となっている

おそらく今回はCXL 1.1の搭載に合わせ、CXLベースのアクセラレーターもSVMを利用できるようになった、という話だろう。一方のS-IOVは、SR-IOV(Single Root I/O Virtualization)をハードウェア的にアシストすることで、多数のVM(仮想マシン)からデバイスを利用できるようにするというものだ。

大規模なデータセンターサーバーでは、多数のVMがハードウェアを共有して使うケースは珍しくなく、ところがPCI Expressで定められたSR-IOVの機能はそれほど多くのVMからアクセスされることを想定しておらず、これがボトルネックになることがしばしばあった。これを解決するためのものがS-IOVである。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第869回

PC

半導体プロセスの新たな覇権! インテルのDNNプロセッサーはAMDやMetaを凌駕する配線密度と演算密度 -

第868回

PC

物理IPには真似できない4%の差はどこから生まれるか? RTL実装が解き放つDimensity 9500の真価 -

第867回

PC

計算が速いだけじゃない! 自分で電圧を操って実力を出し切る賢すぎるAIチップ「Spyre」がAI処理を25%も速くする -

第866回

PC

NVIDIAを射程に捉えた韓国の雄rebellionsの怪物AIチップ「REBEL-Quad」 -

第865回

PC

1400WのモンスターGPU「Instinct MI350」の正体、AMDが選んだ効率を捨ててでも1.9倍の性能向上を獲る戦略 -

第864回

PC

なぜAMDはチップレットで勝利したのか? 2万ドルのウェハーから逆算する経済的合理性 -

第863回

PC

銅配線はなぜ限界なのか? ルテニウムへの移行で変わる半導体製造の常識と課題 -

第862回

PC

「ビル100階建て相当」の超難工事! DRAM微細化が限界を超え前人未到の垂直化へ突入 -

第861回

PC

INT4量子化+高度な電圧管理で消費電力60%削減かつ90%性能アップ! Snapdragon X2 Eliteの最先端技術を解説 -

第860回

PC

NVIDIAのVeraとRubinはPCIe Gen6対応、176スレッドの新アーキテクチャー搭載! 最高クラスの性能でAI開発を革新 -

第859回

デジタル

組み込み向けのAMD Ryzen AI Embedded P100シリーズはZen 5を最大6コア搭載で、最大50TOPSのNPU性能を実現 - この連載の一覧へ