Stable Diffusion入門 from Thailand 第19回

画像生成AI「Stable Diffusion」の代替に? 話題の「FLUX.1」を試した

2024年08月07日 17時00分更新

Stable Diffusionの共同開発者たちによって設立されたベンチャー企業「Black Forest Labs(BFL)」が8月1日(現地時間)に発表した最新の画像生成AIモデル「FLUX.1」。画像生成アプリ「ComfyUI」が対応を発表しているので、ローカル環境で動くかどうかを試してみた。

画像生成AIは「Midjourney」「Stable Diffusion」「DALL-E」の三つ巴

現在、画像生成AIの分野は主に「Midjourney」、「Stable Diffusion」、「DALL-E 3」の3つがそれぞれ独自のアプローチでユーザーを集めている。

Midjourneyは直感的なインターフェースと美しい芸術的な出力で知られ、主にクリエイティブな専門家やアーティストに人気がある。

一方、Stable Diffusionはオープンソースの柔軟性と強力なカスタマイズ能力で、技術者や開発者コミュニティから支持を得ているが、最新モデルの「Stable Diffusion 3」の発表に際し、ライセンスの変更が大きな議論を巻き起こした。

DALL-E 3は、ChatGPTとの統合により、複雑な言語指示を正確に視覚化する能力で注目を集めている。

一方、FLUX.1は120億という巨大なパラメーター数を持ちながら、重みも公開されており、誰でもローカルにダウンロードして利用できるということで大きな注目を集めている。公開されているサンプル画像のクオリティーも高い。

これがローカル環境でしっかり動くなら、課金が必要な「Midjourney」や、ライセンス面で不安の残る「Stable Diffusion」の代替になるのではないかとも言われている。果たして本当に使えるのだろうか?

3つのモデルのうち2モデルはローカルPCでも実行可能

画像生成AIモデル「FLUX.1」の基本的な情報は、こちらの記事に詳しい。

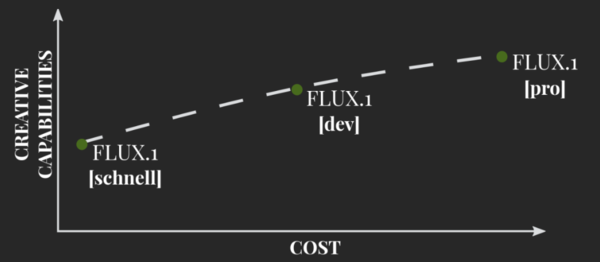

性能と用途に応じて、FLUX.1 [pro]、FLUX.1 [dev]、FLUX.1 [schnell]の3つのモデルが用意されている。FLUX.1 [pro]はAPIを通じての提供だが、FLUX.1 [dev]およびFLUX.1 [schnell]は、モデルと重みが公開されており、ローカルで画像生成を試すことができるとされている。

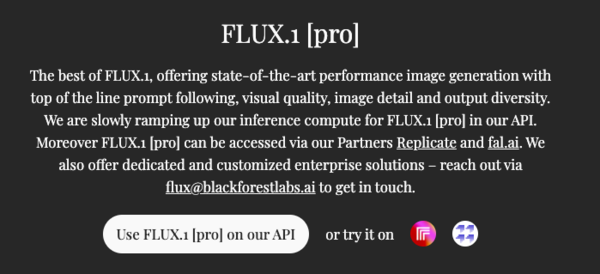

フラッグシップモデルのFLUX.1 [pro]

FLUX.1 [pro]はAPIのみを通じて提供され、商用利用も可能な最高性能のモデル。プロンプトの追従性、ビジュアルクオリティー、画像のディテール、出力の多様性など、最先端のパフォーマンスを備えた画像生成を提供するという。

APIは「Replicate」と「fal.ai」という2つの機械学習プラットフォームを介してアクセス可能だ。価格は画像生成1枚あたり0.055ドル(およそ8円)とされているが、無料枠も用意されているのでリンク先から試すことができる。

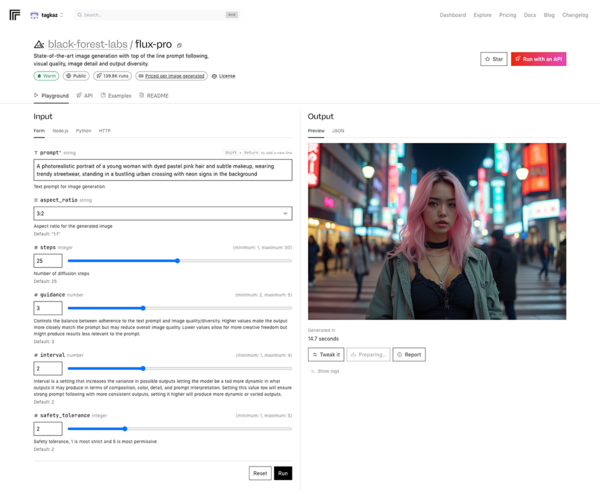

ここでは比較のため、本連載の過去記事「人気の画像生成AI、違いは? Stable Diffusion XL、Midjourney、DALL-E、Playgroundの画風を比較する」で使用した下記プロンプトで画像を生成した。

プロンプト:A photorealistic portrait of a young woman with dyed pastel pink hair and subtle makeup, wearing trendy streetwear, standing in a bustling urban crossing with neon signs in the background

さすがフラッグシップモデル。Midjourneyと遜色のないフォトリアリスティックな画像が生成された。生成時間は14.7秒だったが、Replicateはサーバー向けのNVIDIA A40を利用しているため、ローカル環境の参考にはならないだろう。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第40回

AI

Suno級がローカルで? 音楽生成AI「ACE-Step 1.5」を本気で検証 -

第39回

AI

欲しい映像素材が簡単に作れる! グーグル動画生成AI「Veo 3.1」の使い方 -

第38回

AI

最新の画像生成AIは“編集”がすごい! Nano Banana、Adobe、Canva、ローカルAIの違いを比べた -

第37回

AI

画像生成AIで比較!ChatGPT、Gemini、Grokどれを選ぶ?得意分野と使い分け【作例大量・2025年最新版】 -

第36回

AI

【無料で軽くて高品質】画像生成AI「Z-Image Turbo」が話題。SDXLとの違いは? -

第35回

AI

ここがヤバい!「Nano Banana Pro」画像編集AIのステージを引き上げた6つの進化点 -

第34回

AI

無料で始める画像生成AI 人気モデルとツールまとめ【2025年11月最新版】 -

第33回

AI

初心者でも簡単!「Sora 2」で“プロ級動画”を作るコツ -

第32回

AI

【無料】動画生成AI「Wan2.2」の使い方 ComfyUI設定、簡単インストール方法まとめ -

第31回

AI

“残念じゃない美少女イラスト”ができた! お絵描きAIツール4選【アニメ絵にも対応】 -

第30回

AI

画像生成AI「Midjourney」動画生成のやり方は超簡単! - この連載の一覧へ