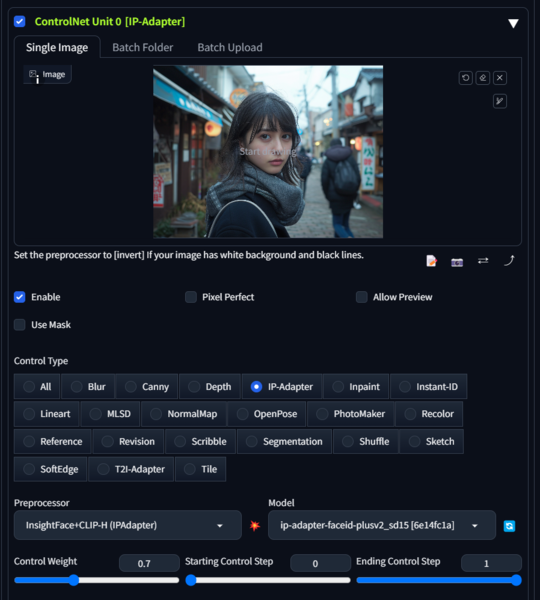

Stable Diffusion「ControlNet」IP-Adapterがベースか

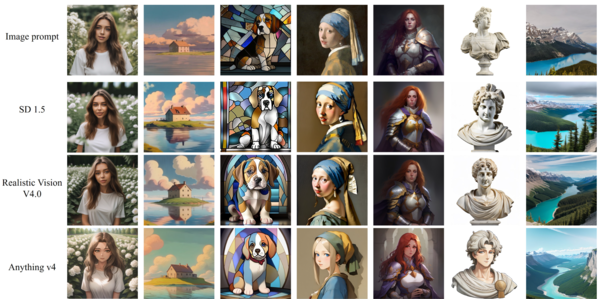

IP-Adapterは、元の画像を参考の要素を抽出して、類似の画像を生み出す。元の画像は一番上で、二段目以降は、それぞれのモデルによる生成結果の違い。

(「IP-Adapter: Text Compatible Image Prompt Adapter for Text-to-Image Diffusion Models」より)

Creative Referenceのベースは、ControlNetの新技術。昨年10月にテンセントが開発・公開した「IP-Adapter」の機能を独自拡張したものではないかと推測されます。

もともとControlNetは画像をプロンプトとして利用可能にする技術ですが、IP-Adapterは、さらにタグ解析もして、その画像と解析後のテキストの両方をセットにして画像生成をするLatent(潜在)空間に送り込み、出力する画像の結果に影響を与えるという方法です。元画像全体の全体的な雰囲気に影響を与えられる点が画期的でした。

「Stable Diffusion WebUI」や「ComfyUI」といったStable Diffusionのユーザーインターフェースには、発表から早い段階でControlNetの機能の1つとして実装されました。

その後、顔のみに影響を与えるモデル、SDXL用のバージョンも登場して、広く使われています。WebUIでは使用しているチェックポイントのモデルの影響を大きく受けるため期待するほどそっくりはなってくれない傾向がありますが、かなり雰囲気は似てくれます。

一方で、ComfyUIでは、AnimateDiffで動画を作るときに、顔や服装に一貫性を保つためのテクニックとして使わることも多いですね。

*AIアニメ: ControlNet+IPAdapterテスト #AnimateDiff#ComfyUI#aiartpic.twitter.com/ffGZbCsC9x

— Baku (@bk_sakurai) October 5, 2023

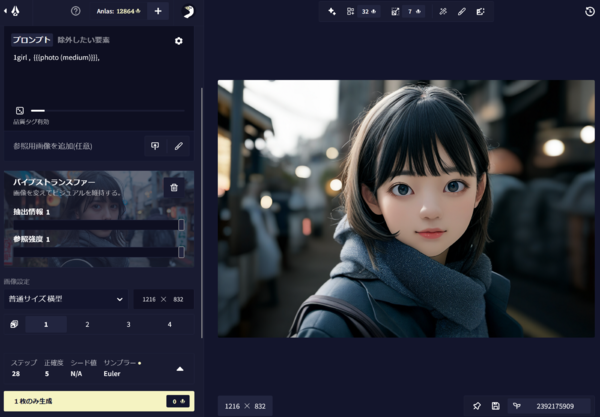

画像生成AIサービスの「NovelAI」も、IP-Adapterとほぼ同様の機能を追加しています。

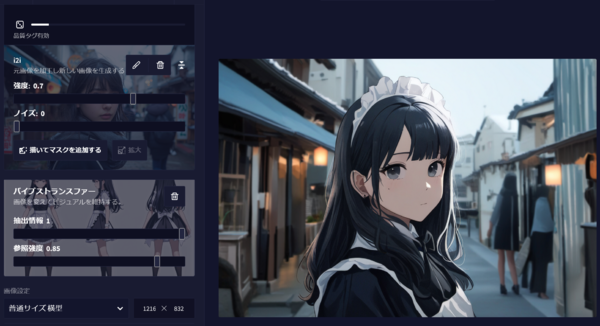

2月に新機能として実装された「バイブストランスファー」と呼ばれる機能で、ベースの画像に合わせて似た雰囲気の画像を生み出してくれるというものです。いい加減な画像を入れても、プロンプトとセットで何かの絵を生み出してくれるのは便利です。

現状、キャラだけに似せるといったことはできませんが、NovelAIにはi2iの機能があるため、特定のポーズをしたキャラクターを他の画風にするといったことが簡単にできます。

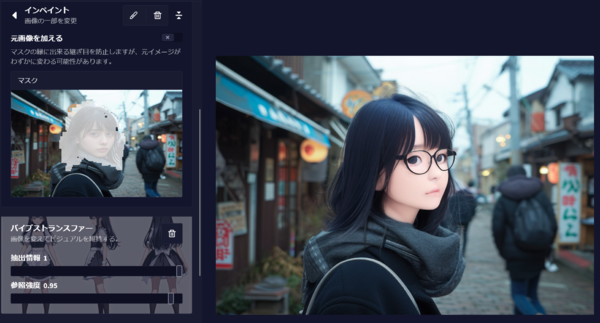

さらにNovelAIはマスクも使えるので、顔だけ囲って生成することもできます。画像が持っているニュアンスを適当に読み込んでくれるので便利です。プロンプト解析は入っていないので同じ系統のパターンを出しづらいという弱点はありますが、違った種類の画像が出せます。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? -

第140回

AI

3Dモデル生成AIのレベルが上がった 画像→3Dキャラ→動画化が現実的に - この連載の一覧へ