Stable Diffusionで動画生成「AnimateDiff」に注目

いま、AIによる動画生成はホットな分野です。

ランウェイは今年2月、動画生成に関する論文を発表していますが、実はこれを受ける形でStable Diffusionでも同様の研究発表がありました。それが7月10日に登場した「AnimateDiff」。ビデオクリップで独自に訓練した「モーション・モデリング・モジュール」という仕組みによって、首尾一貫した動画を生成可能にするというものです。

花火#AnimateDiff

— Artoid XYZ (@Artoid_XYZ) July 30, 2023

AI Art / StableDiffution pic.twitter.com/9N8ZZbHTxj

AnimeteDiffの作成例

AnimateDiffは上海AIラボ、香港中文大学、スタンフォード大学の共同研究。ControlNetを作ったチャン・リュミンさんが所属していた大学が関わっていることもあり、画像生成AIでの研究人脈も感じられますね(「画像生成AIに2度目の革命を起こした『ControlNet』」参照)。

発表時には60GBものビデオメモリーが要求されるなど動作環境のハードルが非常に高く、事実上、専用の環境でなければ動作不可能なものでした。ところが発表後わずか1週間で12GBまでビデオメモリー容量を下げる方法が見つけられ、ビデオメモリー24GBの「NVIDIA GeForce RTX 3090」以上なら動作することが確認されました。

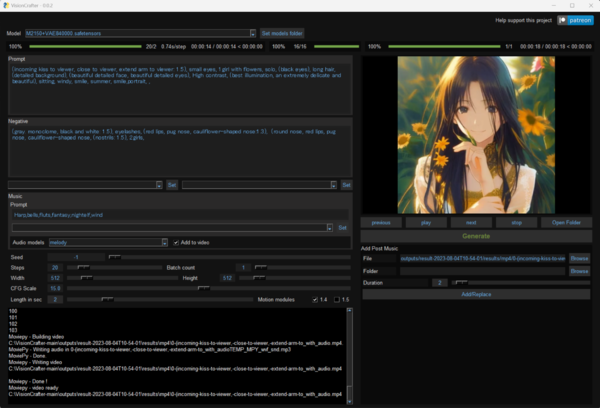

その後「Stable Diffusion web UI(AUTOMATIC1111 版)」の拡張機能として移植され、専用の独立したソフト「Vision Crafter」も登場しました。複数の画像を同時に作るという性質からビデオメモリーの要求は高く、動作環境を持つ人は限られますが、アニメ風のキャラクターであっても自然な動きを実現できる可能性が出てきています。

現在は2〜6秒程度の生成ができますが、長時間になるほど破綻する絵が出る傾向が高いようです。

AnimateDiff専用アプリ「VisionCrafter」で生成した6秒の動画サンプル。生成時間はNVIDIA GeForce RTX 4090環境で3分程度。自動生成の音楽生成機能も入っている

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第159回

AI

AIを使える人と使えない人で、とんでもない差が出ると実感した理由 -

第158回

AI

SDXLの次はこれ? アニメ特化のローカル画像生成AI、驚きの実力 -

第157回

AI

AIだけでゲームは作れるのか? Codexに7本作らせて見えた実力と限界 -

第156回

AI

ChatGPTの画像生成AIは本当に最強か Nano Bananaと比べて見えた“弱点” -

第155回

AI

非エンジニアが数百万円級のツールを開発 画像&動画生成AIツールがゼロから作れた話 -

第154回

AI

ChatGPTの画像生成AIが強すぎる AI画像が世界中に氾濫する時代へ -

第153回

AI

ChatGPTの画像生成AIが「Nano Banana」超え? 漫画や動画風カットが実用レベルに -

第152回

AI

Seedance 2.0×AIエージェントでAI動画が激変 “AI脚本家”や“AI絵コンテ作家”との共同作業で、アニメ制作が身近に -

第151回

AI

画像・動画生成AIの常識が変わる、Claude Codeに全部やらせる方法論 -

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 - この連載の一覧へ