「LivePortrait」の方が優秀との指摘も

一方、Act-Oneはいまのところ、背景が動いている画像などには適応させられません。そのため、同じようなフェイシャルを作成する環境としては、画像生成ツール「ComfyUI」用の「LivePortrait」の方が優秀なのではないかという指摘もあります。

Runway Act-One vs Kling w/ LivePortrait. I'm trying to create a music video about a vampire who has lived for centuries; called Endless Nights.

— Blaine Brown (@blizaine) October 27, 2024

Runway wouldn't let me run an image w/ blood, so I removed it for this test. I also animated the image using Kling & LivePortrait. pic.twitter.com/C5M030t6IS

生成AIを使ってミュージックビデオを制作しているBlaine Brownさんは、Act-Oneの現状の課題点を挙げています。比較として、まずAI動画サービスの「Kling」で前に進んでいる動画を作成し、その動画をLivePortraitの「Video-to-Video(v2v)」を使って顔の動きだけを別に反映させて動画を作ることで、より魅力的な動画を作り出せるとしています。

LivePortraitは、2024年7月に発表された、中国のショートビデオアプリの快手(Kuaishou Technology)と、中国科学技術大学などが共同開発したフレームワークです。高品質な6900万フレームの人物の動画データを使って、画像と動画を組み合わせた学習をしています。人物の動画から、人間の顔の動きにキーポイントを生成し、その情報から画像の動きを含んだ512x512のサイズの動画を生み出すというものです。

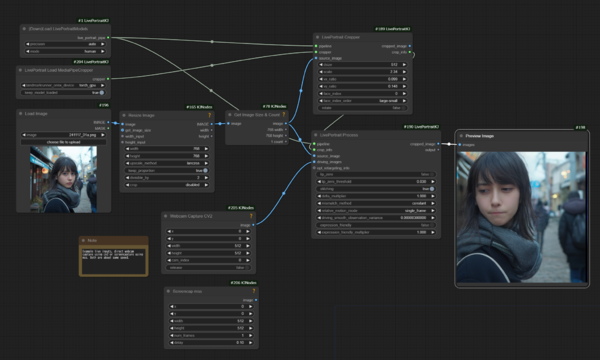

人物の動画は、目や眉、口、顔の輪郭などの形に分解される(ComfyUI-LivePortraitKJのサンプル動画より)

ComfyUIでLivePortraitを利用する方法としては(ComfyUI nodes to use LivePortrait)、3種類のワークフローが公開されており、リアルタイムでウェブカメラの動画を反映できる「Realtime with webcam feed」、画像から動画を作成できる「Image-to-Video(i2v)」、動画から表情だけに影響を与えることができる「Video-to-Video(v2v)」があります。

実際に動かしてみると、解像度が512x512と制限があることや、頭以外の動きは作れないこと、極端な動きでは不自然になるといった課題はあるものの、かなり自然に表現できています。調整するともっと自然にできると思われます。

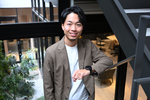

▲実際に筆者をウェブカメラでリアルタイムに撮影して反映している様子。かなり自然に表情が形作られている

▲イラスト的な画像であっても、ある程度は変換することができる。同じく筆者を撮影し、出力したものを、音声変換を行って後から合わせたもの。このような記号的な画像よりも、若干立体感が取れるもののほうが、よりきれいに出力されやすい傾向はある

ただ、筆者が比較してみた印象では、Act- Oneは、動きが小さくなる代わりに出力される動画の品質がより高い傾向にあり、LivePortraitは、より大きな表情の動きをしてくれるのですが、若干の粗さが出る傾向があるように感じられます。安定性により品質を確保するか、より動きを表現することを重視するのかという目指す目標に若干差があるようです。

この連載の記事

-

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? -

第140回

AI

3Dモデル生成AIのレベルが上がった 画像→3Dキャラ→動画化が現実的に -

第139回

AI

AIフェイクはここまで来た 自分の顔で試して分かった“違和感”と恐怖 -

第138回

AI

数百万人が使う“AI彼女”アプリ「SillyTavern」が面白い - この連載の一覧へ