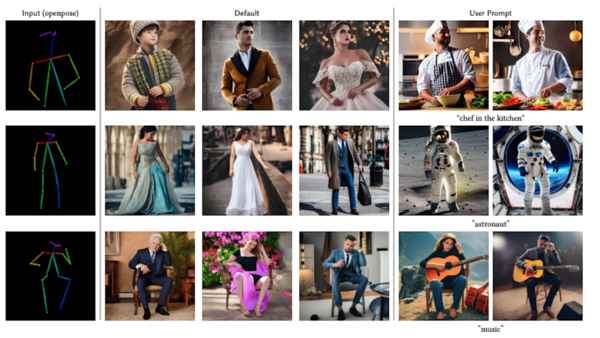

画像生成AIに対して画面上の棒人間(ボーン)を使ってポーズを指示できる「ControlNet」が発表された。米スタンフォード大学のLvmin Zhang氏とManeesh Agrawala氏により、論文と、画像生成AI「Stable Diffusion」向けの拡張機能が公開されている。

テキストでは難しいポーズ指定を棒人間で

これまでの画像生成AIは文章やコマンドといったテキストベースでの指示が基本で、ユーザーが理想とするポーズを指定することが難しかった。そのため、AIに何度もイラストを出力させて試行錯誤することも珍しくなかった。

ControlNetはこのポーズ指定の作業をGUI化したものだ。ユーザーが画面上の棒人間を動かすと、ControlNetがそれをコマンド化してAIに送る。ControlNetを使ってポーズを指定することで、ユーザーはそれ以外の指示だけをテキスト化すれば良いことになる。

開発者は米スタンフォード大学のLvmin Zhang氏とManeesh Agrawala氏で、両氏による論文のほか、GitHubではStable DiffusionのWebUI向け拡張機能も公開されている。

本記事はアフィリエイトプログラムによる収益を得ている場合があります