ソニーは29日、4万9500円で購入できる小型のモバイルモーションキャプチャー「mocopi」を発表した。ソニーストアにて12月中旬に予約開始、1月下旬の発売を予定する。発表と同時に、メタバースやVTuber界隈、VRゲーマーの注目を集めている製品だ。mocopiの発表当日はHikky社のバーチャルマーケットに関する会見でデモを実施。メディア向けの説明会も開催された。

本記事では発表会の模様とともに、「mocopiで何ができるのか」、そしてVRの全身フルトラユーザーが気になる同価格帯のShiftall社「HaritoraX 1.1」との違いについても見ていく。

500円玉サイズの小型センサー6個で

体の動きをVTuberやVRChatのアバターに反映

mocopiの概要だが、500円玉サイズの6つの加速度センサーと体に装着するためのバンドがセットになった製品だ。センサーを頭、腰、左右の腕と足の計6ヵ所に取り付け、iPhoneまたはXperiaで動作するスマホのmocopiアプリに接続して利用する。

実際の利用時は、センサーのデータをスマホのmocopiアプリが機械学習処理で最適化することで、全身の体の動きをリアルに反映したアバターの映像やモーションデータを記録できる。

さらに、モーションデータをPCなどにリアルタイム送信することで、VRChatのようなメタバース空間でアバターの全身を動かせるほか、より高度なVTuber動画撮影やXRサービスの開発といった用途にも活用できる。このため、VRChatでのフルトラと呼ばれる全身モーションキャプチャー、フルトラッキング環境を求めている人や、XRやメタバース開発者から注目されているというわけだ。

スマホだけでVTuber撮影! VRChatやばもきゃにも対応

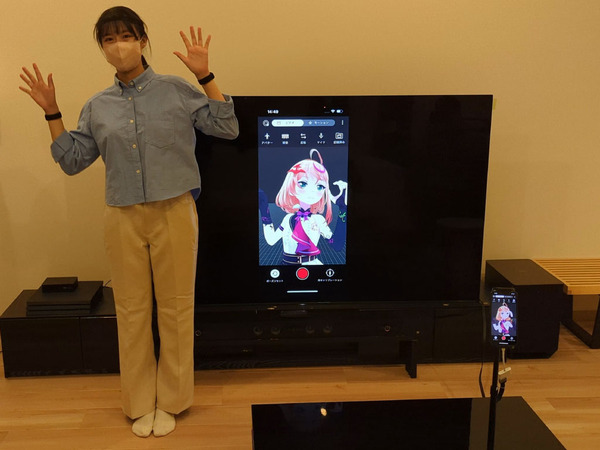

一番基本的な使い方は、前述のとおりにスマホのmocopiアプリ上で全身の動きを好みのアバター(VRM形式)に反映させ、VTuberのような映像やモーションデータを記録する用途だろう。音声とのリップシンクで口も動かせる。

最大の利点はmocopiとスマートフォンだけで使えるので、PCがなくても気軽に3DモデルのVTuberの体験や映像素材を撮れる点だ。外でのVTuber動画素材の収録や、突発的にTikTok風ショート動画の素材を作るのにも便利だろう。

メタバース用途では、VR Chat(PC版/Quest版)アプリに直接OSCに基づくモーションデータを送信し、空間内でアバターの全身を動かすことが可能になる。実際にはPCの場合だとMeta Quest2やPICO 4などのSteam VR対応のゴーグルと併用することになるという。このほか、Hikky社がバーチャルマーケットなどで活用している「Vket Cloud」も対応を表明している。

PCを用いたVTuberのモーション収録やそのほかの開発にも対応。VRゲーム実況などで使われる「バーチャルモーションキャプチャー」(通称ばもきゃ)に対応しており、このアプリをハブとして他のフェイストラッカーや指の動きを反映できるコントローラーやグローブ機器を接続すれば、アバターをよりリアルに動かすことが可能になる。なお、mocopiの開発にはバーチャルモーションキャプチャー開発者のあきら氏が参加しているという。

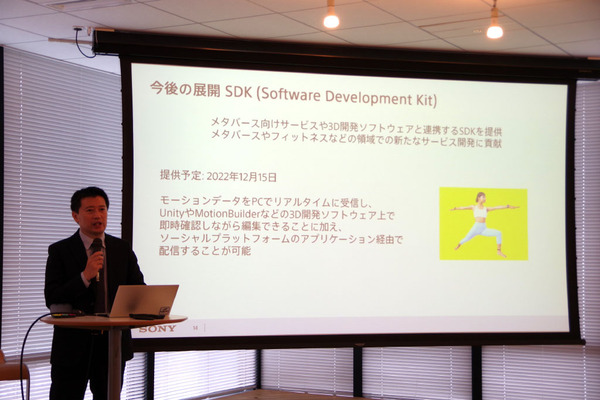

開発者サイトは12月15日公開予定。mocopi Reciever Pluginを通じてUnityとMotionBuilderに対してモーションデータをリアルタイム送信可能になる。また、12月開催のXR開発者向けカンファレンス「XR Kaigi 2022」のオンラインとオフラインの両方で登壇、展示を予定している。

ここで気になるのは、VRChat以外のメタバースやSteamVRデバイスとしての利用、SIEのPSVR2など、他の機器やサービスとは連係しないのかという点だ。この質問について相見氏は「SDKの機能のアップデートにより色々なサービスと繋いでいきたい」とした。さまざまなサービスと連携していく方向性で動いてはいるが、まだ開示できる段階ではないとのことだ。12月15日の開発者サイト公開以降は、問い合わせフォームも用意したいという。

mocopiの実機をチェック、センサー数の割にモーションは自然だ

実際の使用感だが、付属のベルトと腰用のクリップはコンパクトで一般的な服装のまま装着しやすい。センサーとベルトを分離できるので、途中で充電が必要になった場合もいちいちベルトを着脱せずに済む。

センサー部分のバッテリー持ちは約10時間、充電時間は約1.5時間だ。ケースのUSB Type-C端子から充電する。個々のセンサー重量は8gと軽量。防水(IPX5/IPX8)、防塵(IP6X)対応なのはうれしい。

センサーから送られるデータは、PCで使う場合も一度iPhoneまたはXperiaのmocopiアプリで処理したうえで送信される。センサーを接続する機器やアプリを限定することで、初心者が接続の相性といった部分でつまずきにくく、管理も簡単にしたのは有用といえる。

対応するスマホはiPhone 12シリーズ以降(SEは除く)、Xperia 1 II以降(Proは除く)と、近年の高性能なものが求められる。筆者としては、画面サイズや外部出力の利便性の面で、USB-C搭載のiPadにも対応してほしいところだ。

モーションキャプチャーとしての性能だが、センサー数が6点と頭と手足の末端の動きと腰の動きしか取得できないにもかかわらず、機械学習処理により見る限り自然な体の動きを予測して再現できていた。苦手なシーンはあるので、そこに絞って開発しているという。センサーのモーション取得は50回/秒とのことだ。

一方で気になる部分は、既存のBluetoothと加速度センサーを用いた低価格モーションキャプチャー製品と変わらないという点。接続にBluetoothを用いていることもあり、0.2~0.3秒程度は遅延する。また、加速度センサーを採用しているので、ジャンプも含めた速い動きには追従するが、極端にゆっくりとした動きや、寝転がるなど床との整合性も求められる動きは苦手とする。使い方や求める精度にもよるが、15分に1度は再キャリブレーションするのが無難とのことだ。

本記事はアフィリエイトプログラムによる収益を得ている場合があります