サム・アルトマンCEO「AIは規制すべきだ」

そんなGoogle I/Oの約1週間後、5月16日にはOpenAIのサム・アルトマンCEOが米議会の上院司法委員会の公聴会で証言に臨みました。3時間にも及んだ公聴会では、様々な議員が質問に立ち、セキュリティ、個人情報、著作権、民主主義への影響、フェイクニュース、EUの規制、対中国政策も含めた安全保障、アメリカが世界をリードするための条件、多様性をどう担保するかなど実に多様な問題が提起され、議論されました。アメリカでの議論の層の厚さを痛感させられたというのが正直なところです。やはりAIの技術開発で優位に立つプラットフォーマーを持つ国だからこそという印象を受けました。

そしてアルトマンCEOが公聴会の冒頭で打ち出したのが、IAEA(国際原子力機関)のような政府によるAIの登録と監視をする専門機関を設けるという提案でした。特にアルトマン氏は、「生成AIには通信品位法230条が適用されない」とし、「生成AIの技術を提供する企業は責任を負うべきであり、生成AIによって作られたコンテンツには全く新しい枠組みが必要である」と主張しました。この230条はSNSのプラットフォーマーがユーザーの不適切な投稿を放置しても免責される法的根拠としている非常に重要な条項です。

アルトマン氏がはっきりと言っていたのは、「アメリカが世界をリードしなければならない状況を作るべきだ」ということでした。つまり、アメリカの官民でレギュレーション(規制)を作り、国際的なルールに持っていくべきだという主張です。なぜ規制をすべきと主張しているのかというと、念頭に置かれているのはEUではないかと思います。EU議会では、AI包括的規制案(EU AI Act)が6月にも通りそうなんですよね。

訓練データの公開求めるEU

規制案の最終的な遵守事項を見てみると、「AIを利用しています」ということを明示しないといけないことや、さらに訓練データについても詳細に要約を作成して公開しないといけないことなどが書いてあります。言うまでもなく、訓練データはChatGPTやBing、Bard、さらにStable Diffusion、Midjourneyといった多くの生成AIが対象となる可能性の高い条項です。多くの企業にとっては訓練モデルを秘匿することこそが競争の源泉となりつつある面がありますし、そもそも技術的に実現可能なのかもポイントです。その上で、どうやって実効性を持たせていくのかが大きな焦点になってくると思われます。

EU議会では約2年前から議論を進めていたため、AI規制の議論で世界的に先行しています。一方、公聴会はアメリカにおけるAIに関する本格的な議論の1回目のようなもの。アルトマン氏にしてみれば、ワールドワイドの規制を自分たちが有利なように持っていこうとするならば、アメリカ政府機関によって認められるシステムのほうが有利だろうと考えたのではないかと思います。

同時に、よくある手はありますが、政府機関によって監査を受けられるようにすれば、それ自体が参入障壁になるわけですね。どの会社も政府機関に対して申請するプロセスが発生するようになると、新しい企業が参入しにくくなる。そうして標準化を図りながら、気付けば自分たちが独占するという戦略が取れると。そうした構造も彼らの頭の中にあったのではないかと思います。

議員からの発言で面白かったのは、通常、公聴会というものは企業が政府に「変な規制を作るな」と訴えるものなのに、「大企業や民間企業の代表者が我々の前に来て、規制してくれと懇願したことは記憶にない」というものです。そこは慎重に検討しなければいけない、といったことが議論されていました。

AIがでたらめな情報を発信する状況は、AIのプラットフォーマーにも責任があるとするアルトマン氏の姿勢は、公聴会でも好感を持って受け止められている印象がありました。今後、数年かけてアメリカでは議論が深められ、実際のレギュレーションへと落とし込みが行われると考えられます。

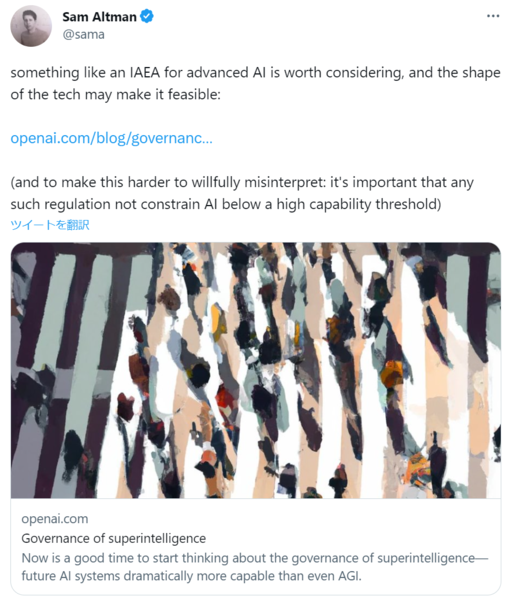

なおOpenAIは、5月22日に公聴会で示した提案を自社サイトにも掲載しています。アルトマン氏はTwitter上で、「高度なAIのためのIAEAのようなものは検討に値するし、技術の形からして実現可能かもしれない」と発言した後に、「超知能の統治」というタイトルの記事を紹介しました。記事では、「今後10年以内に、ほとんどの領域でAIシステムが専門家の技量を超え、現在の大企業に匹敵する生産活動ができるようになる」という予測のもと、「一定の能力(または計算機などのリソース)を超えた取り組みには、システムの検査、監査の要求、安全基準への準拠のテスト、展開の程度やセキュリティレベルの制限などをすることができる国際的な機関が必要である」としています。企業が自主的にレギュレーションを開始して、それが国家レベル、そしてグローバルで共通なレベルなものにまで拡張すべきだと強く主張しています。

一方で、「私たちは、企業やオープンソースプロジェクトが、ここで説明するような規制を受けずに、重要な能力に達していないモデルを開発することを認めることが重要だと考えています」と、自由な研究ができる余地を確保するレギュレーションの範囲にバランスを保つ重要性についても述べています。何をもって「重要な能力に達していない」と判断するのかは現時点ではわかりませんが、オープンソースが進めるイノベーションのパワーの重要性を認めているともとらえられます。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第159回

AI

AIを使える人と使えない人で、とんでもない差が出ると実感した理由 -

第158回

AI

SDXLの次はこれ? アニメ特化のローカル画像生成AI、驚きの実力 -

第157回

AI

AIだけでゲームは作れるのか? Codexに7本作らせて見えた実力と限界 -

第156回

AI

ChatGPTの画像生成AIは本当に最強か Nano Bananaと比べて見えた“弱点” -

第155回

AI

非エンジニアが数百万円級のツールを開発 画像&動画生成AIツールがゼロから作れた話 -

第154回

AI

ChatGPTの画像生成AIが強すぎる AI画像が世界中に氾濫する時代へ -

第153回

AI

ChatGPTの画像生成AIが「Nano Banana」超え? 漫画や動画風カットが実用レベルに -

第152回

AI

Seedance 2.0×AIエージェントでAI動画が激変 “AI脚本家”や“AI絵コンテ作家”との共同作業で、アニメ制作が身近に -

第151回

AI

画像・動画生成AIの常識が変わる、Claude Codeに全部やらせる方法論 -

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 - この連載の一覧へ