CEVA Inc.はDSP Groupの

プロセッサー販売専門会社

話を戻すと、DSP Groupはやはり音声向けDSPを、主に電話、それも音声自動応答システムやビジネスホンなど、高付加価値系の電話や、初期のデジタルコードレスホンなど投入するとともに、携帯電話ビジネスにも参入していく。

このうちコードレスホンのビジネスはAMDに、携帯電話ビジネスはインテルにそれぞれ買収された。DSP Groupそのものはマルチメディア系やWi-Fi、ケーブルモデムなどにフォーカスしていくが、この途中でDSPのコアそのものをIPとして外販するビジネス部隊を独立させた。これがCEVA Inc.である。

ちなみにDSP Groupそのものは2007年にNXPに買収されてしまっており、現時点ではCEVAが唯一残ったビジネスユニットということになる。CEVAそのものはまだ創業20年に達していないが、DSPそのものは30年以上に渡って手掛けてきたという、やや辻褄が合わないことになっている。

というわけでそのCEVAの話だ。同社はArmと同じくDSPのIPを提供するベンダーであり、目立たないところ、例えば携帯電話の無線側の処理を行なうベースバンドチップなどには、一時期90%を超えるシェアを獲得するなど、かなり広い範囲で利用されていた。

また、ここ数年は音声向けとしてヘッドフォンなどにも広く使われるようになってきている。そうした中で同社が見つけた新たな市場がAI/ML向けだったというわけだ。

先にも出てきたがDSPはとにかく積和演算を高速に処理するのが主目的のプロセッサーであり、そしてAI/MLの中でも特に畳み込みニューラルネットワークなどは積和演算が非常に多いわけで、どう考えてもDSPで処理するのにぴったりとなる。

そこで、CEVAはまず同社の既存DSP IPの上で動作するCDNN(CEVA Deep Neural Network)というソフトウェアフレームワークを2015年に発表した。

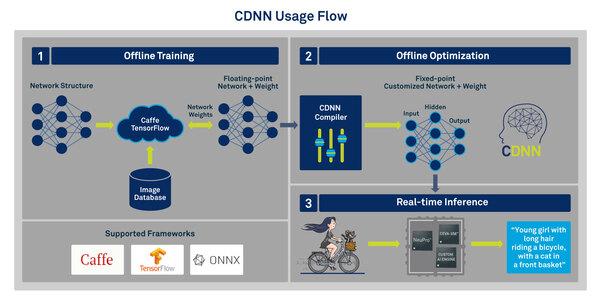

CDNNは下の画像にあるように、まず既存のCaffe/TensorFlow/ONNX(ONNXは2018年に追加された)といったフレームワークで学習を行ってネットワークを構築する。この構築されたネットワークを、CDNNコンパイラを使って変換することで、CEVAのDSP上で動作する仕組みだ。

このCDNN、当初想定していたのはCEVAが2015年3月に発表したCEVA-XM4というDSP IPである。

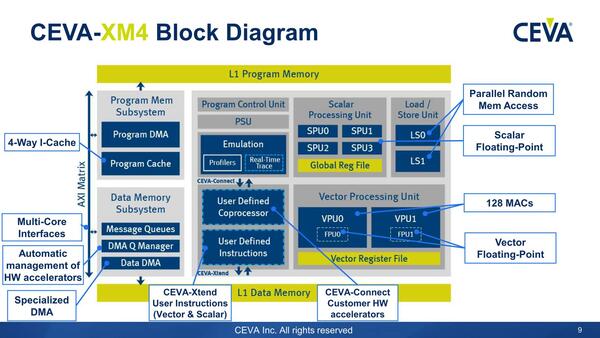

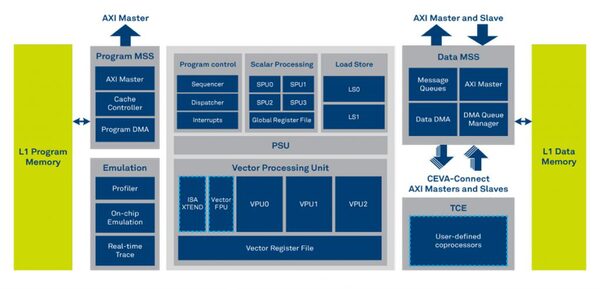

4つのスカラーエンジンと2つのベクトルエンジンを持つこのDSP、スペックとしては以下の特徴を持つ。

- 最大128MAC構成で、それぞれが8-wayのVLIWになっており、最大構成だと4096bitのベクトルを処理できる。

- 内部パイプラインは14段。TSMCの28nm HPMで1.5GHz動作を保証

- メモリーアクセスは32wayのインターリーブで、それぞれ独立にアクセス可能

- 2次元メモリーアクセス(行列の転置やFFTなどで、行と列をひっくり返してアクセスする)をサポートするSliding Window/Sliding Patternをメモリーアクセスでサポート

- 8/16/32/64bitの浮動小数点と固定小数点演算をサポート。スカラーでは浮動小数点/固定小数点ともに4 MACs/サイクルだが、浮動小数点で16 MACs/サイクル、ベクトルでは128 MACs/サイクルの処理が可能

- 特殊計算(1/x、√x、1/√x)を1サイクルで処理できる

もともとCEVA-XM4は画像処理向けとして開発されたもので、当初の目的は例えば3D Vision(ステレオカメラを利用して対象物の3次元イメージを構築)や、カメラ画像の補正(超解像、デジタルズーム、輝度拡張、スタビライジング)などを目的にしていた製品だが、CDNN発表後にはこれに加えて物体認識や対象物追跡、物体分類や汎用の畳み込みニューラルネットワークなども目的に追加されることになった。

CEVA-XM4の後継として2016年に投入されたのがCEVA-XM6である。基本的にはまだVision DSPというカテゴリー向けの製品ではあるが、特に畳み込みニューラルネットワークの処理に向けて最適化を図っており、ベクトル処理でCEVA-XM4比で3倍、平均で2倍の性能改善を施し、かつ制御コードの柔軟性も50%増加したとされる。

またCEVA-XM4で動くコードはそのままCEVA-XM6でも動作するとしている。TSMCの20nmで試作された690MHzで動作するCEVA-XM6とNVIDIAのTX1でのAlexNet/GoogleNetの処理性能の比較では、CEVA-XM6の性能が4倍、性能/消費電力比が25倍になったという数字も示されている。

CDNNもCNDD2にバージョンアップされ、ワンボタンで変換が可能になったほか、対応するネットワークの数も大幅に増えた。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第868回

PC

物理IPには真似できない4%の差はどこから生まれるか? RTL実装が解き放つDimensity 9500の真価 -

第867回

PC

計算が速いだけじゃない! 自分で電圧を操って実力を出し切る賢すぎるAIチップ「Spyre」がAI処理を25%も速くする -

第866回

PC

NVIDIAを射程に捉えた韓国の雄rebellionsの怪物AIチップ「REBEL-Quad」 -

第865回

PC

1400WのモンスターGPU「Instinct MI350」の正体、AMDが選んだ効率を捨ててでも1.9倍の性能向上を獲る戦略 -

第864回

PC

なぜAMDはチップレットで勝利したのか? 2万ドルのウェハーから逆算する経済的合理性 -

第863回

PC

銅配線はなぜ限界なのか? ルテニウムへの移行で変わる半導体製造の常識と課題 -

第862回

PC

「ビル100階建て相当」の超難工事! DRAM微細化が限界を超え前人未到の垂直化へ突入 -

第861回

PC

INT4量子化+高度な電圧管理で消費電力60%削減かつ90%性能アップ! Snapdragon X2 Eliteの最先端技術を解説 -

第860回

PC

NVIDIAのVeraとRubinはPCIe Gen6対応、176スレッドの新アーキテクチャー搭載! 最高クラスの性能でAI開発を革新 -

第859回

デジタル

組み込み向けのAMD Ryzen AI Embedded P100シリーズはZen 5を最大6コア搭載で、最大50TOPSのNPU性能を実現 -

第858回

デジタル

CES 2026で実機を披露! AMDが発表した最先端AIラックHeliosの最新仕様を独自解説 - この連載の一覧へ