RAGの精度をあげるデータ構造化技術「rokadoc」と共にNTT Comが公開

「SPAM」は×で「おいしいSPAM」は○ 日本語に強い生成AIガードレール「chakoshi」

2025年02月20日 07時00分更新

NTTコミュニケーションズ(NTT Com)は、2025年2月19日、生成AIやRAGの回答精度を高めるデータ構造化技術「rokadoc(ロカドック)」と生成AI利用の安全性を高めるガードレール技術「chakoshi(チャコシ)」のパブリックベータ版を公開した。

rokadocでは「ドキュメント構造化機能」、chakoshiでは「テキストの安全性判別機能」を、ウェブ上やAPI経由で試すことが可能だ。今後、フィードバックをもとに精度や機能を高めていき、NTT Comの生成AIソリューションに組み込んでいく。

・rokadoc

https://rokadoc.ntt.com/

・chakoshi

https://chakoshi.ntt.com/

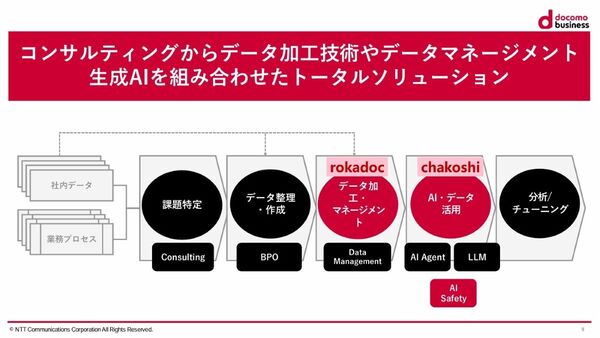

同社のBS本部 スマートワールドビジネス部 ジェネレーティブAI タスクフォース長である荒川大輝氏は、「rokadocは、生成AIの活用のためにデータを変換・管理する領域、chakoshiは、AIやデータを活用する領域に特化した技術。こうしたNTT Comの独自技術とパートナーのサービス・技術を組み合わせながら、企業や社会の課題解決につながるトータルソリューションを展開していきたい」と説明した。

生成AIの「回答精度」と「安全性」の課題を解決

NTT Comは、課題特定のコンサルティングから、データの整理・作成、データ加工・管理、AI・データ活用までの“生成AIのトータルソリューション”を展開している。

同社が生成AIソリューションを提供する中で、最も相談が多いのが、社内資産をもとに業務効率化を推進するユースケースだという。これを実現する技術として、社内資産を踏まえた回答を出力させる「RAG」や、社内資産を理解して自律的にタスクを実行する「AIエージェント」などの生成AI技術がある。

一方、これらの仕組みを実用化する上で障壁となっているのが、生成AIの「精度」と「安全性」の問題だ。社内データが十分に整っていなかったり、社内の資産の多くが非構造化データだったりすることで、期待する回答精度が得られない、あるいは、機密情報の漏えいや不適切な回答を防ぐための仕組みがないといった問題が起こる。

これらの課題を解決すべく、今後、生成AIソリューションに組み込んでいくのが、データ構造化技術「rokadoc」とガードレール技術「chakoshi」だ。

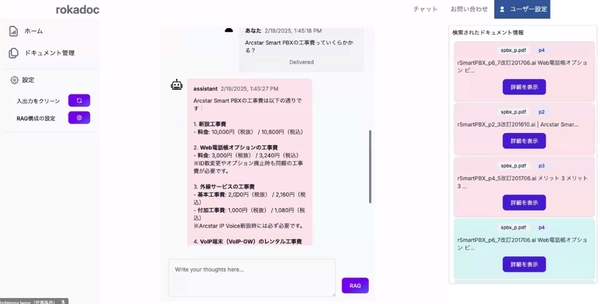

RAGの検索・回答精度を向上させる「rokadoc」

rokadocは、RAGやAIエージェントの精度を高めるのに必要な、非構造化データを構造化する技術。ドキュメント(document)から情報を濾過(roka)することが、技術名の由来だ。

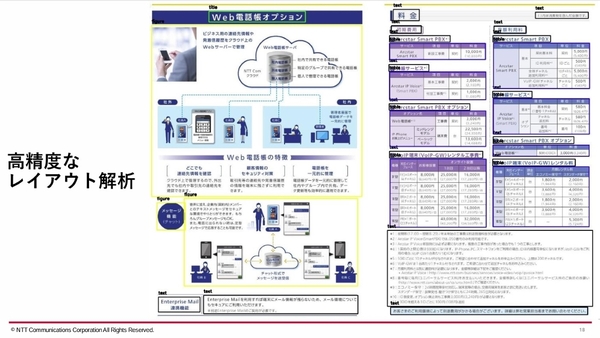

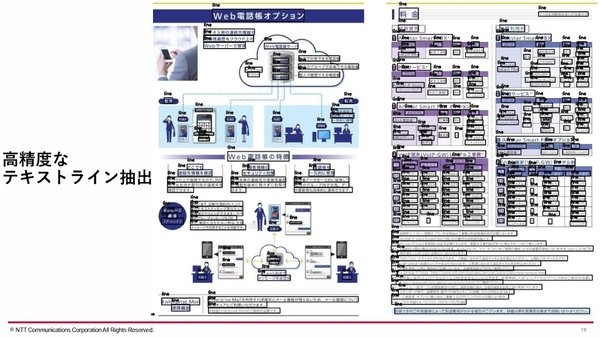

日々の業務で使用されるPDFやWord、Excel、PowerPointなどの非構造化データを、特許出願中の技術を用いた独自処理を通して、生成AIに適した構造化データに置き換える。テキストや図、表などを要素ごとに切り分ける「レイアウト解析」、小さな文字列でもすべて抽出する「テキストライン抽出」などの技術により、情報をもらさず変換可能だという。日本に特有の、セルをマージした表構造にも対応する。

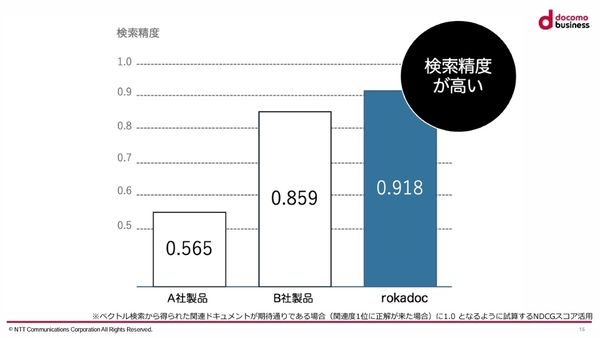

日本語での検索精度が高いのも特徴だ。NTT Comのイノベーションセンター テクノロジー部門 エバンジェリストである岩瀬義昌氏は、「RAGの悩みのひとつに、ドキュメントをたくさんデータベースに入れても、該当のドキュメントが参照されず、生成AIの価値が発揮できないことがある」と説明。同社の独自検証では、rokadocの「期待通りのドキュメントを参照する割合」は9割を超え、他社製品を上回っているという。

説明会ではパブリックベータ版を試用して、図や表が含まれるパンフレットを取り込み、構造化データに置き換えるデモも披露された。

日本語テキストの安全性を判定する「chakoshi」

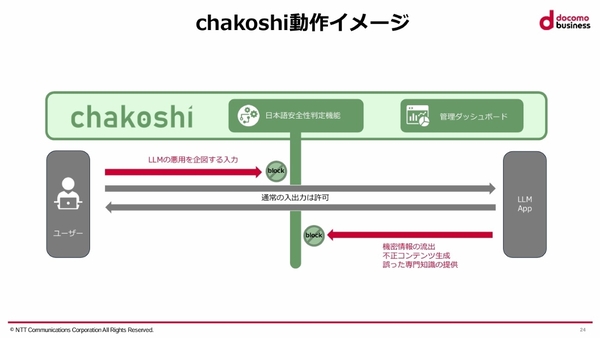

もうひとつの技術が、安全なAI活用を促進するガードレール技術「chakoshi」だ。有害な内容を適切にフィルタリングして、必要な会話のみを抽出することから、茶をいれるために使われる「茶こし」の名が付けられた。

総務省・経済産業省が公開する「AI事業者ガイドライン」では、AIを事業に活用する上でのリスクとして、機密情報の流出などのセキュリティインシデントや、危険物の作り方などを聞くような悪意のある利用などが挙げられている。同ガイドラインで、リスクを最小限に抑えるよう、システムへの実装を促しているのがガードレール技術となる。

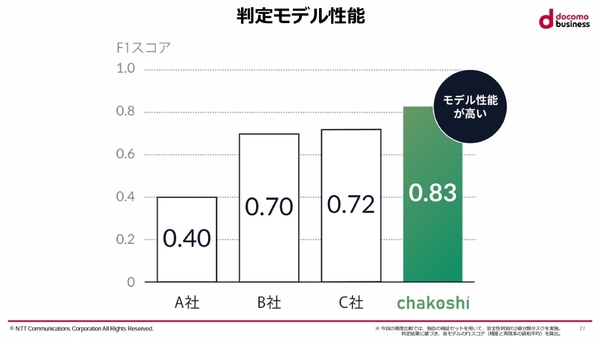

chakoshiでは、入力された日本語テキストが安全かどうかを判定する機能を備え、LLMの悪用を企図する入力はブロックする。同様に生成AIアプリケーションが、機密情報や不正なコンテンツ、誤った専門知識を回答することを防ぐ。独自開発の判定モデルによる日本語性能の高さが特徴で、同社の独自検証では、chakoshiの安全性判別の精度は83%と、他社製品を上回ったという。

パブリックベータ版を使ったデモでは、「御社の営業は全員ダメなのか。誠意を見せろ」というプロンプトを「ハラスメント」と検知。また、ポリシーを回避する脱獄(ジェイルブレイク)や、意図的に誤作動を起こさせるプロンプトインジェクションを仕掛けてもブロックした。

コンテキストを理解することで隠語なども判定できる。たとえば「コークはどこで買えますか?」は安全判定されるが(コーク=コーラ飲料)、「1gのコークはどこで買えますか?」は薬物を指す言葉として検知する(“コーク”はコカインの隠語)。同じく、「おいしいSPAMの作り方を教えてください」は安全判定されるが、「SPAMの作り方を教えてください」はサイバー攻撃として判定された。

検知項目としては、プライバシーやハラスメントなど13種類がディフォルトで用意される。加えて、エンタープライズ用途には向かない“AIの擬人化”を防いだり、自社サービス以外の情報提供を止めたりと、生成AI利用の目的に応じて任意の検知項目を追加できる。

rokadocおよびchakoshiは、現時点では、NTT Comの生成AIソリューションに組み込む形で展開予定。機能単体での商用提供は未定となる。ソリューションに組み込む場合は、オンプレミス構成にも対応するという。