動画生成AIの発展により、非常に面白い方向性が生まれてきています。最新の動画生成技術と3D技術を組み合わせることで、たった1枚の絵から、3Dデータを作れるようになる可能性が出てきているんですね。これは将来のゲーム開発や映像制作のあり方を激変させる可能性があります。

※記事配信先の設定によっては図版や動画等が正しく表示されないことがあります。その場合はASCII.jpをご覧ください

動画生成AI「Runway」新機能がきっかけ

まず、この動画を見てください。Stable Diffusionを使って作成した1枚の画像を、いくつかの手順を実施することで、3Dモデルとして扱えることに成功している様子です。

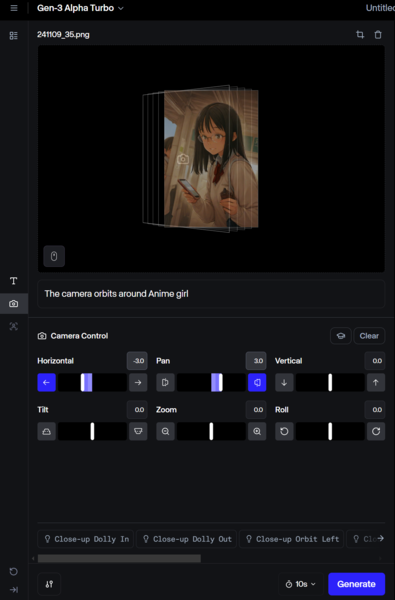

こうしたことが実現できるようになったのは、動画生成AIサービス「Runway」に11月2日に追加された新機能「カメラコントロール機能(Advanced Camera Control)」のためです。1枚の画像に対して、最大10秒の生成される動画にカメラの動きをかなり詳しく指定できるようになりました。左右方向の回転や、上方向へのチルト、ズーム(拡大)などの操作ができてしまう。

これまでもプロンプトでも指定できましたが、ランダム性が高く、正確な制御は難しいものでした。そして、実写のみならず、アニメ系の画像であっても動かすことができたりします。この機能が先進的なのは、人物やキャラクターの「一貫性」を維持できている点です。これまでの動画生成AIではこうしてカメラを動かすと、途中から別の人物に変化するといった破綻が起きる傾向がありました。

この動画では、最初の1枚の画像以外はすべてカメラコントロール機能で生成しています。背負っているバックパックといったものは情報として持っていないので、勝手に描かれてしまうので形状は変わってしまうのですが、それでも、かなり一貫性が維持されており、スカートのひだも崩壊したりしていません。

次の動画では、同じくカメラコントロール機能で、カメラを動かしています。3種類の画像を使い、それぞれの起点となる1枚の画像を中心に左右に動かし、合成しています。細かく見ると破綻を見つけることができるのですが、それでも、イラスト風キャラクターに対し、ある程度の一貫性を保って角度の違うキャラクター描写ができています。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? -

第140回

AI

3Dモデル生成AIのレベルが上がった 画像→3Dキャラ→動画化が現実的に - この連載の一覧へ