二次元画像を“三次元”にする技術に派生

そしてさらに、ここにも応用例が出てきています。toyxyzさんが発表した、「Line2Depth」というLoRAです。

これは、かたらぎさんの技術を参考にして、アニメ塗り専門のControlNetのDepth(深度)を生成しようという試みです。一般的に深度生成をする場合には、写真などを使って学習します。しかし、写真が学習元であることもあり、「Marigold」といった性能の高い深度アルゴリズムでも、アニメ系の2D画像では、うまくDepthを生成することができませんでした。そもそも立体感が存在しないものなので難しいのも当然です。

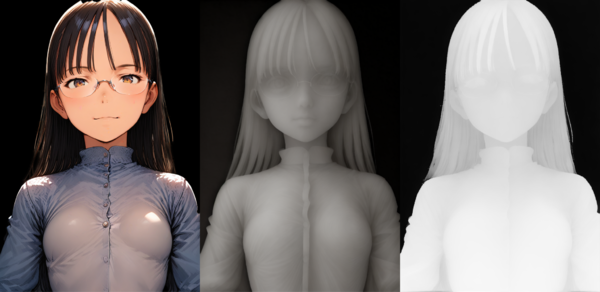

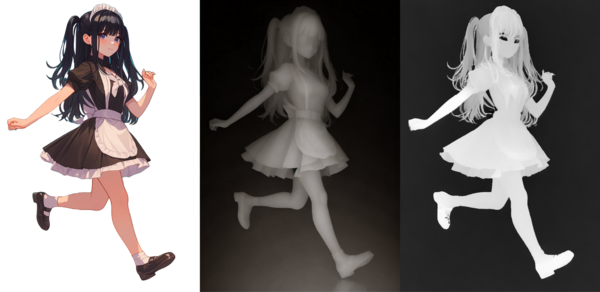

左から、オリジナル画像(背景は認識しやすいように削除してある)、Line2Depth、Marigold。Line2Depthが精度高く奥行き感を生成できている。精密に出力されるもののアニメ画像は得意でないMarigoldは平板な印象がする

ところが、Line2Depthはその問題を解決し、アニメ的な2D画像にきちんと奥行き感のある深度データを作ることに成功したのです。キャラクターデータを使って学習させていることから、背景に対しては深度情報を正しく生成できないという問題はあるのですが、これまでとは一線を画するほどにディティールのある深度情報画像が生成できます。

深度情報は、立体視環境のデータとしても扱えるので、作成したデータを裸眼立体視デバイスの「Looking Glass Portrait」に出力してみました。動画でもはっきりと、顔や体のラインが立体化しているのがわかると思います。これはMarigoldの出力データでは、もっと平板になってしまうのでここまで立体感がはっきりと出ません。

Line2Depth @toyxyz3 さんので既存のアニメ風画像用のDepthを作り #LookingGlassPortrait に出力してみた。アニメ風画像を立体視で出すのは過去最高レベルの立体感。SD Webui Forgeで作成 pic.twitter.com/AtgUFgtPSe

— 新清士@(生成AI)インディゲーム開発者 (@kiyoshi_shin) April 17, 2024

△筆者のLooking Glass PortraitにLine2Depthで生成した画像を表示した状態

当然、この情報は3D情報として組み込んでいくことができるので、3Dソフトにも組み込めます。まだまだ、潜在的な応用範囲の広さを予感させる技術でもあります。

画像生成AIの革新が“ホビー”から生まれている

興味深いのは、AI-Assistantをめぐる技術発展は、専門の研究者から登場したのではなく、在野のホビーユーザーが中心となって生み出されたということです。論文や学会といった場で発表されないために、情報の伝播には限界はあるのですが、それでも、インターネットを通じての技術革新が進み、新しい表現方法の発見が進められています。

画像生成AIは、単純に画像を生成するという技術は、すでにありふれたものになりつつあります。ControlNetやLoRAの開発手法や学習手法の確立が進んできたことで、よりポストエフェクト的な効果の開発に広がりつつあります。AI利用者の表現の選択肢の広がりがさらに進んできています。より複雑な表現を求める利用者と技術者とのキャッチボールによって、技術の成長が続いています。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第151回

AI

画像・動画生成AIの常識が変わる、Claude Codeに全部やらせる方法論 -

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? - この連載の一覧へ