米連邦政府は7月21日(現地時間)、生成AIを手掛ける米主要7社の代表をホワイトハウスに招集、AI技術開発において「安全性」「セキュリティー」「信頼性」を重視することで合意。生成AIが作成したコンテンツに「AI製(AI generated)」と明示させるシステムの開発など自主的な取り組みを確保したと発表した。

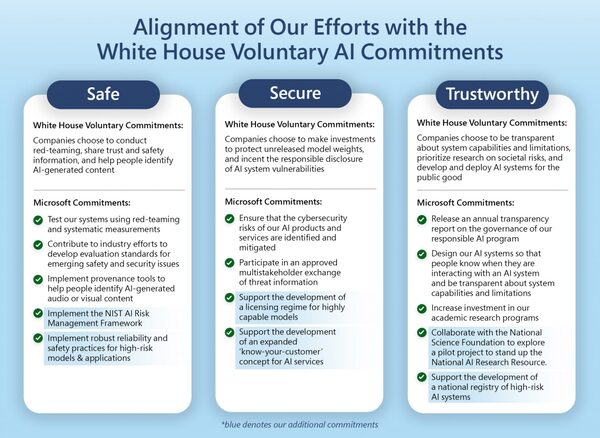

「安全性」「セキュリティ」「信頼性」の3本柱

招集されたのは、アマゾン、グーグル、メタ、OpenAI、Anthropic、Inflection AIの5社。AnthropicとInflection AIはまだ日本での知名度は低いが、前者は「Claude 2」、後者も「Pi」というAIチャットボットを公開しており両社共に大規模言語モデル(LLM)も開発している。合意内容は下記の通り。

「リリース前に製品の安全性を確認」各社はAI製品のリリースに先立ち、社内外のセキュリティテストを実施。リスクや広範な社会的影響から保護する。

各社は、AIのリスク管理について業界全体および政府、市民社会、学界と情報を共有することを約束する。これには、安全性に関するベストプラクティス、セーフガードを回避しようとする試みに関する情報や技術協力も含まれる。

「セキュリティ第一のシステム構築」各社は、大規模言語モデルのモデルウェイト(パラメーターの重み)を保護するための保護措置に投資することを約束する。

モデルウェイトはAIシステムの最も重要な部分であり、意図された場合にのみセキュリティリスクを考慮した上で公開することが重要であることに同意する。また、AIの脆弱性を第三者が発見・報告することを促進する。

「一般の信頼を得る」各社は、電子透かしなど、AIによって生成されたコンテンツであることをユーザーが確実に認識できる強固な技術を開発することを約束する。これはAIを用いた創造性の発揮を可能にするとともに、詐欺や欺瞞の危険性を減らすことになる。

各社は、自社のAIシステムの能力、限界、適切・不適切な使用領域を広く公開することを約束する。また、有害な偏見や差別の回避、プライバシーの保護など、AIがもたらしうる社会的リスクに関する研究を優先することを約束する。

各社は、社会が直面する課題に対処するための高度なAIシステムを開発することを約束する。それは癌の予防から気候変動の緩和まで、適切に管理されたAIは、すべての人の繁栄、平等、安全保障に多大な貢献をすることができるからだ。

マイクロソフト、グーグル、OpenAIはこの件に関してリリースを発表。この合意に関してどのように対処していくかを明らかにしている。

今回の発表に法的強制力はないが、バイデン-ハリス政権は現在法的拘束力を伴う大統領令を策定中であり、今後数週間のうちに大統領令によるAI規制に踏み出す方針を表明している。

本記事はアフィリエイトプログラムによる収益を得ている場合があります