OpenAIは7月20日(現地時間)、同社が提供していた、ChatGPTなどのAIが書いたテキストと人間が書いたテキストを判定するためのツール「AI Text Classifier」の公開を停止した。

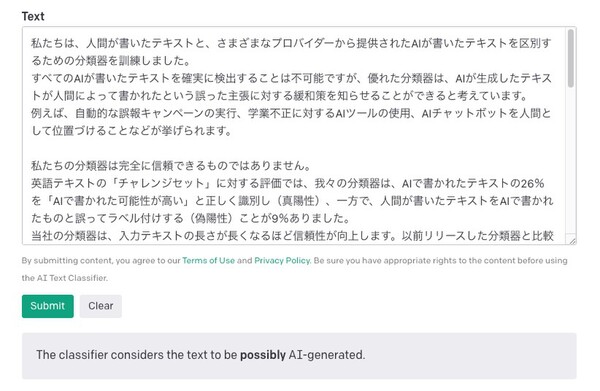

公開時に投稿されたブログの冒頭に「2023年7月20日現在、AI Text Classifierはその精度の低さから利用できなくなっています。私たちは現在フィードバックを取り入れ、テキストのより効果的な証明技術を研究しています。また、音声や映像のコンテンツがAIによって生成されたものであるかどうかをユーザーが理解できるような仕組みを開発・展開していくことを約束します」と追記の形で告知文が掲載されている。

AI Text Classifierを試すことができたページは現在この状態になっている。今後再び公開されるかどうかは不明だ。

1月31日に同社サイトで公開された「AI Text Classifier」は、1000文字以上のテキストを入力すると、AIが生成した可能性を5段階で表示する機能を備えていた。

OpenAIの英語テキストを使った実験によると、AIで書かれたテキストの26%を「AIで書かれた可能性が高い」と正しく識別(真陽性)できた。

一方で、人間が書いたテキストをAIで書かれたものと誤って識別(偽陽性)したことも9%あったという。

今月21日にもOpenAIはマイクロソフトやメタなど他のAI関連企業と共にホワイトハウスに招集され、AIが生成したコンテンツに「AI製(AI generated)」と明示させるシステムの開発に自主的に取り組むことで合意している。

本記事はアフィリエイトプログラムによる収益を得ている場合があります