今年もビルダーを魅了!AWS re:Invent 2019レポート 第1回

エンジニアのディープラーニング/GAN学習向け、MIDIキーボード+クラウドサービス

「AWS DeepComposer」発表、メロディに合わせAIが自動作曲

2019年12月03日 06時30分更新

Amazon Web Services(AWS)は2019年12月1日(現地時間)、米国ラスベガスで開催中の「AWS re:Invent 2019」において、エンジニアが生成アルゴリズム(Generative AI algorithms)を学ぶための新たなプロダクト「AWS DeepComposer」を発表(プレビューアナウンス)した。ユーザーがキーボードから入力したメロディに合わせ、事前にトレーニングされたモデルが自動的に伴奏部分を作曲するクラウドサービス。ユーザーがオリジナルのモデルを開発することもできる。

AWSはこれまでのre:Inventにおいて、2017年にビデオカメラ「AWS DeepLens」、また2018年に自動運転のホビーカー「AWS DeepRacer」を、ディープラーニングの学習/ハンズオン用プロダクトとして発表している。今回のAWS DeepComposerは、それらに続く“Deepシリーズ”の最新プロダクトとなる。

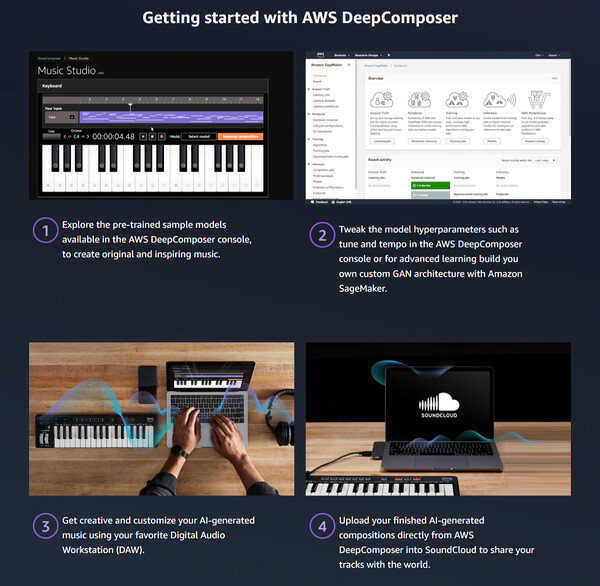

DeepComposerは、USB MIDIキーボード(AWS DeepComposer keyboard)とクラウドサービスにより構成される。ユーザーがPCに接続したキーボード(またはコンソール画面上の仮想キーボード)でメロディを入力、クラウドサービスにアップロードし、適用する音楽ジャンルのモデルを選択してテンポなどのハイパーパラメーターを設定すると、自動的に4パートの伴奏部分が生成されて楽曲が完成する仕組み。

現在のところロック、ポップ、ジャズ、クラシックの各ジャンルモデルがトレーニング済みで提供されており、加えて「Amazon SageMaker」を使ってユーザー自身でカスタムモデルを作ることもできる。カスタムモデルの作成はノンコードで可能だとしている。

「Midnight Madness」でのAWS DeepComposer発表ビデオ。キーボードで演奏されたベートーヴェン「歓喜の歌」のメロディに、AIが「ロック」の伴奏を付けるデモ。さらにビデオ終盤では、人間のシンガーソングライターとAIがライブで“共演”する模様も披露されている

re:Inventの前夜祭「Midnight Madness」での説明によると、DeepComposerはGAN(Generative Adversarial Network、敵対的生成ネットワーク)の技術を用いてモデルをトレーニングしている。具体的には新たな楽曲を生成するGeneratorと、その楽曲の善し悪しを判断してフィードバックするDiscriminatorのネットワークがあり、生成とフィードバックを繰り返すことでトレーニングを進める仕組みだ。

AWS DeepComposerサービスの利用料金は、モデルのトレーニング(1.26ドル/時間)と推論実行(伴奏部の作曲、2.14ドル/時間)とで構成される。ただし、あらかじめ用意されたモデルを使って作曲ができる12カ月間の無料利用枠(Free Tier)と、カスタムモデル4つまでの作成と作曲ができる30日間の無料トライアル(Free Trial)が用意されている。現在はWebサイトでプレビュー利用の申し込みを受け付けている。

また専用キーボードは米国Amazon.comにおいて99ドルで発売予定。このキーボードには3カ月ぶんの追加無料トライアル権が付属する。

この連載の記事

-

第5回

クラウド

ゼンリンDC、仮想サーバー1800台の「VMware Cloud on AWS」移行は順調 -

第4回

クラウド

「平均的な開発者にも機械学習の力を」―AWSジャシーCEO基調講演 -

第3回

クラウド

Redshiftは他社の3倍、そして10倍高速に―AWSジャシーCEO基調講演 -

第2回

クラウド

AWSのジャシーCEO基調講演、大量の新発表とその狙いを読む -

クラウド

今年もビルダーを魅了!AWS re:Invent 2019レポート - この連載の一覧へ