タイムラプス風の動画が生成できる「MagicTime」

さらに、インパクトをもって登場してきたのが、同じ研究グループが発表した「MagicTime」という研究です。

植物が成長するような過程を撮影したタイムラプスの動画ばかりを学習させて、動画を生成すると、成長するような過程の動画が作れるようになったというもの。これまでのアニメーションGIFなどではほとんど動いていなかったものが、ちゃんと変化しているように見えるようになっています。

MagicTimeでは、草が成長し、花が咲く様子を生成することができる(GitHubより)

ネット上から収集されたタイムラプスの動画に、タイムラプスとわかるようにテキスト表現する独自の解析方法でキャプションをつけ、約2265個の動画で構成される独自の学習データセット(「ChronoMagic」と呼ばれる)を構築したそうです。

動画は、花の開花、氷の融解、「マインクラフト」での建築物の変化など、強い物理属性を表現していたり、持続性がありながらも、変化が大きなものを選んだようです。その結果、変化が強調されるような動画を生成できるようになりました。

Soraが登場したときに大きな議論を呼んだのが、学習用データを大量に取ることで、自然と物理法則のようなものを学習したのではないかという仮説でした。Open AIはこの件について明確には説明していません。しかし、学習データの量に限界があるとはいえ、MagicTimeの研究が示すのは、どうも仮説が正しい可能性が出てきています。

MagicTimeの論文では、実現した学習済モデルを「タイムラプスから物理的知識を学習」と説明しています。そのうえで、タイムラプス動画を使ったAIの学習が、「物理世界の変容シミュレータを構築する有望な道筋であることが示唆される」と論じています。

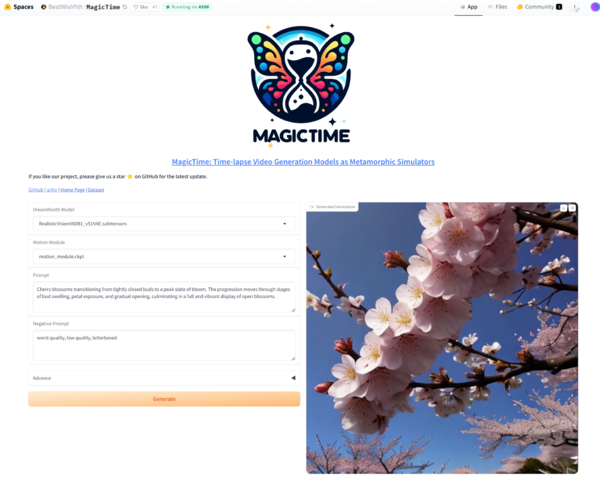

公開されているデモで桜を生成してみたところ。桜の咲き方は少し微妙ではある。(HuggingFaceより)

MajcTimeのモデルは公開されており、Google Colaboratory上で動く環境が用意されています。桜の花を咲かせてみたり、植物の根を生やしてみたり、マインクラフトの建築物を変化させてみたりということができます。つぼみが破綻したり、物理的には完璧とまでは言えませんが、コンセプトを示すことはできています。

ただ、学習したデータには限界があるため、キャラクターを出したりと、学習されていないデータを出そうとするとあまりうまくいきません。画像生成AI「Stable Diffusion」を手軽に扱う環境として普及が進む「ComfyUI」用の環境も登場してきており、ローカルでも扱えるようになってきています。

OpenAIのSoraに比べるとそこまですさまじいというものではなく、発表から間もない研究ということもあり、限界がある印象は受けます。とはいえ、Sora自体が登場してきたときは「手も足も出せない」くらいの印象でしたが、すでに先行する研究を利用して、愚直に大量にデータトレーニングすれば、Soraと同じようなことができるということ自体が重要な情報です。

もちろん、OpenAIも一部の情報しか公開していないので、Soraのすべてがわかったというわけではありませんが、研究者でもまだできることはあるぞというところです。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? -

第140回

AI

3Dモデル生成AIのレベルが上がった 画像→3Dキャラ→動画化が現実的に -

第139回

AI

AIフェイクはここまで来た 自分の顔で試して分かった“違和感”と恐怖 - この連載の一覧へ