独自LLM「tsuzumi」を2024年3月より提供、精密医療や顧客対応、ソフト開発などで検証開始

小さくて専門知識を持つ「NTT版LLM」、すでにDXのトライアルも進む

2023年11月06日 10時45分更新

NTTは、2023年11月1日、独自の大規模言語モデル(LLM)「tsuzumi」を、2024年3月より商用提供することを発表した。

現状、LLMの学習や推論に消費電力を含む莫大なコストが費やされている中、tsuzumiは軽量でありながら高い日本語処理能力を備える点を強調する。2024年3月より、NTTグループ各社から法人ユーザーに対して展開され、「専門知識を持った小さなLLM」として、業界特化の領域を中心に業務効率やDXを推進していくという。

NTTの代表取締役社長である島田明氏は、「メディカル領域やソフトウェア開発など、専門用語や業界特有の表現が多く含まれる場合は、汎用AIが十分な性能を発揮しないケースが多々あった。tsuzumiは、業界特有のデータに対するカスタマイズが可能なため、AI活用の領域を拡大できる」と説明する。

軽量版はGPU1基、超軽量版はCPUだけで高速な推論動作が可能

tsuzumiの大きな特徴が、他のLLMと比べて軽量なところだ。島田氏は、「生成AIの利用には、GPUなどのハードウェアやデータセンター、そこで消費する電力など多大なコストがかかる。tsuzumiは、GPT-3規模のLLMと同程度の性能を25分1のGPUコストで実現する」と強調する。

実際、GPT-3規模のLLMでは、1回の学習につき約1300MWhの電力を消費するといわれ、これは原発1基の1時間の電力量に相当するという。これに対して、NTTの執行役員 研究企画部門長である木下真吾氏は、「目指す方向性として『なんでも知っている大きなLLM』ではなく『専門知識を持った小さなLLM』を作ろうというアプローチ。パラメーターサイズを控えながら、言語学習データの質と量を徹底的に向上させた」とする。

tsuzumiでは、パラメーター数70億の「軽量版」と、6億の「超軽量版」の2種類が用意される。軽量版はGPU1基で、超軽量版はCPUだけの環境でも高速に推論動作が可能となる。今後、パラメーター数130億以上の高機能な「中型版」の提供も予定している。

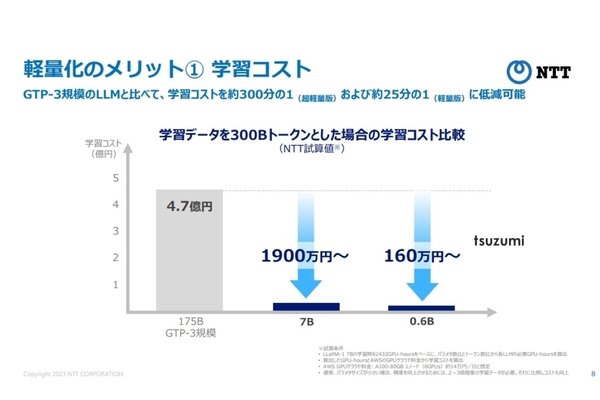

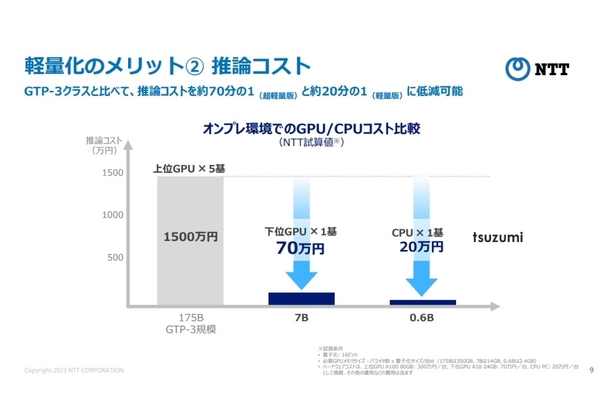

パラメーター数が1750億の米OpenAIのGPT-3とGPUクラウドの利用料金を比べた場合、学習コストを約300分の1(超軽量版)および約25分の1(軽量版)、推論コストを約70分の1(超軽量版)および約20分の1(軽量版)に低減可能だという。

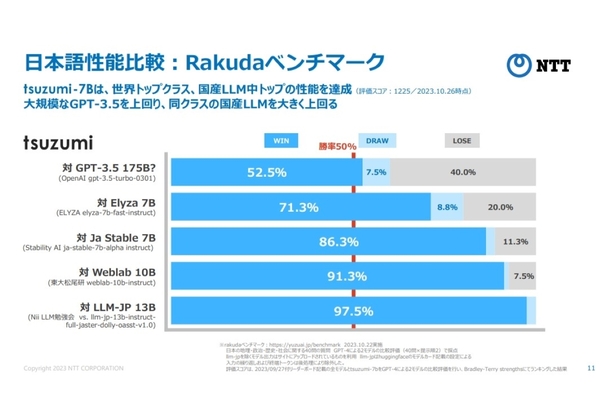

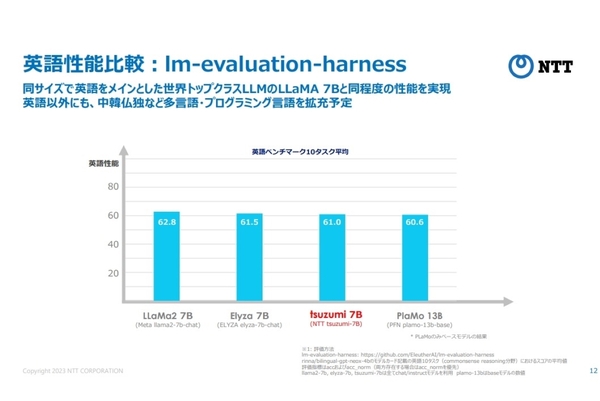

もう一つの特徴が言語対応能力だ。日本語と英語に対応し、特に日本語の処理能力では各種ベンチマークで世界トップクラスを誇るという。

Rakudaベンチマークを用いた、tsuzumi軽量版と他のLLMの日本語性能の比較では、同クラスの国産LLMおよびGPT-3.5を上回った。lm-evaluation-harnesを用いた英語性能比較でも、tsuzumi軽量版とMataのLlama2 7Bが同程度の性能を記録したという。今後、日英以外にも中韓仏独と対応言語を拡充していく予定だ。

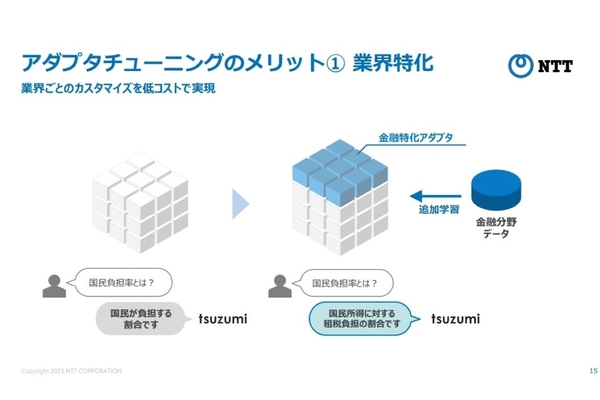

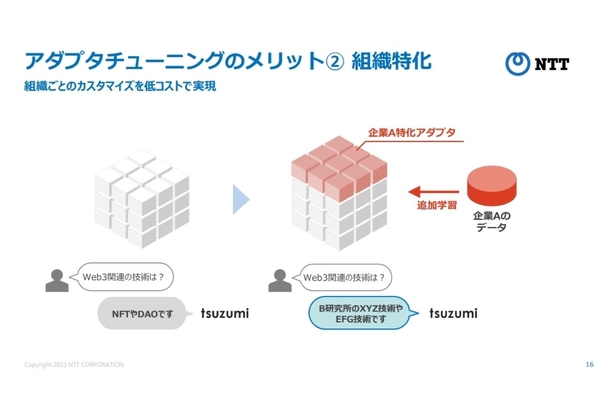

アダプタにより低コストでの業界特化のチューニングが可能に

チューニングに関しては、精度やコストなどの要件にあわせて「プロンプトエンジニアリング」「フルファインチューニング」「アダプタチューニング」と3つの方法を用意する。このうちアダプタチューニングでは、ファインチューニングの際に「アダプタ」というサブモジュールを追加することで、業界特有の知識や組織固有の知識の学習を低コストで実現する。基盤モデルに複数のアダプタを共有して、要件に応じて組み換えが可能なマルチアダプタにも対応予定だ。

また言語だけではなく、文章画像などの視覚情報を提示しながら質問が可能な、言語+視覚のマルチモーダルにも対応予定だ。マルチモーダルは、将来的には、聴覚やユーザー状況にまで拡張していくという。マルチモーダルは、感覚による認知が必要となるような業界特化の業務で活躍することが期待される。

本記事はアフィリエイトプログラムによる収益を得ている場合があります