マイクロソフトは3月28日(現地時間)、OpenAIの最新LLM(大規模言語モデル)GPT-4を採用したセキュリティー製品「Microsoft Security Copilot(以下Security Copilot)」を発表した。現在はプライベートプレビューとなっており、一般向けにはまだ公開されていない。

従来のモデルとAIを組み合わせたハイブリッド型

Security Copilotは、マイクロソフトが提供する従来のセキュリティー特化型モデルにOpenAIのGPT-4を組み合わせることで、スピーディーかつ大規模な対応が可能になったもの。

マイクロソフトのモデルには、独自のグローバル脅威データとマイクロソフトが毎日受け取っている65兆以上の脅威シグナルで情報が提供されている。

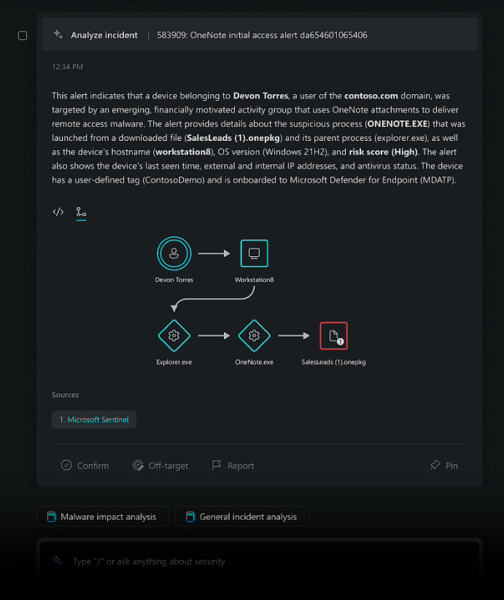

セキュリティー管理者は、既に発表されているCopilot製品と同じように、プロンプトを入力することで、セキュリティーに関する情報や対処のためのクエリーなどを自然言語を通じて得ることができる。

AIの力でそれ以外の手法では見逃す可能性のある情報をキャッチできるため、検出の質、対応のスピード、セキュリティー態勢の強化の能力が向上するという。

ただし、現状ではAIが生成したコンテンツには間違いが含まれることがあるため、Security Copilotには学習システムが組み込まれている。

ツールに直接組み込まれたフィードバック機能で明示的なフィードバックをすることでAIは学習し、より首尾一貫した適切な回答を作成するようになるという。

Security Copilot 3つの原則

Security Copilotが提供する機能は多種多様だが、すべて3つの原則に導かれているという。

●原則1:複雑なものをシンプルに

セキュリティーでは、ほんの数分の遅れで深刻なトラブルになるケースも多い。Security Copilotは検出されたインシデントに対し、ステップバイステップのガイダンスを自然言語で提供するため、インシデントの調査と対応を迅速に実行できる。

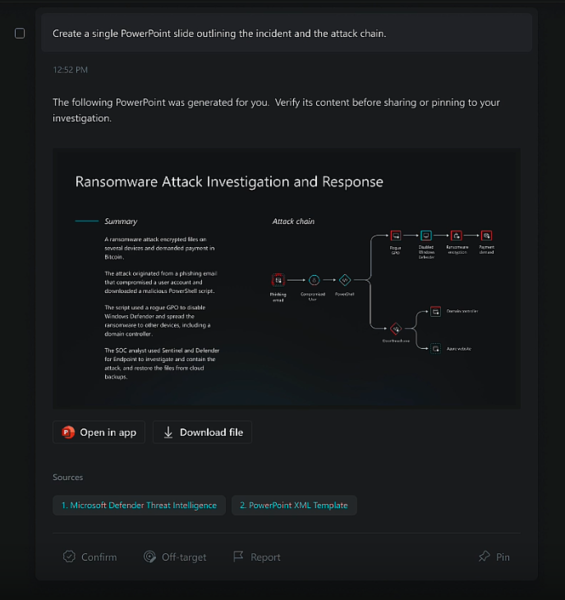

また、プロセスやイベントをすばやく要約し、対象者に合わせて内容を調整したレポートを作成できるため、担当者は最も緊急性の高い業務に集中することができる。ひとつのインシデントに数時間や数日ではなく、数分で対応できるのだ。

●原則2:他の人が見逃したものをキャッチ」

Security Copilotは、優先順位を付けた脅威をリアルタイムで表示し、マイクロソフトのグローバルな脅威インテリジェンスに基づく継続的な推論により、脅威要因の次の動きを予測する。

また、脅威の探索、インシデント対応、脆弱性管理などの分野におけるセキュリティーアナリストの専門知識を表すスキルも付属している。これによりセキュリティー担当者は、他の方法では検出できなかった悪意のある行動や脅威のシグナルを発見できるようになる。

●原則3:人材不足に対応

セキュリティーチームの能力は、チームの規模や人間の注意力の限界によって常に制限される。

Security Copilotは、基本的なものから複雑なものまで、セキュリティー関連の質問に答える機能によって担当者のスキルを向上させることができる。

さらに、ユーザーとの対話から継続的に学習し、企業の好みに合わせて適応し、より安全な結果を得るための最適な行動指針を担当者にアドバイスする機能もある。

また、新しいチームメンバーの学習をサポートし技術やノウハウを継承することもできる。

このことににより、セキュリティーチームは、より少ない人数でより多くのことをこなすことができるようになる。

データはAIの学習には使用されない

ユーザーのデータとAIモデルは、包括的な企業のコンプライアンスとセキュリティー管理によって、すべてのステップで保護されているため、他者が使用する基礎AIモデルの訓練や強化に使用されることはない。

また、ユーザーのデータやビジネスプロセスで訓練されたAIは、ユーザーが属する組織のみが独占的に利用できる。

したがって、外部には非公開のままチーム内でインシデントにまつわるデータを共有し、複雑な問題に対してより効果的に協力し、集団スキルを開発することが可能になっている。

マイクロソフトは、2021年6月に「GitHub Copilot」を発表しているが、2022年3月になって「Dynamics 365 Copilot」「Microsoft 365 Copilot」「Copilot in Power Apps」と、OpenAIのLLMを使ったサービスを立て続けてに発表している。

本記事はアフィリエイトプログラムによる収益を得ている場合があります