新年早々の1月6日、DEC→AMD→SiByte→P.A.Semi→Apple→AMD→Intelと放浪の旅(?)を繰り返していたJim Keller氏がPresident兼CTOとしてTenstorrentに入社したことが報じられた。

CTOになったとはいえ、そもそもの入社は2020年12月で、まだ入社して1ヵ月になるかならないかという期間なので、今の時点でTenstorrentのテクノロジーになにかしらの影響を与えているかと言えばほぼ0だとは思うが、それはともかくとしてKeller氏を引き寄せるようなおもしろいモノがTenstorrentにはあった、ということの傍証ではあるかと思う。

推論と学習、両方のAIプロセッサーを開発する

Tenstorrent

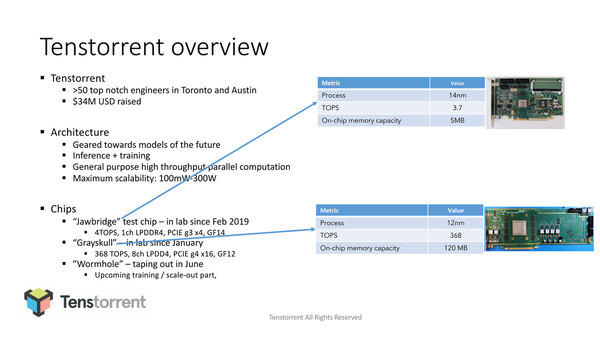

Tenstorrentは2016年3月にカナダのトロントで創業したメーカーである。創業者はLjubisa Bajic氏(CEO)、Milos Trajkovic氏(Director Hardware Engineering)とIvan Hamer氏の3人である。実はこの3人、いずれもAMD(Bajic氏はDirector, IC Design/Architect、Trajkovic氏はFirmware Design Engineering Manager、Hamer氏はConsulting Software/Embedded Engineer)を同時期に辞職して創業した形である。

創業はそんなわけでトロントであるが、現在はテキサス州オースチンにもオフィスを持っており、両方合わせておおむね70人(2020年8月現在:2020年4月には50名超だった)の人員を抱えている。

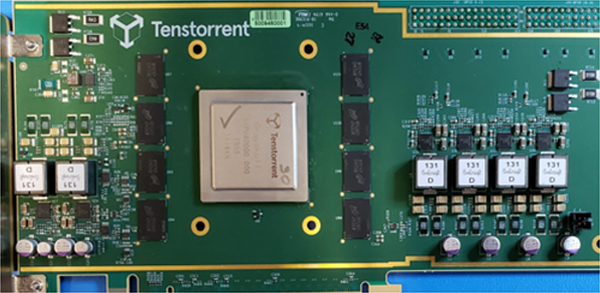

そのTenstorrentであるが、Inference(推論)とTraining(学習)の両方を視野に置いている。そしてすでにJawbridgeとGrayskullという2種類のチップを製造しており(これはどちらもInference向け)、続くTraining向けのWormholeもすでにテープアウトが完了したことを発表している。

コード名の由来は1982年にMattel社が発売した“Masters of the Universe”シリーズのコミック&アクションフィギュアから始まるシリーズのようだ。舞台となる惑星EterniaにはCastle Grayskullなる要塞があり、その要塞の入口の名前がJawbridgeである。で、主人公のHe-ManとShe-Raの母親は元宇宙飛行士で、Wormholeを通ってEterniaに落ちてきたという設定になっている

チップの話はあとでするとして、“Geared towards models of the future”という言葉に、なんというか意気込みというか黒雲というか、なんとも言えないものを感じる。

まずはそのなんとも言えない方の話を先に紹介しよう。2020年8月のHotChips 32において、Tenstorrentは“Compute substrate for Software 2.0”と題した講演を行なった(*1)。Software 2.0と聞くと連載595回のDataflowを思い出すのだが、TenstorrentはDynamic ExecutionこそがSoftware 2.0であると力説する。

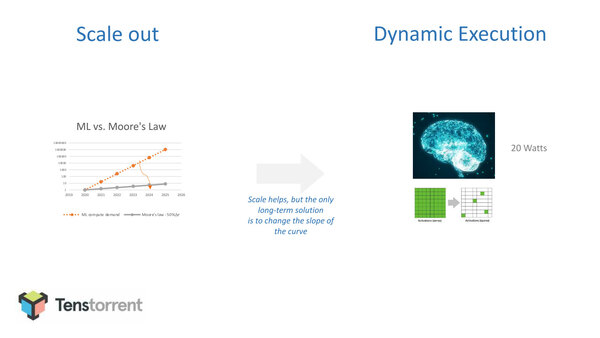

ムーアの法則と機械学習の要求するプロセッサー性能の乖離が激しいことへの解の1つはスケールアウトだが、長期的には役に立っても短期的な解決にならず、これをDynamic Executionが救うという趣旨。ちなみに20Wというのは人間の脳の消費エネルギー(の電力換算)である

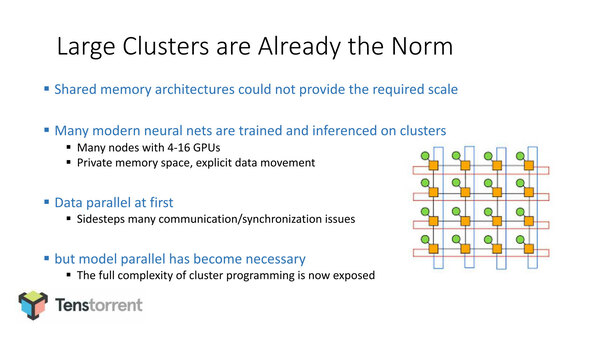

まずスケールアウトについては、すでに広範に使われているが、最初こそデータの並列性だけでいけるものの、すぐにモデルの並列性も必要になるとする。

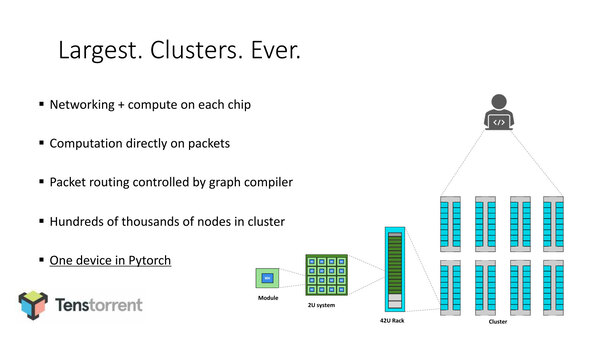

そもそも現在のスケールアウトの使われ方だと、Computation(計算)をするチップは山ほどあるのに、それをコントロールしてるのはPytouchを動かしてる1台のノートなんてこともしばしばあるわけで、はたしてこうした使い方だけが未来か? と言われると確かにもう少し考えたくなる。

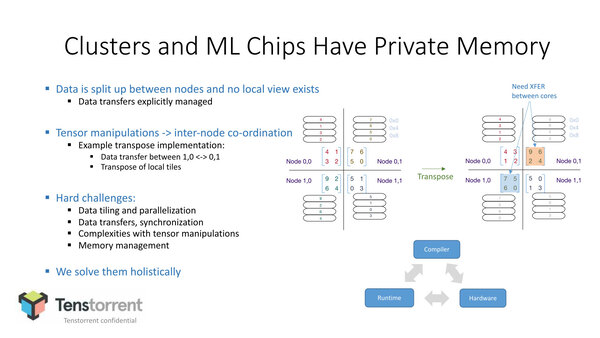

またメモリーアクセスを考えた時、行列に対して行単位のアクセスは連続しているからシーケンシャルアクセスが効くが、行列を転置するとランダムアクセスになってしまう。悪いことに、同じ行列を転置してまた戻して、という操作が入ると同じメモリー領域にシーケンシャルアクセスとランダムアクセスが集中することになりかねず、これが大きく性能を落とす要因になる。

これをうまくさばくためには、メモリーアクセスのループを上手くハンドリングする必要がある。ならばPrivate Memoryを持たしてSharedをやめれば、というとこちらはこちらでノード間にまたがる場合にいろいろ問題が出てくることになる。これを解決するのがDynamic Executionである、というのが同社の説明である。

Private Memoryのマシンで、各ノード間にまたがるデータなどがなければこれでいいのだろうが、あいにくInferenceにしてもTrainingにしても、実際にはノード間でまたがるケースが非常に多い。これをどう解決するかはいろいろな方法が考案・実装されているが、今のところ決定打はない

(*1) なぜか分類がDay 2の"FPGAs and Reconfigurable Architectures"になっているのが謎。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第878回

PC

もはや銅配線は限界? 3200Gイーサネット実現に立ちはだかる200GT/秒の壁 -

第877回

PC

「不良品ゼロ」と「水冷NG」の狭間で。ルネサスが明かした車載チップレットSoCのリアル -

第876回

PC

このままではメモリーが燃える! HBM4/5世代に向けた電力供給の限界と、Samsungが示すパッケージ協調設計の解 -

第875回

PC

1000A超のAIプロセッサーをどう動かすか? Googleが実践する垂直給電(VPD)の最前線 -

第874回

PC

AIの未来は「電力」で決まる? 巨大GPUを支える裏面給電とパッケージ革命 -

第873回

PC

「銅配線はまだ重要か? 答えはYesだ」 NVIDIA CEOジェンスンが語った2028年ロードマップとNVLink 8の衝撃 -

第872回

PC

NVIDIAのRubin UltraとKyber Rackの深層 プロトタイプから露見した設計刷新とNVLinkの物理的限界 -

第871回

PC

GTC 2026激震! 突如現れたGroq 3と消えたRubin CPX。NVIDIAの推論戦略を激変させたTSMCの逼迫とメモリー高騰 -

第870回

PC

スマホCPUの王者が挑む「脱・裏方」宣言。Arm初の自社販売チップAGI CPUは世界をどう変えるか? -

第869回

PC

半導体プロセスの新たな覇権! インテルのDNNプロセッサーはAMDやMetaを凌駕する配線密度と演算密度 -

第868回

PC

物理IPには真似できない4%の差はどこから生まれるか? RTL実装が解き放つDimensity 9500の真価 - この連載の一覧へ