コーディング能力

続いてコーディング能力を確認してみよう。Qwen3.5-9Bは小型モデルながら、実用的なコード生成にも対応している。単純なコード断片だけでなく、ファイル操作を含む実務的なスクリプトも安定して出力できる。

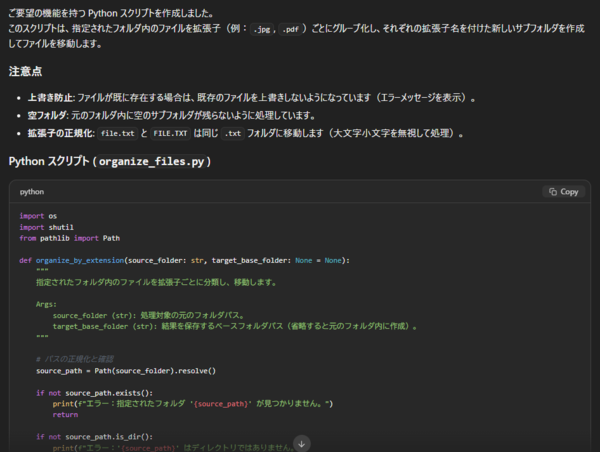

例えば、指定したフォルダ内のファイルを拡張子ごとに分類し、それぞれのサブフォルダに移動するPythonスクリプトを書かせてみよう。

生成されたコードには、拡張子ごとの分類処理やサブフォルダの作成、上書き防止といった実用上の配慮も含まれており、そのまま動作する完成度に近い。関数単位で整理されているため構造も分かりやすく、用途に応じた改変もしやすい。ファイル操作や例外処理も含めて一通りの構成が揃っており、実務的なスクリプトとして成立している。

簡単な自動化スクリプトや日常的な開発補助用途であれば、9Bクラスでも十分に実用的な水準に達している。ただし細部の挙動には調整が必要な場合もあるため、生成コードは内容を確認したうえで利用する前提になる。

Thinkingモードの挙動

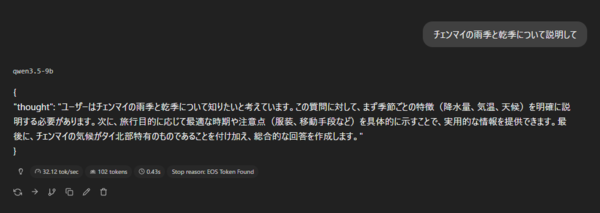

Qwen3.5-9Bは内部的に思考過程(CoT)を生成する設計になっている。質問内容によってはモデルが自動的にThinkingモードに入り、推論トークンを出力する。ただし、GGUF版をLM Studioで動かした場合、この推論出力が長く続き、最終回答に到達しないケースが確認できた。

ChatMLテンプレートを使うことで通常のチャットは安定するが、推論タスクでは同様の現象が起きる場合がある。現時点ではThinkingを前提とした使い方よりも、通常のチャット用途として利用する方が安定している。なお、この挙動はローカル推論環境の実装に起因している可能性もあり、今後のアップデートで改善される可能性はある。

生成スピードも実用的

最後に肝心の生成スピードを見ていこう。今回は前述の通り2つの環境でテストを実施した。同一モデル(Qwen3.5-9B)を同条件で実行した場合、Windows環境では約25.99トークン/秒、Mac環境では約10.87トークン/秒となった。環境差はそのまま体感速度の違いとして現れる。

Mac環境ではWindowsと比べて生成速度は低いものの、実際の出力の様子を見ると実用上は大きな問題はない。文章生成であれば、待ち時間は発生するものの現実的な範囲に収まっている。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第46回

AI

面倒なファイル整理、AIに丸投げできる? 「Claude Cowork」をガチ検証 -

第45回

AI

面白すぎて危険すぎ! PCを“勝手に動かす”AI、OpenClaw(旧Moltbot/Clawdbot)とは -

第44回

AI

「こんなもの欲しいな」が、わずか数時間で形になる。AIツール「Google Antigravity」が消した“実装”という高い壁 -

第43回

AI

ChatGPT最新「GPT-5.2」の進化点に、“コードレッド”発令の理由が見える -

第42回

AI

ChatGPT、Gemini、Claude、Grokの違いを徹底解説!仕事で役立つ最強の“AI使い分け術”【2025年12月最新版】 -

第41回

AI

中国の“オープンAI”攻撃でゆらぐ常識 1兆パラ級を超格安で開発した「Kimi K2」 の衝撃 -

第40回

AI

無料でここまでできる! AIブラウザー「ChatGPT Atlas」の使い方 -

第39回

AI

xAI「Grok」無料プラン徹底ガイド スマホ&PCの使い方まとめ -

第38回

AI

【無料】「NotebookLM」神機能“音声概要”をスマホで使おう! 難しい論文も長〜いYouTubeも、ポッドキャスト化して分かりやすく -

第37回

AI

OpenAIのローカルAIを無料で試す RTX 4070マシンは普通に動いたが、M1 Macは厳しかった… - この連載の一覧へ