2024年1月にOpenAIが発表した動画生成AI「Sora」はインパクトがありましたが、DeepMindが開発したフレームごとの動画をブロック状にデータとして出す方式「時空間パッチ(Space-Time Patch)」という方式を使ったのではないかと推測されていました(「動画生成AIの常識を破壊した OpenAI「Sora」の衝撃」参照)。発表された技術レポートの情報を合わせて、推測する方式をまねれば、同様のことができるのではないかということで、新しい動画生成AIの研究が進んでいます。

OpenAI「Sora」まねた研究が続々

その代表例が、3月リリースされた「Open Sora」というプロジェクト。中心として進めているのは、中国系のAIスタートアップのHPC-AI Techという企業などの中国系の研究者たちです。Soraのメソッドで推測できる部分から、再現していこうというプロジェクトで、「すべての人への効率的な映像制作の民主化」というコンセプトを掲げています。

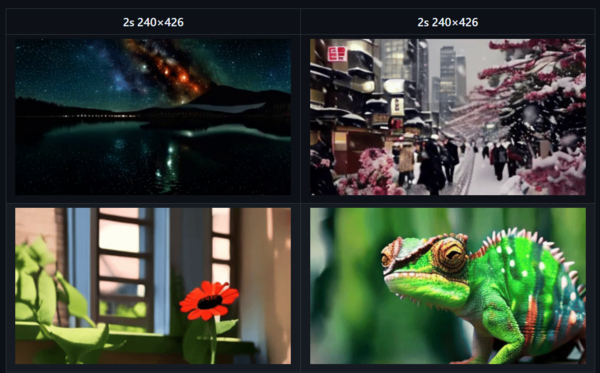

Open Soraで生成された動画。2秒と限定的だが一貫した動画が作れている(GitHubより)

適切なデータセットを揃えられれば、似た動画を生成できる可能性があるため、Soraを既存技術で再現しようとしているのです。16フレームで学習しているため、最長2秒で、解像度も240x426ピクセルと小さなサイズですが、Soraをまねた空間的な特徴を学習することができる手法を使うことで、一貫性を維持した動画の生成に成功していました。最初のバージョンの1.0では3日間のトレーニングで実現できたと述べています。

Open Sora Planで生成された動画。2秒ながら複雑な自然の風景の描写に成功している(同上)

そして、このモデルを土台とした派生研究が登場しています。

そのひとつが4月に発表された「Open Sora Plan」という派生モデル。北京大学信の袁粒(リー・ユアン)准教授の研究室が開発したモデルです。やはり最長2秒という限界がありますが、基本の画像サイズが512x512ピクセルとなり、クオリティが上がっています。約4万本のパブリックドメインの動画を元に学習したそうです。そのうち60%が風景映像ということで、海の波が打ち寄せる様子や、海中の風景、たき火が燃える様子など、自然物の動画描写を実現しています。

この連載の記事

-

第63回

AI

まるで“いけない話ができるChatGPT” ローカルAI「Command R+」の爆発的な可能性 -

第61回

AI

画像生成AI“児童ポルノ”学習問題、日本では表現規制の議論にも -

第60回

AI

3Dアニメーション技術の革新が止まらない -

第59回

AI

政府、生成AI推進に向けて議論を加速 -

第58回

AI

画像生成AIで同じキャラクターが簡単に作れるようになってきた -

第57回

AI

日本発のリアルタイム画像生成AIサービスが熱い 大手にとっては“イノベーションのジレンマ”に -

第56回

AI

画像生成AIの著作権問題、文化庁議論で争点はっきり -

第55回

AI

動画生成AIの常識を破壊した OpenAI「Sora」の衝撃 -

第54回

AI

画像生成AI、安いPCでも高速に 衝撃の「Stable Diffusion WebUI Forge」 -

第53回

AI

日本発の画像生成AIサービスがすごい 無料アップスケーラー「カクダイV1」 - この連載の一覧へ