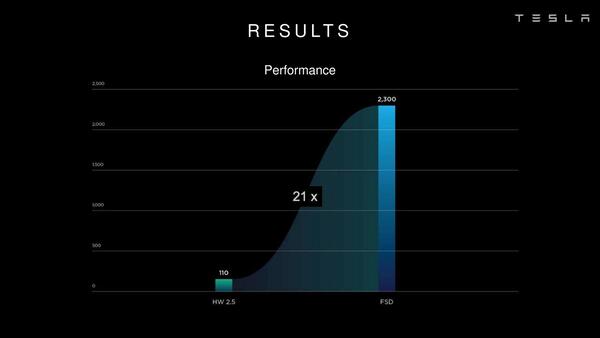

HW 2.5から性能が21倍向上

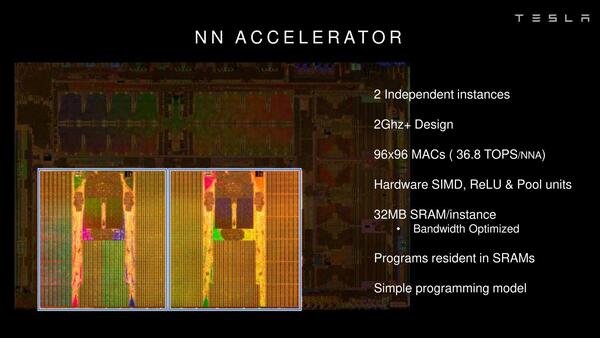

肝となるのがNNA(Neural Network Accelerator)であるが、2つのNNAが独立して配される。NNAの中枢は96×96のMACユニットで、これが単体で36.8TOPSの演算性能を持つ。このMACユニットは周囲に配された32MBのSRAMとだけデータ交換することで、効率よく計算できるようになっている。

もっともこれに関しては2019年7月にハンガリーのAIMotiveがFSDの分析をしており、それほど効率が良くないとしている。下の画像を見ると、SRAMセルからMACユニットに配線が集中しており、実際にはここがボトルネックになってしまいやすく、MACユニットの効率はかなり低いのではないか? と推察している。

AIMotiveによれば、MACユニットとSRAMセルを混在させるような構成にすれば、90%以上の効率を実現することも可能とするが、ただし設計が複雑化する関係で、設計完了が半年~1年程度伸びることになる。

Teslaはこの設計期間が延びることを嫌って、不効率を覚悟のうえであえて単純な構成でFSDチップを設計したのではないか? というものだ。

Teslaクラスの資金力があれば、例えばHW3.0はこの単純なFSDチップで実現しておいて、これとは別により最適化を進めたチップを並行して開発することも不可能ではないだろうし、とりあえずNVIDIAから自前にチップ設計を切り替える第一歩としては、確実に動くものを作る方が重要だったという判断もあり得るわけで、その意味でもAIMotiveの分析は間違っていないように思える。

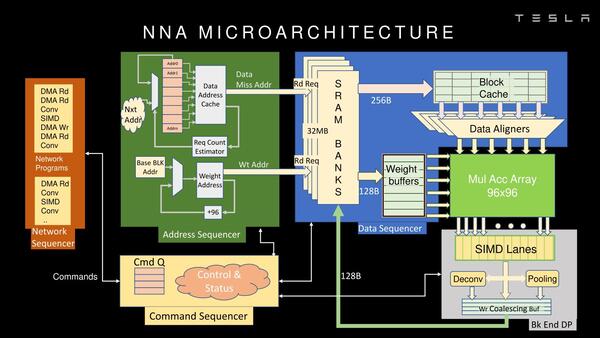

NNAの内部構造は以下の画像のとおり。MACアレイでひたすら乗算を行ない、その結果をSIMDエンジンで受けるという格好になっている。

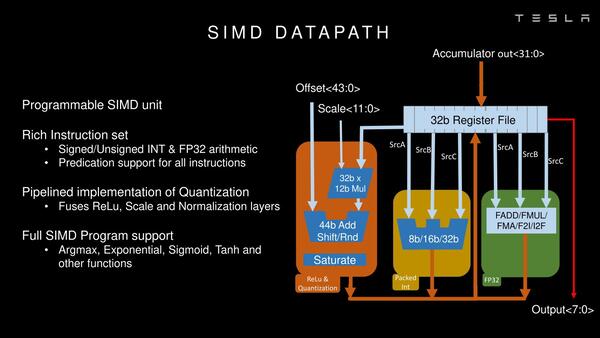

SIMDエンジンの内部構造が下の画像だ。SIMDといっても乗算そのものはMACユニットで済ませた後になるので、加算とアクティベーションが主な作業であり、それもあって対応する命令は多いものの、実装そのものは比較的簡単なようだ。

さてこのFSD、HotChipsでの発表によれば従来のHW 2.5と比較して21倍の性能向上を実現しているとする、消費電力の絶対値は25%増えているものの、性能/消費電力比は大幅に向上しているわけだ。

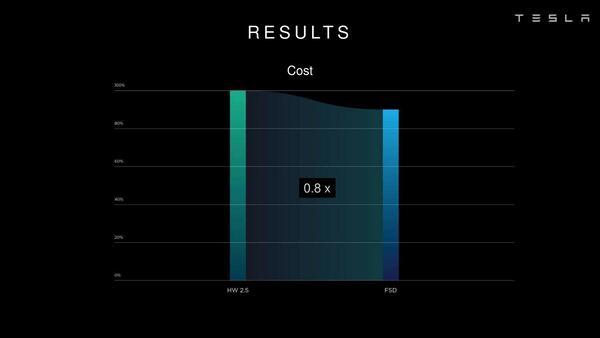

またコストは2割削減できたとしている。ちなみにNVIDIAのDrive Xavierと比較した場合、6.9倍の性能になるとのこと。

NVIDIAのDrive Xavierとの比較。ただこの144TOPSという数字はLockstep動作を無視した場合の話で、実際はこの半分という気もするし、先のAIMotiveの分析が正しければ実効性能差はさらに縮まりそうではある

TeslaはいつまでこのHW 3.0、つまり現バージョンのFSDを使い続けるつもりなのかはよくわらない。あるいはそろそろ内部的にはHW 3.5が登場しつつあるのかもしれない。なんにせよ、レベル2の自動運転を実行し、レベル3にトライするためにはこの程度の演算処理性能が必要、という1つの目安になることは間違いない。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第876回

PC

このままではメモリーが燃える! HBM4/5世代に向けた電力供給の限界と、Samsungが示すパッケージ協調設計の解 -

第875回

PC

1000A超のAIプロセッサーをどう動かすか? Googleが実践する垂直給電(VPD)の最前線 -

第874回

PC

AIの未来は「電力」で決まる? 巨大GPUを支える裏面給電とパッケージ革命 -

第873回

PC

「銅配線はまだ重要か? 答えはYesだ」 NVIDIA CEOジェンスンが語った2028年ロードマップとNVLink 8の衝撃 -

第872回

PC

NVIDIAのRubin UltraとKyber Rackの深層 プロトタイプから露見した設計刷新とNVLinkの物理的限界 -

第871回

PC

GTC 2026激震! 突如現れたGroq 3と消えたRubin CPX。NVIDIAの推論戦略を激変させたTSMCの逼迫とメモリー高騰 -

第870回

PC

スマホCPUの王者が挑む「脱・裏方」宣言。Arm初の自社販売チップAGI CPUは世界をどう変えるか? -

第869回

PC

半導体プロセスの新たな覇権! インテルのDNNプロセッサーはAMDやMetaを凌駕する配線密度と演算密度 -

第868回

PC

物理IPには真似できない4%の差はどこから生まれるか? RTL実装が解き放つDimensity 9500の真価 -

第867回

PC

計算が速いだけじゃない! 自分で電圧を操って実力を出し切る賢すぎるAIチップ「Spyre」がAI処理を25%も速くする -

第866回

PC

NVIDIAを射程に捉えた韓国の雄rebellionsの怪物AIチップ「REBEL-Quad」 - この連載の一覧へ