今回は、ここまで説明してきたいくつかのAIプロセッサーのアップデートをお届けしたい。4月19日から4月23日まで一週間ぶっ続けで、LSPC(Linley Spring Processor Conference) 2021が開催され、ここでさまざまな発表があったのだが、従来の製品についても追加の発表、あるいは情報の更新があった。ということでそうしたものを中心に説明しよう。

サンプルの存在が判明した

Cerebras WSE2

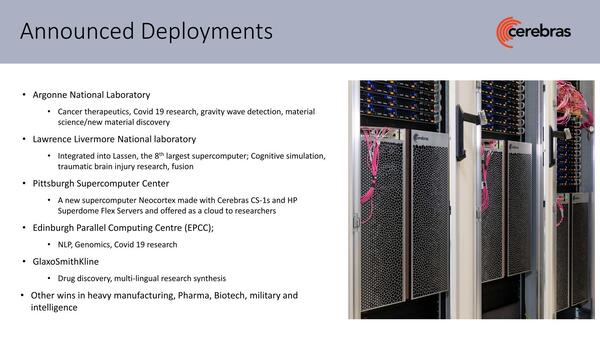

連載572回で紹介したCerebras WSEは、ほぼウェハー1枚をまるまる使ったダイサイズ4万6225mm2の巨大なチップである。もうここまで大きいとチップという言い方はそぐわない気もするのだが。このWSE(ウェハースケールエンジン)を搭載したCS-1というシステムはピッツバーグスーパーコンピューティングセンターやアルゴンヌ国立研究所が導入を始めているという話は記事の最後で説明した通り。

これに加えてローレンス・リバモア国立研究所やエジンバラパラレルコンピューティングセンターやグラクソ・スミスクラインなどでも導入されたことが明らかにされ、さらに他にも重工業や製薬/バイオ、防衛などの用途でも導入され始めたことが明らかにされた。

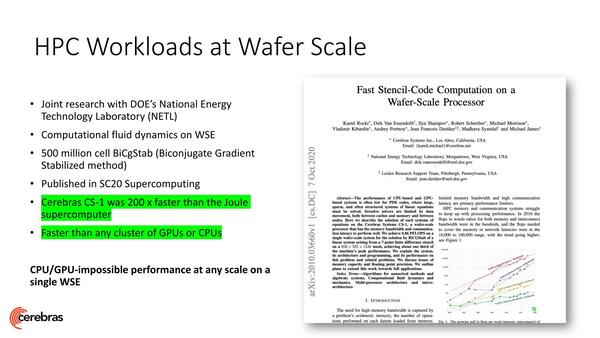

またAI用途だけでなく、HPC向けの論文も米国立エネルギー技術研究所との共著で出したといった話も紹介された。

ちなみに論文によれば、1台のCS-1で0.86PFlopsの処理性能でこれを実施できたそうで、ピーク性能のおおむね1/3の性能となるとする。他のシステムと比較すると、例えばNVIDIA A100の理論ピーク性能が78Flops/19.5Flops/9.7Flops(FP16/FP32/FP64)なので、これと比べても11倍~89倍高速ということになる。

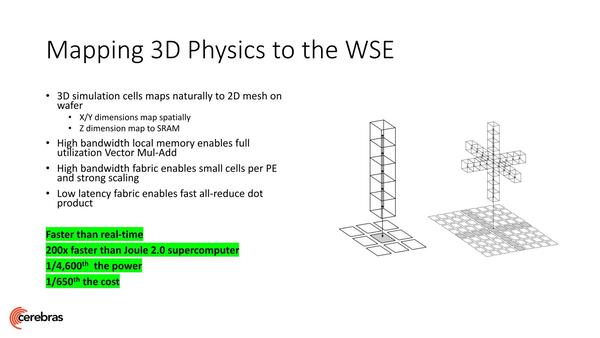

国立エネルギー技術研究所はJoule 2.0というスーパーコンピューターを運用しており、これは4320個のXeon Gold 6148にTesla P100を組み合わせたシステムで、TOP500のスコアでは2020年11月に81位。理論性能は5750.8TFlops、実性能は3608.6TFlopsというものであるが、これと比較してCS-1は200倍高速、というのは普通では考えられない。

ちなみにその200倍を達成できた仕組みが下の画像だ。Z方向をSRAMに、X/Y方向をFeature Mapにそれぞれ格納する形でこれを実装することで、ローカルメモリーのみを利用して演算をひたすらブンまわせるようになり、これが性能向上につながったわけだ。

加えてウェハースケールエンジンではとにかくプロセッサーの数が多いため、3Dのメッシュを2Dに展開しても収まる(うまく収まるように展開する)ことで、Mul-Addの計算だけ高速で処理すればよいという形に実装できるとする

ところで消費電力が4600分の1というのはわかる(Joule 2.0はおそらく2160ノードほどになる)が、コストが「たったの」650分の1というのは、CS-1のお値段はJoule 2.0の4ノード分ほどでしかないことになる。実際にはここにインターコネクトやストレージなどいろいろ組み合わせる必要があるので、2ソケットのHP Proliant4台分よりはずっと高いのだが、それでも意外にお安いというのが率直な感想である。

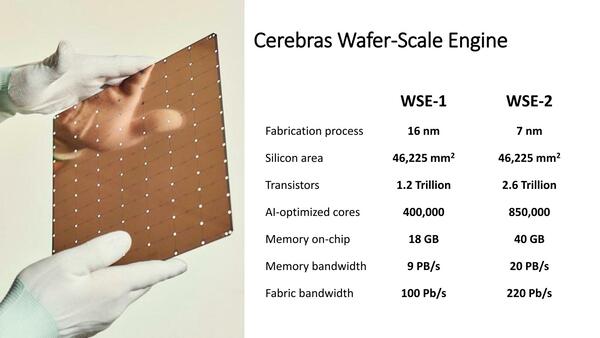

さて本題はWSE-2である。そもそもWSEはTSMCの16nmを利用しており、すでに7nmが広く量産に使われていることを考えれば早晩移行するものと思われていたが、「そもそも可能なのか?」ということを含めてこれまで同社は説明をしてこなかった。今回はこのTSMCのN7を使ったWSE2のサンプルがすでに存在することを明らかにしたことになる。

内部のアーキテクチャーなどは一切変更がなく、微細化によってより多くのコアとメモリーを搭載できる、というのが唯一のメリットになる。

すでにこのWSE-2を搭載したCS-2も稼働している。またWSEと構造が変わらないのでCS-1用のソフトウェアは基本そのままCS-2で動くという話であった。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第878回

PC

もはや銅配線は限界? 3200Gイーサネット実現に立ちはだかる200GT/秒の壁 -

第877回

PC

「不良品ゼロ」と「水冷NG」の狭間で。ルネサスが明かした車載チップレットSoCのリアル -

第876回

PC

このままではメモリーが燃える! HBM4/5世代に向けた電力供給の限界と、Samsungが示すパッケージ協調設計の解 -

第875回

PC

1000A超のAIプロセッサーをどう動かすか? Googleが実践する垂直給電(VPD)の最前線 -

第874回

PC

AIの未来は「電力」で決まる? 巨大GPUを支える裏面給電とパッケージ革命 -

第873回

PC

「銅配線はまだ重要か? 答えはYesだ」 NVIDIA CEOジェンスンが語った2028年ロードマップとNVLink 8の衝撃 -

第872回

PC

NVIDIAのRubin UltraとKyber Rackの深層 プロトタイプから露見した設計刷新とNVLinkの物理的限界 -

第871回

PC

GTC 2026激震! 突如現れたGroq 3と消えたRubin CPX。NVIDIAの推論戦略を激変させたTSMCの逼迫とメモリー高騰 -

第870回

PC

スマホCPUの王者が挑む「脱・裏方」宣言。Arm初の自社販売チップAGI CPUは世界をどう変えるか? -

第869回

PC

半導体プロセスの新たな覇権! インテルのDNNプロセッサーはAMDやMetaを凌駕する配線密度と演算密度 -

第868回

PC

物理IPには真似できない4%の差はどこから生まれるか? RTL実装が解き放つDimensity 9500の真価 - この連載の一覧へ