5月23日に開催したマイクロソフトの開発者向けイベント「de:code 2017」の基調講演。先頃行なわれた「Build 2017」の最新情報を盛り込んだ今年のテーマはずばりAIだ。「インテリジェントクラウド・インテリジェントエッジ」の戦略に基づいたAIへの取り組みについてレポートする。

マイクロソフトのスティーブン・グッゲンハイマー氏とPreferred Networks 代表取締役 西川徹氏

技術者にチャンスと責任がやってきた

毎年、直前に開催されたBuildの最新情報を盛り込み、開発者に向けたビジョンが披露される日本の「de:code」。サティア・ナデラCEOが来日した昨年は、Windows/Office/Azureという3つのプラットフォームを支える技術として紹介されたAIだが、今年は一気に主役に踊り出た印象。Azureのプラットフォームとしての現状やサーバーレスやIoTなどのトピックの説明を潔く省き、全体を通して強調されたのは想像を超えるAIへのフォーカスであった。

冒頭、イベント概要とマイクロソフトの全体方針について語った日本マイクロソフトの伊藤かつら氏は、デジタルテクノロジーの成長が差別化の源泉になるとアピール。データ量の増大とクラウドのパワーにより、技術者がビジネスの中心的な存在になるチャンスが生まれる一方で、テクノロジーの選択という「責任」を負わなければならないと説明した。

日本マイクロソフト 執行役員 デベロッパー エバンジェリズム統括本部長 伊藤かつら氏

こうしたデジタル時代の中、マイクロソフトには不変の価値・原則として「Empower People(人々に力を)」「Inculusive design(すべての人のためのデザイン)」「Bulit trust in technology(信頼できるテクノロジー)」があり、これらが「テクノロジーの上に価値を創出し、社会にインパクトを与える」というミッションにつながっていると説明した。

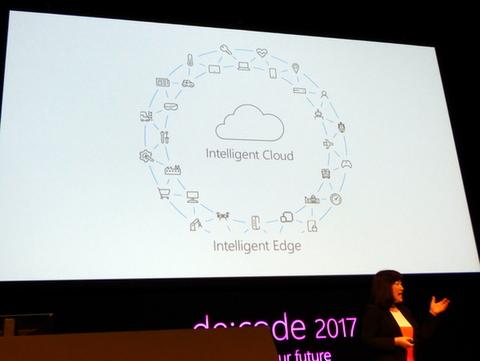

その上で、現在のマイクロソフトが「モバイルファースト・クラウドファースト」から「インテリジェントクラウド・インテリジェントエッジ」という戦略に大きくシフトしていることをアピール。「4年前、この壇上で私は『開発者はヒーローになれる』と話したが、今やまさにその時代が近くに来た」と聴衆に対して、テクノロジードリブンの時代の到来をアピールした。

インテリジェントクラウド・インテリジェントエッジ

AIサービスを容易にカスタマイズできる

続いて登壇した米マイクロソフト コーポレートVP&チーフエバンジェリストのスティーブン・グッゲンハイマー氏は、Fortune500の企業のうち90%以上がMicrosoft Cloudを利用していること、Office 365の月間アクティブユーザーが1億、Cortanaの月間利用が1.4億にのぼったモバイルファースト・クラウドファーストの実績を強調。そして、こうした実績をベースに推進されている「インテリジェンスクラウド・インテリジェントエッジ」の戦略の中で、先進的なAI技術がまさにマイクロソフトの強みとなることをアピールした。

米マイクロソフト コーポレートVP&チーフエバンジェリストのスティーブン・グッゲンハイマー氏

ご存じの通り、AIの研究は古くから行なわれており、コンピューターサイエンスの領域では真新しい分野ではない。しかし、昨今は「コンピューター処理能力の向上」「アルゴリズムの向上」「未曾有の量のデータ」などの促進要素が存在しており、AIの利用が急速に進んでいるという。

グッゲンハイマー氏は、SNSの登録数が570万人に達した女子高生AIである「りんな」や、昨年に俺様キャラとして公開された「りんお」のデモ、あるいはVRを用いることで圧倒的な没入感を実現した「Starship Commander」の開発ストーリービデオを披露。AIがまさに目の前で扱える技術であることをアピールした。さらにAIによる認知を実現する「Microsoft Cognitive Services」では、画像認識、言語理解、スピーチ、検索、意思決定などを顧客ごとに「カスタム化」が可能になったことが説明された。

Cognitive Services群ではAIサービスのカスタム化が可能になった

AIを活用した画像認識やチャットボットはどうすれば実現できるのだろうか? Custom Visionについて説明した日本マイクロソフトのドリュー・ロビンス氏は、まず庭から拝借したもみじ(Japanese Maple)の写真を画像認識させるデモを披露。アプリを実現するために、ほんの少しの画像をアップロードすれば、自動的にモデルが学習できるとアピールした。

日本マイクロソフト デベロッパーエバンジェリズム統括本部 エバンジェリスト ディレクターのドリュー・ロビンス氏

さらに予測精度を上げるためにメニューからアクティブラーニングを実施すると、過去の画像から一番インパクトのある画像を自動的に探索。情報を与えれば、予測精度をより高めることができるという。また、後述するとおり、膨大なデータがある場合はAzure Data Lakeに格納でき、学習済みのAIモデルで分析したり、検索をかけることも可能だ。

続いてチャットボットに関して説明したロビンス氏は、シアトルの美味しいレストランをBingで検索。この検索結果からチャットを直接起動し、レストランに一番美味しいメニューを聞くことができるデモを披露した。こちらは「Adaptive Cards」というフレームワークを使れば、SlackやSkype、Andoroid、iOS、Microsoft Teamsなどに向けて最適化されたカード型のインターフェイスを容易に開発できるという。

単一のフレームワーク、複数のキャンバスを実現するAdptive Cards

グッゲンハイマー氏は、Cognitive ServiceやBotFrameworkのアップデートや、AIのトレーニングをバッチで行なえる「Azure Batch AI Training」などを披露。「いろいろな機能がAI+Azureという形で開発者の手に入るようになってきた。エコシステムと協力しながら、ツールと機能をAI向けに出していく」(グッゲンハイマー氏)とアピールした。

本記事はアフィリエイトプログラムによる収益を得ている場合があります