ビッグデータの敷居を下げるWebクローラー「mitsubachi」の正体とは?

IT業界のマイブラはアキバ価格戦争の勝者だった

2012年04月05日 09時00分更新

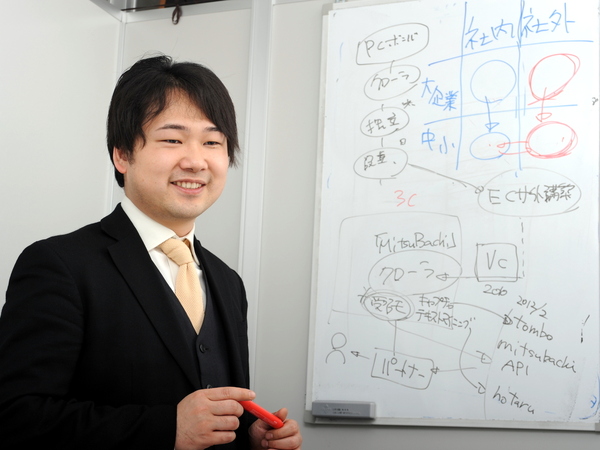

マイブラといえば、シューゲイザーサウンドで1990年代のロックを大きく変革したMy Bloody Valentineの通り名だが、IT業界のマイブラといえば、ビッグデータの仕掛け人として成長が期待されるマイニングブラウニーだ。アキバの価格競争(?)から生まれた同社の成り立ちとビジネスを代表取締役 得上竜一氏を直撃した。

7分で1円下げ!三巴の戦いを制したアルゴリズムが起業のタネ

マイニングブラウニーはWebクローラーとデータマイニングを用いたマーケティングツール「mitsubachi(ミツバチ)」を提供するITベンチャーである。と言われても、一度では理解できないかもしれない。Webクローラーとはなにか? なぜビッグデータが関係してくるのか? そしてマイニングブラウニーのビジネスの本質とは? これを解くため、しばし得上氏の起業物語におつきあい願いたい。

今から約10年前、得上氏が務めていたのは大手の電力会社で、通信系インフラのおもりをやりつつ、夜間学校に通っていたという。その後、入社3年きっかりで会社を辞め、転職した先が秋葉原のPC安売り店だ。「当時はその店は、他のショップとカカクコム上で安売りを競っていた時代でした」(得上氏)という。この価格競争では1時間で10円ずつ下げるというような価格表をExcelで作り、これを手動更新することで行なっていた。

これに対して、得上氏はライバル店の価格と在庫を収集しつつ、十分に利ざやが出る価格を自動的に算出するようにプログラムを組んだ。得上氏は、「夜間のゴールデンタイムにあまり安い価格を出すと、在庫が切れてしまったのに価格が載り続けてしまいます。そこで、その店では7分に1円ずつ下げるというペースで、他社と勝負するようにしました。これだと最低の価格ではなくても、他社の在庫がないので、うちは適正な価格で売れるんです」と当時の勝ちパターンについてこう語る。ここで得上氏が作ったのが、サイトから必要な情報を収集してくるWebクローラーだ。

さて、こうした価格競争で業務に貢献した同氏は、「それだけの腕があるなら、独立しなさいということで、開業を支援してもらったんです」とのことで、起業を決意。2006年にマイニングブラウニーを設立し、市場調査システムの受託開発などをしていた。とはいえ、「価格競争で応用すると、(会社がつぶれてしまうような)けっこう破壊力のある仕組みになってしまうんです」とのことで、価格競争ではなく、特定商品の相場や求人媒体での賃金などを自動的に調べるシステムが多かったという。

ちなみに、マイニングブラウニーのブラウニーとは、靴屋の主人が寝てる間に仕事をしてくれるというグリム童話の小人にちなんだもの。「寝ている間に小人がデータを解析し、経営に有用な情報を作ってくれたらいいですよね」という得上氏の願いから、会社名を名付けたという。

ビッグデータの波に乗るための新しい「mitsubachi」

2010年にはベンチャーキャピタルの資金が入り、初代「MitsuBachi」と呼ばれるWebクローラーエンジンが完成。これは受託システムを前提に、ユーザーが必要な情報やサイトを登録する形で使えるようになっていたものだ。しかし、その後は会社の方針を変更し、受託システムの開発自体をパートナーに委託。マイニングブラウニー自体は、クローラーエンジンをイチから書き直した。こうして完成したのが、2012年2月にリリースされたばかりの現行のmitsubachiである。

新しいmitsubachiは、中小企業にシステムを提案するSIerなどが外部から利用するのを前提に、Web APIから利用可能なクラウドベースのエンジンに生まれ変わっている。もとより同社は、Amazon EC2をサービス開始当初から利用しており、サーバーやストレージ自体を早い段階からクラウドで運用していた。最近では、Amazon Dynamo DBなどのオンラインDBも積極的に使いこなしているとのこと。運用負荷のかかるシステム運用が従量課金のクラウドに委託できたからこそ、新しいmitsubachiが実現できたわけだ。

mitsubachiは申し込んでAPIキーを取得すれば、すぐに利用できる。得上氏は、「SDKやドキュメントを使って、パートナーさんには収集対象の示すスクリプトを書いてもらい、API経由でサーバーにデプロイします。あとはHTTPでのフェッチを指示すれば、クローリングが開始します。再帰的にクローリングすることも可能です」と説明する。集まったデータはMySQLやDynamo DBに格納し、テキストマイニングのエンジンを使って分析してもよい。「たとえば、コマースサイトの★5つのレビューに含まれているテキストを収集して製品開発に活かしたり、★1つのレビューでクレームを拾うといったことが可能になります」とのこと。「受託システムで培ってきたノウハウを活かしたWeb画面のキャプチャーやテキストマイニングなども、別サービスとしてリリースする予定になっています」(得上氏)ということで、宝の山であるWebの情報を最大限に活用できるフレームワークに成長しつつある。

このように開発スピードを上げ、クラウドに依存した大胆なビジネス方針の変換を進めているのは、昨今のビッグデータの波に乗るという目的がある。得上氏は、「既存のデータマイニングは、基本的には大企業の社内データが対象。ビッグデータ自体を持っていないところが多いんです。われわれはWebクローラーで集めたビッグデータを中小企業で活用できる下地を、他社に先行して提供していこうと考えています」と同社の戦略についてこう説明する。冒頭に「ビッグデータの仕掛け人」と書いたのも、ビッグデータの裾野を拡げるためのプラットフォームをビジネスの根幹に据えているからだ。「クラウドベースのAPIが理解できる人であれば、すぐに使えます。データマイニングを始められない中小企業がスモールスタートするのに最適です」(得上氏)とのことで、費用対効果の高いソリューションを目指す。

この連載の記事

-

第7回

ビジネス

B2BのクラウドをB2Cの流儀で使いやすくする「Coubic」 -

第6回

ビジネス

漁船や脱穀機を無料でゲット?地元に根ざすジモティーの深謀 -

第5回

ビジネス

仕訳が楽しくなるクラウド型会計ソフト「Freee」って知ってる? -

第4回

ソフトウェア・仮想化

スマホもPCも!フルクラウドの端末管理「WinView」の実力 -

第2回

ビジネス

クラウドでLED調光!NetLEDを開発したベンチャーの深謀 -

第1回

ビジネス

大ヒットMDMは余技?クラウドネイティブな「CLOMO」の価値 -

ビジネス

日本のITを変えるクラウド世代のベンチャーたち - この連載の一覧へ