「Google Cloud Next '26」現地レポート 第2回

Google Cloud Next '26レポート、Geminiのエージェント基盤、第8世代TPU、Wiz買収の狙いなど

「すでに開発コードの4分の3はAI生成」 Google Cloud CEO、エージェント時代の戦略を語る

2026年05月07日 07時00分更新

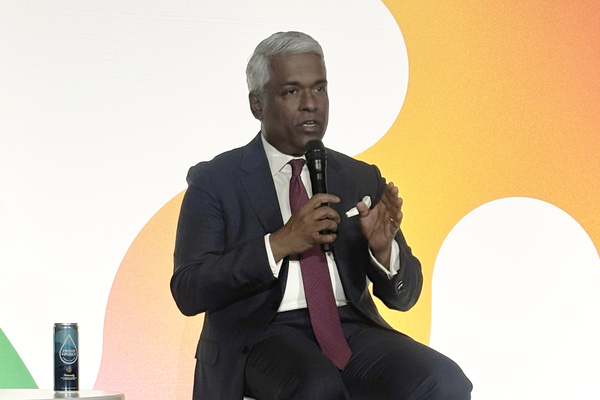

Google Cloudが2026年4月に米国で開催した年次カンファレンス「Google Cloud Next '26(以下、Next)」。会期中、Google Cloud CEOのトーマス・クリアン氏が記者向けの質疑応答を行い、現在のGoogle Cloudの戦略を話した。

クリアン氏の発言からは、IaaS/PaaSから始まり、AIモデル、セキュリティ、チップなどへ領域を広げてきたGoogle Cloudが、それらを一つのスタックとして統合し、「AIエージェント企業」の基盤を提供する存在へと変貌しつつある現在が浮かび上がった。

差別化ポイントは「フルスタックの垂直統合」と「オープン性」の両立

今年のNextにおいて、Google Cloudは満を持して「Gemini Enterprise Agent Platform」を発表した。これはAIエージェントの構築から、管理、スケール、最適化まで、エンドツーエンドでカバーするプラットフォームである(関連記事:AIエージェントだけで“1万人参加のマラソンイベント”を計画せよ ― Google Cloudが年次イベントでデモ)。

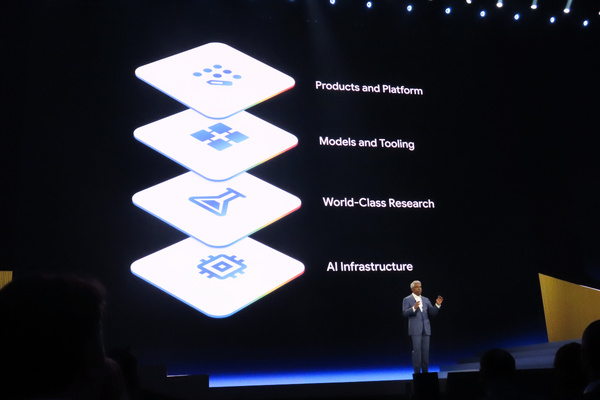

ここ数年のNext基調講演で、クリアン氏は繰り返し、Google Cloudが「フルスタックのAI企業」であることを強調してきた。ユーザーが直接使うプロダクトやプラットフォーム、AIモデルやツールだけでなく、世界レベルのAI研究、さらにAIインフラまでを備える“ユニファイド(統合)スタック”を持つAI企業はほかにない、という主張だ。

「われわれは、独自のチップ(TPU:Tensor Processing Unit)と独自のフロンティアモデル(基盤モデル)を持つ、唯一のハイパースケーラーだ」(クリアン氏)

ハイパースケーラー他社の動向を見ると、AWSが独自のAI専用チップ(Trainium)を開発しており、2024年末にはフロンティアモデル「Amazon Nova」も発表している。したがって、Google Cloudが“唯一”という表現はやや大げさだが、Google Cloudが大きく先行しているのは事実だろう。

また、OpenAIやAnthropicといったAI企業は、フロンティアモデルの提供では大きな力を持つものの、セキュリティやデータプラットフォームの側面はカバーしておらず、顧客自身がそれを解決しなければならない。

クリアン氏は、そうしたすべてを自社で垂直統合しているのがGoogle Cloudだと強調する。「コンピューティングからエージェントの実行効率、エージェントによるツールアクセスまで、スタック全体を一気通貫で最適化できる」と述べたうえで、「スタックの幅と言う点で他社との差別化が図れている」と続ける。

こうした統合は、組織横断的な協業体制で支えられているという。「(AI研究機関である)DeepMindとは、週次でイテレーションを回している。モデルに改善が必要な箇所が見つかったら、最適化のためのトレーニング環境やデータをDeepMindに提供する」と説明する。Google Cloudだけでなく、Google全体を横断して長期的な課題に取り組む体制が、包括的なスタックを可能にしていると語った。

ただし、その一方で「企業がすべてをGoogleから調達することを期待しているわけではない」とも述べる。「垂直統合」と同時に「オープン性」も持つこと、その両立がGoogle Cloudの基本姿勢だ。

たとえば、NVIDIAとは緊密なパートナーシップを結んでおり、今回のNextでは「NVIDIA Vera Rubin NVL72」をいち早く提供することを発表した。またモデルに関しても、サードパーティ製の複数のモデルをサポートしている。

「シリコン層もデータプラットフォーム層も、セキュリティ層もオープンに保っている」「Google Cloudの差別化は、スタックの各層を高品質に保ちながら、深く統合した点にある。そのうえでオープンなアーキテクチャを維持することで、顧客に『選択の自由』を提供している」

企業のデータは外部のアプリケーションやサービスに分散しているため、AI活用においてはそれらとのオープンな連携も重要だ。ここでは、すでに100以上のコネクターを提供していると紹介した。カバー領域は「ドキュメント系」(Box、Dropbox、SharePointなど)、「SaaSアプリケーション」(Workday、ServiceNow、Salesforce、Oracle、NetSuiteなど)、「データベース」(Oracle、Databricks、Snowflakeなど)、そして「ソフトウェアエンジニアリング」(Atlassianなど)の4つだ。

コネクターに加えて、Google Cloudは「Bring Your Own MCP」として、企業が自社システムをMCP経由で接続できるようにする機能を発表したことにも触れた。

第8世代のTPUを発表、トレーニング用と推論用は異なる設計に

今回のNextで、Gemini Enterprise Agent Platformと双璧をなす発表となったのが、最新TPU「TPU 8t」「TPU 8i」の発表だ。Google CloudのTPUは8世代目だが、今回はトレーニング向け(TPU 8t)と推論向け(TPU 8i)と用途を分けて、2種類がラインアップされた。2種類に分けた理由は、トレーニング処理と推論処理の要件が「根本的に異なるから」だという。

トレーニング用のTPU 8tは、ICI(Inter-Chip Interconnect)技術により、1つのスーパーポッドに9600チップ、2ペタバイト(2PB)の共有高帯域メモリを搭載し、超低遅延での処理を実現する。前世代のIronwoodと比べて処理性能は3倍、電力効率は2倍に向上した。水冷設計を採用しており、大規模なロケーションでの利用を想定している。

一方で、推論用システムは、処理のレイテンシを抑えたり、データ主権を確保したりするために、多くの拠点に分散配置する必要がある。水冷設備のないデータセンターやエッジ拠点にも対応できるよう、推論チップでは空冷設計を採用している。

推論用TPU 8iのチップ設計で、特筆すべきは新しいメモリシステムの採用だ。クリアン氏は、エージェントの普及が、チップの設計思想そのものを変えつつあることを説明した。

「エージェントの構築が高度化するにつれて、メモリに保持するデータ量が増えている。推論処理ではデータを長時間保持するキャッシュの仕組みが必要であり、これはトレーニング用チップに必要な設計とはまったく異なる」

本記事はアフィリエイトプログラムによる収益を得ている場合があります