画像クレジット:Stephanie Arnett/MIT Technology Review | Getty, Adobe Stock, Envato

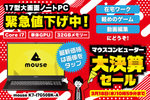

実質現実(VR)を用いた警察官の訓練、センサーの網に監視される都市、生成AIによる報告書の生成——。米国の1万8000もの警察組織のトップらが参加するカンファレンスでは、こうしたAI活用法が紹介された。

この記事は米国版ニュースレターを一部再編集したものです。

世の中には、記者がなかなか通してもらえない扉がある。国際警察署長協会(International Association of Chiefs of Police)のカンファレンス会場の扉はまさにその1つで、永久にメディアに閉ざされていると言っても過言ではない。だからこそ10月、ボストンでのカンファレンスへの出席が認められたのは、私にとって嬉しい驚きだった。

このカンファレンスは米国最大の警察幹部の集まりとして知られている。米国の1万8000もの警察組織のトップや海外からの参加者も含めた人々が、製品のデモ、討論会、パーティ、表彰式に参加するために集まる。

私がカンファレンスに出席したのは、人工知能(AI)についてどのように議論されるのかを見届けるためだった。そして、そこで話された警察幹部へのメッセージは明確だった。「もしあなたの組織でAIの導入が遅れているなら、いますぐに手を打つべきです。未来の警察活動は、あらゆる形態のAIに依存することになるですから」。

イベントが開催された展示場には600社以上の企業が集い、急成長中の警察テック・サプライヤー業界の一端が垣間見えた。AIとは無関係なブースもあった。ボディ・アーマー(防弾チョッキや防刃ベストなど)、ライフル、警察用サイバートラックのプロトタイプもあれば、捜索中に注射針などから捜査員の手を保護するという新型手袋もあった。だが、AIが最大の注目の的であることは、人だかりを見れば明らかだった。

話題の中心は、警察活動における3つのAIの用途だった。もっとも目を惹いたのは実質現実(VR)で、警察官の訓練用VRシステムを販売する「Vアームド(V-Armed)」のブースが典型例だ。同社は、展示場のフロアにVRゴーグル、カメラ、センサーを完備したアリーナを設置した。同社が最近、ロサンゼルス市警察本部に導入したものとよく似ていた。参加者たちはゴーグルを装着し、無差別銃撃事件への対応を想定した訓練を体験した。展示場には同社のライバル企業も数多く出展し、低価格、高効果、容易な維持管理などを宣伝して、自社システムを売り込んでいた。

VRを用いた訓練の宣伝文句は、長期的に見れば俳優を起用した訓練や座学と比べ、安価で没入的であるというものだ。「楽しんで取り組むことができれば、より集中できますし、PDFを見ながら相づちを打つよりも記憶に残ります」とVアームドのエズラ・クラウス最高経営責任者(CEO)は語った。

しかし、VRによる訓練効果はまだ十分に検証されておらず、警察官が実世界で経験する繊細なインタラクション(やり取り)を完全に再現できるものではない。AIはまだ、一般大衆とのインタラクションに必要なソフトスキルに関して、あまり優秀とは言えない。別の企業のブースで、私は緊張緩和に特化したVRシステムを試してみた。訓練に参加する警察官の課題は、極度の興奮状態にあるAIキャラクターを落ち着かせることだ。だが、タイムラグの問題に加え、やりとりは概してぎこちなかった。キャラクターの返答は演出過剰で、いかにもプログラムされたものという印象だった。

2番目の話題は、警察組織によるデータの収集と解釈の方法が変わりつつあるというものだ。発砲検知ツールはA社、ライセンス・プレート読み取り機やドローンはB社といった従来の個別契約から、少数の先進的企業からセンサーやカメラなどのツールを一括購入する警察組織が多くなる傾向が高くなっている。こうした企業は、収集したデータを統合し、多角的に活用するシステムを掲げている。

警察幹部たちは、そうしたシステムの構築方法を学ぶセミナーに参加した。その中には、マイクロソフトとニューヨーク市警察本部が共催する、ニューヨーク市で採用されている「ドメイン・アウェアネス・システム(Domain Awareness System)」について説明するセミナーもあった。このシステムはナンバープレート読み取り機、カメラ、その他の情報源を利用して、犯罪の記録と監視をするものだ。カンファレンスのスポンサーであるアクソン(Axon)とフロック(Flock)の巨大なハイテク・ブースは、大勢の参加者を集めていた。フロックは、カメラ、ナンバープレート読み取り機、ドローンをセットで販売するとともに、記録されるデータを分析し警報を発するAIシステムを提供している。この種のツールは人権団体から厳しい批判を受けている。その批判は、こうしたツールの使用はプライバシーの侵害であるうえ、ほとんど一般大衆の利益につながらないというものだ。

3番目の話題は、他の業界と同様、警察分野でも事務仕事や報告書作成の単純作業を軽減するAIが登場している。アクソンを含め、警察官の報告書作成を補助する生成A製品を提供する企業は多い。アクソンの製品「ドラフト・ワン(Draft One)」は、ボディカメラの映像を読み込み、文字に起こし、警察官の代わりに報告書の第一稿を完成させる。

「警察官の身体にはこれ(カメラ)があり、事案についてのあらゆる情報を綿密に記録しています」とアクソンのブライアン・ウィーラー上級副社長は会場で語った。「これを使って、警察官の業務をより迅速かつ効果的にできれば良いのでは?」

一見したところ、文書作成はAIと相性のいいタスクに思える。AIは情報を瞬時に要約し、型通りに書くことに長けている。現状、警察官は報告書作成にかなりの時間を割いているため、リソースの大幅な節約にもつながるだろう。 しかし、AIが幻覚(ハルシネーション)を起こしやすいことは、避けて通れない事実だ。たとえ最終段階で警察官が報告書の筆者になるとしても、このようなツールを導入する警察組織は、法執行機関の根幹をなす文書の1つに、エラーの可能性を招き入れることになる。

「警察の報告書は時に事案の唯一の公的記録になります」。アメリカン大学のアンドリュー・ファーガソン教授(法学)は、2024年7月に法律評論記事で論じた。AI作成の警察の報告書が提起する重大な課題に関して、初めて取り上げた評論だ。「刑事事件の裁判が始まるまでには数カ月から数年を要することもあるため、警察の報告書の正確性はきわめて重要です」。どのような情報が詳細に記載され、除外されるかは、保釈金の金額決定から判決に至るまで、あらゆる結果に影響を与える可能性がある。

警察官にAI生成バージョンの報告書を提示することで、このツールは報告書が完成する前にボディカメラ映像から得られた詳細情報を警察官に見せることになる。本来、警察官自身の記憶に基づいて事案を記録することを目的とした報告書の意図に反するという問題を引き起こす。

「警察は目撃者に状況説明をさせる前に、映像を決して見せたりはしません。それは捜査手法として完全に不適切だからです」。米国自由人権協会(ACLU)の言論・プライバシー・テクノロジー・プロジェクト(Speech, Privacy, and Technology Project)で上席政策アナリストを務めるジェイ・スタンリーは指摘する。同プロジェクトはこのテーマでの調査結果をまもなく公表する予定だ。

アクソンの広報責任者は、こうした懸念は「ツールの想定される運用方法を反映したものではない」とし、ドラフト・ワンには警察官が報告書を注意深く読み、自ら情報を書き加え、正確を期して報告書を編集したうえで提出するように促す、十分な機能が搭載されていると話す。

このカンファレンスから得られた最大の教訓は、米国の警察は本質的に混沌とした方法でAI導入を進めているというものだ。 テクノロジーの利用方法の指針を定める政府機関はなく、全米約1万8000の警察組織(正確な数字すら不明だ)は、驚くほど自主独立的な方法で、どのAIツールを購入し導入するかを決めている。製品を提供する警察テック企業は、警察組織にとって魅力的なツールを開発するだろう。倫理、プライバシー、正確性について、今後誰かが適切な基準を設けるかどうかは不透明だ。

先行きが見えてくるのは、第2次トランプ政権の発足後になるだろう。トランプ次期大統領は2023年の選挙キャンペーン中、警察活動についての公約を発表し、「ストップ・アンド・フリスク(職務質問と所持品検査)」の積極展開、移民局との連携強化、不正行為を告発された警察官への法的保護の強化を掲げた。報道によれば、バイデン政権は2025年1月までに警察改革の提案内容の一部の制度化を目指している。

警察組織のAI使用に関して連邦政府の規制がなければ、基準を定めるのは警察組織と警察テック企業という当事者になるだろう。

「結局のところ警察テック企業は営利目的で、顧客が法執行機関なのです」とスタンリーは言う。「警察テック企業のビジネスモデルと対抗する非常に大きな脅威がない限り、警察テック企業は顧客の期待に応えるでしょう」。

生成AIの「搾取」に技術で立ち向かう研究者

生成AIツールの登場直後から、アーティストはこれは新手の窃盗だとみなし、すぐさま懸念を抱いた。コンピューター・セキュリテイ研究者のベン・ジャオ教授はすぐさま行動を起こした。シカゴ大学の自身の研究室で、「ナイトシェード(Nightshade)」や「グレイズ(Glaze)」といった、AIモデルのスクレイピングから作品を守りたいアーティストを支援するツールの開発に着手したのだ。本誌のメリッサ・ヘイッキラ AI担当上級記者は、同教授と研究チームに密着し、訓練用の画像、アートといったデータを求める、AIの果てしない食欲にストップをかけるための強力なツールの開発の舞台裏を報じた。

現在のAIのパラダイムでは、モデルをどんどん大きくすることが最優先されており、それには膨大な訓練データが必要だ。テック企業は、インターネット上に公開されているものはすべて利用対象だと主張するが、アーティストは報酬や拒否権を求めている。この対立をめぐる法廷での決着や規制の制定には数年かかる。そのため今のところ、アーティストはナイトシェードやグレイズといったツールを利用するしかない。もしもこうしたツールが、よりよいモデルの構築を目指すAI企業の取り組みを損なえば、彼らを交渉のテーブルに就かせ、ライセンシングや正当な対価について議論することが可能になるかもしれない。しかし、これはあくまで仮定の話だ( 『アーティストに希望、生成AIの搾取と闘うセキュリティ研究者たち』を読む)。

AI関連のその他のニュース

- テック・エリートたちはイーロン・マスクをトランプ政権の要職に推薦している。テック業界のリーダーの中で、もっともトランプ次期大統領に意見できる立場にいるのがイーロン・マスクだ。そのため、AI、テック業界の人たちは次期政権への影響力を得ようと躍起となっており、仲介役としてマスクを味方につけようとしている。(ニューヨーク・タイムズ)

- オープンAIは、タスクを自動化するAIエージェントの発表を控えている。AIエージェントは、あなたに代わってタスクをこなしてくれるモデルであり、その用途は幅広い。オープンAI(OpenAI)によるAIエージェントのリリースは近い、というニュースが報じられたのは、AI企業のアンソロピック(Anthropic)が独自のAIエージェントを発表したわずか数週間後だった。(ブルームバーグ)

- AI音声の多様化を進める草の根の取り組み。幅広い年齢や性別の人々から、より多くの言語の訓練データを収集することを目指すボランティア主導の大規模な取り組みによって、次世代の音声AIはより包括的で搾取の少ないものへ近づくかもしれない。(MITテクノロジーレビュー)

- グーグル・ディープマインドが、AIの頭の中を覗く方法を新たに開発。オートエンコーダー(autoencoder)を使えば、人工知能(AI)のブラックボックスを覗くことができる。理解しやすく制御しやすいAIの構築を実現する助けにもなるだろう。(MITテクノロジーレビュー)

- イーロン・マスクはオープンAIに対する訴訟戦線を拡大し、マイクロソフトも標的に加えた。イーロン・マスクはオープンAIに対する連邦訴訟において、同社が非営利組織としてのルーツと責務を放棄したと非難している。マスクはこの訴訟に争点を追加し、今度はマイクロソフトがオープンAIとの事業において反トラスト法違反をしたと訴えている。(ワシントンポスト)