UbuntuのインストールからAI TOP Utilityの設定まで!

GIGABYTEのAI TOPで自分だけのAIを作れるようになろう

Llama-3.1-8B-Instructのインストール

AI TOP Utilityのインストールも完了してこれで一件落着なのであるが、先に示したPDFでは、Hugging FaceからLlama-3.1-8B-InstructをダウンロードしてAI TOP Utilityに追加できることを確認するように説明がある。これをやらなければいけないわけではないが、手順を示しておきたい。

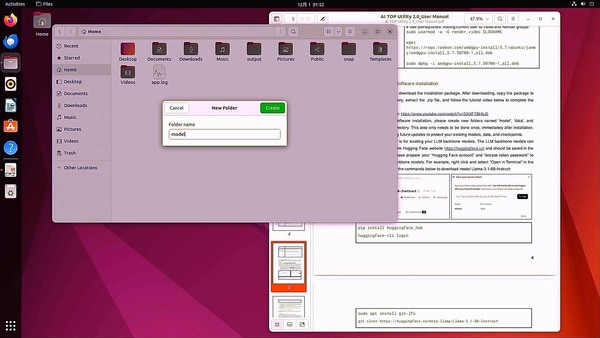

(1) Homeディレクトリに"model"、"data"、"output"の3つのフォルダを作成する。ちなみに"output"はAI TOP Utilityのインストール後に自動生成されていたので、"model"と"data"だけ追加する。

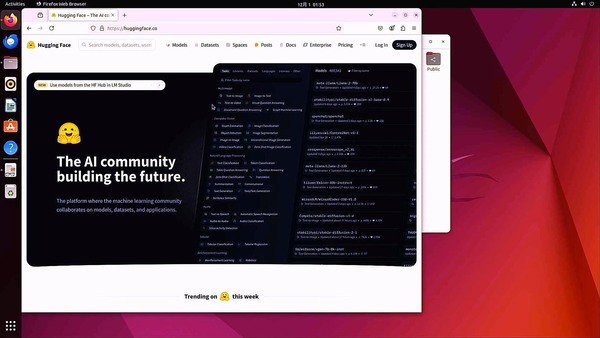

(2) Hugging Face(https://huggingface.co)にWebブラウザでアクセスする。

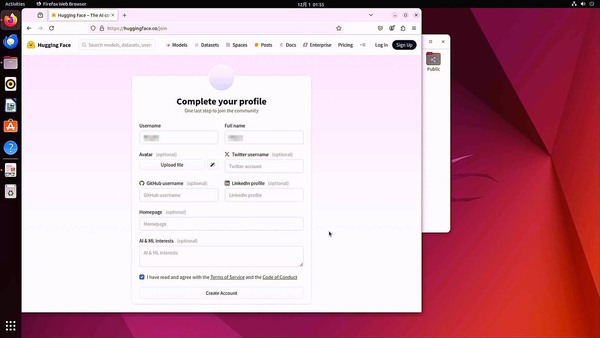

(3) 右上のSign Upを選んでユーザー登録を行なう。まずE-mailとパスワード、次いで細かいプロファイル入力を行なう。しばらく(今回だと数分)後にVerification mailが届くので、確かに自分で登録した、とConfirmation Linkをクリックすることでユーザー登録が完了する。

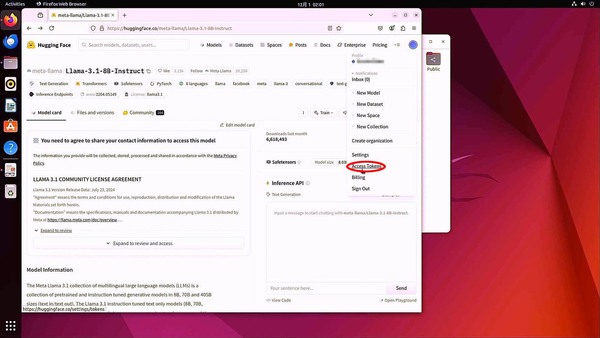

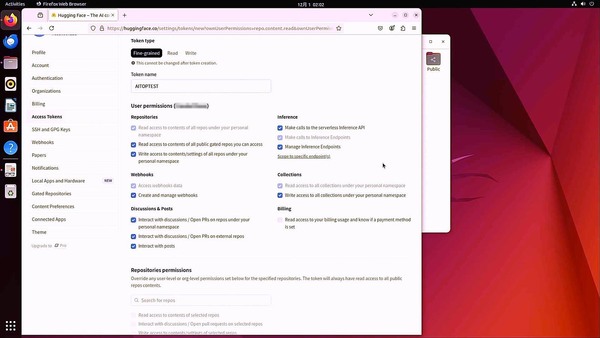

(4) Access Tokenを生成する。これはサイト右上のアイコンをクリックし、プルダウンメニューで"Access Tokens"を選び、その先で"Create new token"を選ぶ。

すると下の画像にある画面が出てくるので、項目を埋めてからページの一番下にある"Create token"をクリックする。

すると生成したTokenが表示されるのでCopyボタンを押してコピーし、テキストファイル(画面左、上から8つ目がテキストエディターなので、これを開く)に保存しておくのが便利だ(すぐ後で使う)。

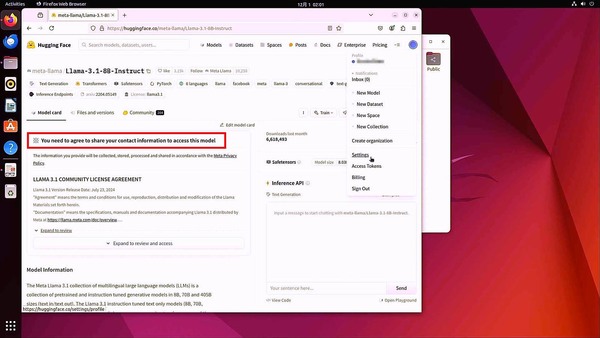

(5) Llama-3.1-8B-Instruct(https://huggingface.co/meta-llama/Llama-3.1-8B-Instruct)を探す。これはHugging Faceのトップページの検索窓で"Llama-3.1"と入れれば候補が出てくるので、そこから選べば簡単だ。

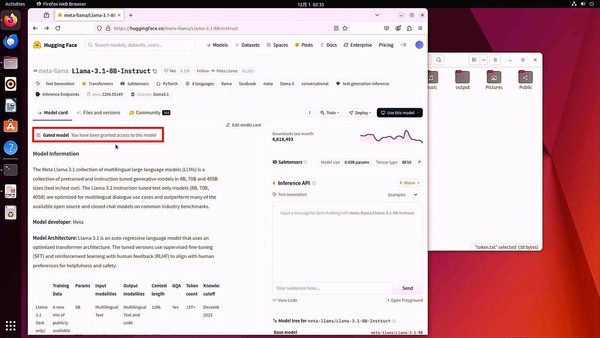

ただしLlama-3.1-8B-Instructの利用には許可が必要である。赤枠の下に"Expand to review and access"という項目があるので、これを展開して名前と生年月日、国、所属(筆者はフリーランスライターなので素直に"Freelance"と書いた)、職業を埋めて、条件に同意するチェックを入れて送信したところ、15分程度でアクセス許可が下りた。これでWebサイト側の作業は完了である。

(6) HomeディレクトリでTerminalを開き、以下の手順を実施する。

pip install huggingface_hub

~/.local/bin/huggingface-cli login

sudo apt install git-lfs

git clone https://huggingface.co/meta-llama/Llama-3.1-8B-Instruct

ちなみにhuggingface-cli loginを実施すると、Tokenの内容を入力するように求められるので、先ほどテキストエディターにコピーしておいたTokenをコピー(Terminalで右クリックするとコンテクストメニューからPasteが選べるので、これを利用する)して入力する。こちらのインストールには20分以上を要した。

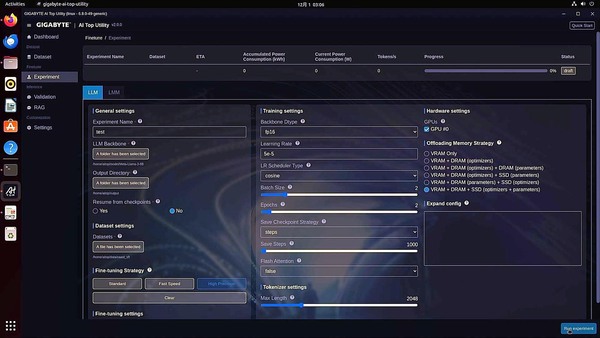

これが終わると、AI Top Utilityの中にLlama-3.1-8B-Instructが登録されていることが確認できた。これで問題なく利用できるようになる。

左ペインで"Experiment"を選ぶと、LLM Backboneに/home/aitop/model/Meta-Llama-3-8Bと表示されており、Llama-3.1-8Bが利用可能になっているのがわかる

以上でインストール作業は完了である。後は思う存分、AI TOPを利用していただきたい。さらにLLMをファインチューニングしたい場合は、下の動画を参考にするといいだろう。なお、今回使用した各種AI TOPハードウェアは、2025年初旬に日本で発売予定となっている。

本記事はアフィリエイトプログラムによる収益を得ている場合があります