AIの処理性能は12倍に! 車内でできることが大きく増える

より大きく性能が向上しているのが、AIの処理を担うHexagon NUPで、こちらは前世代との比較で性能が12倍も向上している。AIや生成AIをスマートコックピットに取り込むためだ。基調講演では、応用例の1つとして、車内で子供の数学のテストのための問題を生成AIで作成し、音声で読み上げるというユースケースが紹介された。

また、AIを安全性能を上げるための歩行者認識に活用しつつ、位置情報で近くに駐車場がないことを知らせたり、目の前にある歴史博物館の情報を表示するといった事例も紹介された。AIの処理能力が高まることで、できることの広がりを示していたのだ。

Snapdragon Cockpit EliteにはAI Audioチップも搭載されており、これによってシートごとに異なる音楽や音声を流す「zonal audio」にも対応できる。後部座席に乗っている人には音楽やモニターに表示している映画の音声を流しつつ、運転手にはナビゲーションの声が聞こえるようにするといったことが可能になる。スマホで培ったアドバンテージを活かし、車載用のプロセッサーも進化させた。

グーグルとの提携で車載用Google Cloudを採用することに

Snapdragon Summitの基調講演では、グーグルとの戦略的提携も発表され、ゲストとして同社のグローバル・オートモティーブ・パートナーシップ担当のディレクター、グレチェン・エフゲン氏が登壇。車載用のSnapdragon Digital Chassisで利用するための生成AI対応デジタルコックピットの開発フレームワークや、車載用のクラウドGoogle Cloudを提供していく方針が語られた。

Snapdragon Cockpit Eliteと同Drive Eliteは、2025年にサンプル出荷が開始される。搭載した自動車が登場するのは、2026年ごろになる見込みだ。

スマホのように、即製品発表とはいかず、サンプル出荷から製品投入までにタイムラグがあるが、各種開発キットを活用することで従来よりも期間は短縮できているという。

サンプル出荷前のため、Snapdragon Summitの会場では、第4世代となる既存のSnapdragon Cockpitを使ったスマートコックピットのデモが行なわれていた。

まず紹介するのが、パーソナルアシスタント。声で語りかけるだけでその車のマニュアルを表示できたり、目的地のランドマークやそこへの行き方が表示されたりといったユースケースを紹介していた。

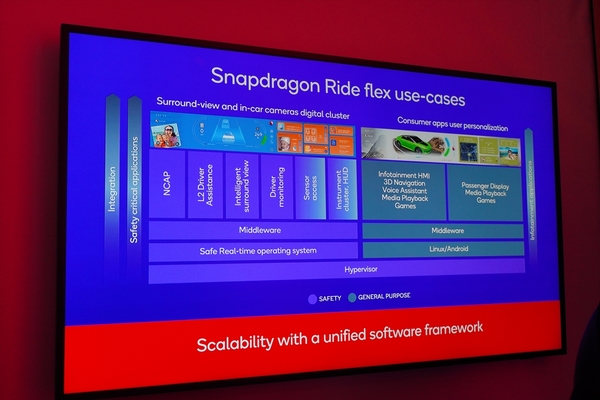

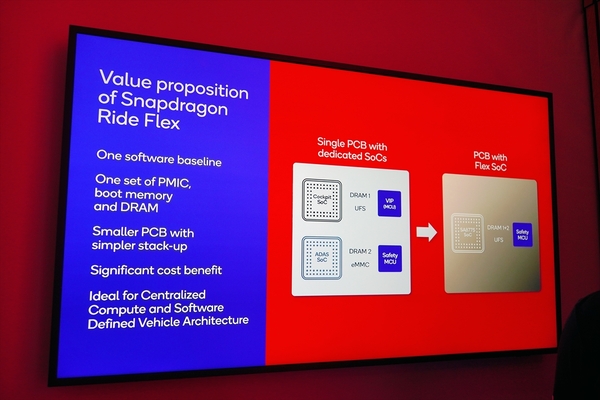

1つのチップセットでコックピットの機能と安全走行のための機能を両立させる「Snapdragon Ride Flex」の展示では、モニターを2つに区切り、ADASとナビゲーションが同時に動作している様子を確認できた。クアルコムによると、1チップで両方の処理をまかなえることから、よりコストを抑えた大衆車向けのソリューションになるという。

デモは現行のチップが使われていたが、同様に1チップでSnadpragon CockpitとSnapdragon Rideを兼ねる仕組みはSnapdragon Cockpit/Ride Eliteでも用意される。

PCではAI、生成AIへの対応はスマホやPCの潮流になっているが、Snapdragon Cockpit/Ride Eliteの登場で、その流れは自動車にも波及することになりそうだ。

Snpadragon Summitで示されたユースケースは、まだ必要性や実用性に疑問符がつくようなものもあったが、これらのプラットフォームを活かしたメーカーごとの工夫にも期待したい。