今回のWWDCでの発表を見ると、「オンデバイスAI」の価値が高まっているのに気づく。AI(機械学習)系の処理といえば、これまではクラウドと連携して圧倒的なデータ量を活かすもの……という印象もあったが、もうそうではない。

この変化はアップルだけの傾向ではないのだが、アップルは特に一気呵成に攻めてきた。その背景こそが、今年のアップルを考える上で重要なことなのではないか、と考えている。

Siriから写真まで、オンデバイスAIが活躍

秋に公開される新OSから「オンデバイスAIで強化される」機能はたくさんある。

まずわかりやすいのは「Siri」。これまでは特定のタイミングでのみデバイス内で処理されていたが、これからはデフォルトでデバイス内の処理に変わる。結果として、メッセージを送信する場合や、あまり使われない命令への反応に必要な情報を得る場合を除くと、音声認識も合成も、そして「判断」もネットを介さずに行われるようになった。

そうなると、飛行機の中などで通信ができない時にもSiriが使えるようになるし、ネットを介さない分反応が速くなって使い勝手も上がる。

iOSやiPadOSのSiriもそうだが、HomePodやApple TVなどのホームネットワーク機器でもSiriはオンデバイスになる。これは、機器連携をする上で確実にプラスだ。ネットワークが仮に落ちても、Siriからの操作ができることになるからだ。なお、Siriは今後ホームネットワークで、サードパーティでの活用が可能になっていくが、その際もサードパーティ側のサーバーにはアクセスせず、Siriネットワークのみを使う。こうした点は、速度だけでなく安定性にも寄与する。

オンデバイス、という意味では「写真」もそうだ。意外と知られていないが、アップルは以前より、画像系の処理を「できる限りオンデバイス」で行なうことを基本としてきた。Googleフォトがクラウドに写真を蓄積し、クラウドのパワーを使うことを前提としたこととは対照的である。

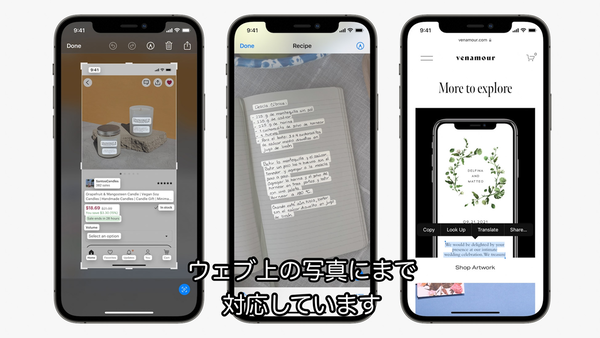

iOS 15では、特に写真の分析・分類についていろいろな機能強化が図られている。その最たるものが、画像内の文字を「テキスト情報」に変える「Live Text」だ。日本語に対応していないのが残念だが、これも文字認識のロジックをダウンロードした上で、オンデバイスで処理される。

少し意外かもしれないが「写真」という意味では、ホームネットワークの新機能でも使われている。自宅にドアカメラがあり、それがアップルのホームネットワークと連携する場合、画像から「置き配」の荷物が玄関に届いたことを検知する機能がある。

どうやらこの機能、カメラ側のAIでもクラウドのAIでもなく、HomePodやApple TVといった、HomeKit対応ホームネットワークのハブになるデバイスの「オンデバイスAI」で荷物の形を認識して、通知を出しているようだ。スピーカーのオンデバイスAIでホームネットワークが進化する、というのはおもしろい。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第22回

Apple

仕事&エンタメに無双の活躍!macOS Montereyパブリックベータを試す -

第21回

Apple

iPadとMacの境界がさらに曖昧になる「iPadOS 15」パブリックベータの注目点 -

第20回

Apple

アップル次期macOS「Monterey」成熟が楽しみなパブリックベータ注目ポイント -

第19回

Apple

アップル「iPadOS 15」は日本語の手書き文字認識に対応で、仕事にも勉強にも便利 -

第18回

Apple

iPhone「iOS 15」パブリックベータを体験! 即戦力になる機能はこれだ -

第17回

Apple

Apple Watch「新watchOS 8」パブリックベータ、集中モードやマインドフルネス試した -

第16回

iPhone

iOS 15のパブリックベータが広くインストール可に 新機能「集中モード」に注目 -

第15回

iPhone

iOS 15/iPadOS 15のパブリックベータが登場 -

第14回

Apple

アップル担当者に聞くwatchOS 8に初搭載「マインドフルネス」アプリの効果 -

第13回

Apple

WWDC2021 トピックの時間配分から浮かび上がるアップルのプライオリティ -

第12回

Apple

Apple Musicに「空間オーディオ」登場! 楽しむ方法を徹底解説 - この連載の一覧へ