Infinity Fabricの

信号速度は50Gbps

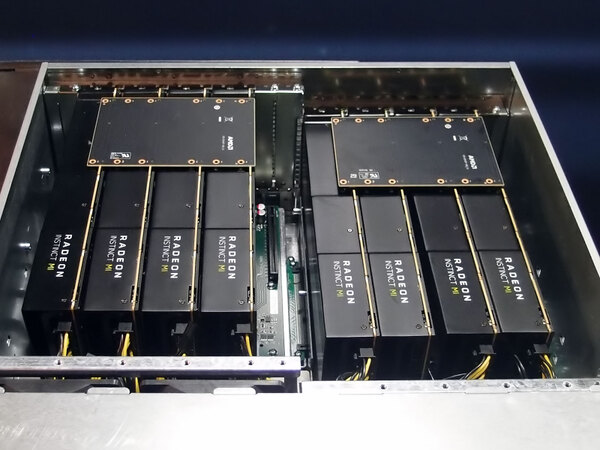

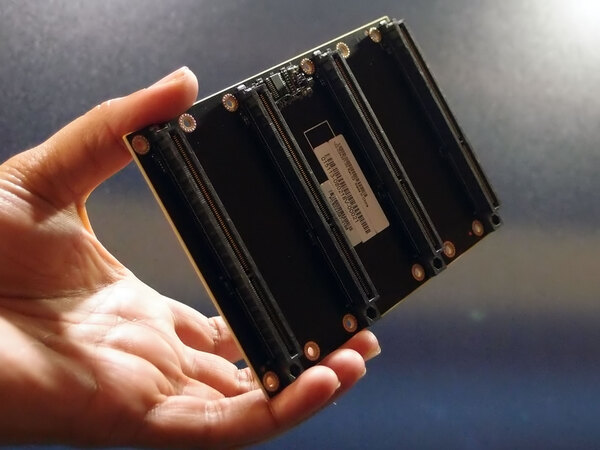

次にInfinity Fabricの話をしよう。上の画像はサーバーシャーシにRadeon Instinct MI60を8枚装着した構成だが、4枚のRadeon Instinct MI60の上に結構大きな板が載っているのがわかる。その板は下の画像のような感じだ。

説明によれば信号はx16構成ということなので、信号速度は50Gbpsという計算になる。下の画像が妙に頑丈なシールド構成になっており、しかも途中にバッファらしきものが入っているのは、50Gbpsで信号を通すためだとすれば納得がいく。

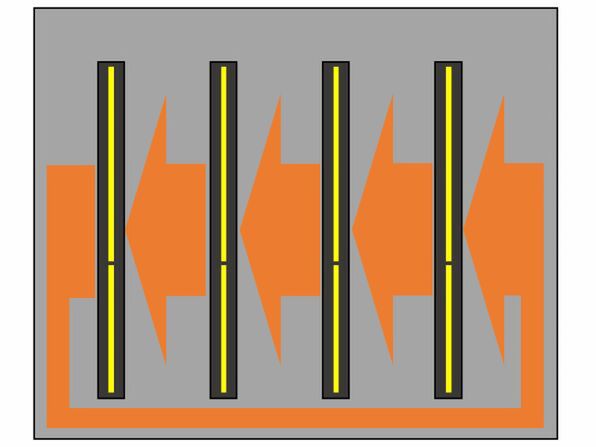

このInfinity Fabricであるが、説明によれば双方向ではあるが、構成はRing Busになっているという話であった。要するに上の画像のコネクターは、内部的には図のような配線になっている模様だ。

Radeon Instinct MI 50/60側は送信/受信ともに100GB/秒(50Gbps×16)で行なう格好である。この構成の場合、隣接するノードに最短だと1hop、最長だと3hopで通信することになるあたり、二重リングになっている可能性もある(そのあたりまで突っ込んでは教えてくれなかった)が、逆に最大でも4枚に限っているから、レイテンシはあまり気にしなくても良いと判断した可能性がある。

ところでInfinity Fabricで接続するということは、逆に言えばキャッシュコヒーレンシが保たれるという意味でもあり、さらに言えば4枚のRadeon Instinct MI50/60に搭載される16/32GBのメモリーが、それぞれ別のアドレス空間にマッピングされることになる。

ということは、このInfinity Fabricを経由して、あるRadeon Instinct MI50/60に搭載されたVega 20コアが、別のRadeon Instinct MI50/60に搭載されたメモリーにアクセスすることも可能になるはずである。実際確認したところ、これは可能という話であった。NVIDIAもUnified Memoryという形でNVLink経由でのメモリー共有をサポートしているが、この点でも並んだことになる。

GPU同士をInfinity Fabricで接続するなら、CPU⇔GPU間もInfinity FabricあるいはCCIXでつないでしまえば、もっと帯域が上がるうえにキャッシュコヒーレンシが取れるのに、という気もするのだが、確認したところ「ROCmが対応してないから無理」という話であった。デバイスドライバーの構造も大幅に変わらざるを得ないため、そうそう簡単には話が進まないのだろう。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第876回

PC

このままではメモリーが燃える! HBM4/5世代に向けた電力供給の限界と、Samsungが示すパッケージ協調設計の解 -

第875回

PC

1000A超のAIプロセッサーをどう動かすか? Googleが実践する垂直給電(VPD)の最前線 -

第874回

PC

AIの未来は「電力」で決まる? 巨大GPUを支える裏面給電とパッケージ革命 -

第873回

PC

「銅配線はまだ重要か? 答えはYesだ」 NVIDIA CEOジェンスンが語った2028年ロードマップとNVLink 8の衝撃 -

第872回

PC

NVIDIAのRubin UltraとKyber Rackの深層 プロトタイプから露見した設計刷新とNVLinkの物理的限界 -

第871回

PC

GTC 2026激震! 突如現れたGroq 3と消えたRubin CPX。NVIDIAの推論戦略を激変させたTSMCの逼迫とメモリー高騰 -

第870回

PC

スマホCPUの王者が挑む「脱・裏方」宣言。Arm初の自社販売チップAGI CPUは世界をどう変えるか? -

第869回

PC

半導体プロセスの新たな覇権! インテルのDNNプロセッサーはAMDやMetaを凌駕する配線密度と演算密度 -

第868回

PC

物理IPには真似できない4%の差はどこから生まれるか? RTL実装が解き放つDimensity 9500の真価 -

第867回

PC

計算が速いだけじゃない! 自分で電圧を操って実力を出し切る賢すぎるAIチップ「Spyre」がAI処理を25%も速くする -

第866回

PC

NVIDIAを射程に捉えた韓国の雄rebellionsの怪物AIチップ「REBEL-Quad」 - この連載の一覧へ