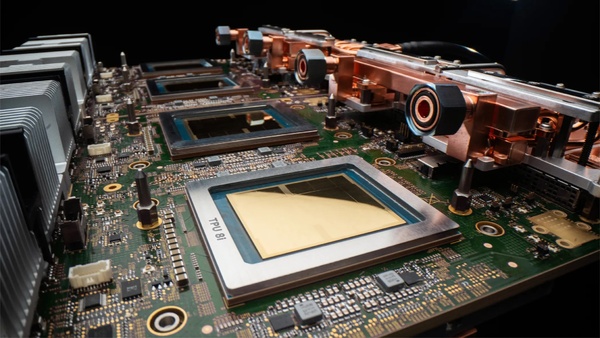

チップは分けられた。グーグルは4月22日、第8世代TPUとして、学習向けの「TPU 8t」と推論向けの「TPU 8i」を発表した。2026年後半に一般提供予定。

初めてTPUを役割別に分けたのが最大の特徴だ。グーグルは数年前から、生成AIの推論需要が大きく伸びると見ていたとしており、エージェントAIの台頭によってその読みが現実になった。

TPU 8tは、学習のための怪物的な性能を持つ。1つのスーパーポッドで最大9600チップ、2ペタバイトの共有高帯域メモリに拡張でき、前世代のIronwood比でポッドあたり約3倍の計算性能をうたう。これにより、グーグルは最先端モデルの開発サイクルを「数ヵ月から数週間に」縮めることを目指している。

一方のTPU 8iは、“待ち時間をどれだけ消せるか”を突き詰めた実直なモデルだ。288GBの高帯域メモリと384MBのオンチップSRAMを搭載し、前世代より3倍のSRAM容量を確保。グーグルでは前世代比で80%高い性能単価を実現し、同じコストでほぼ2倍の推論需要をさばけるとしている。

またグーグルは、データセンターでは半導体供給だけでなく電力も制約条件だとして、TPU 8tと8iは前世代Ironwoodに対して最大2倍の性能電力比を実現するとしている。

グーグルはCloud Nextで企業向けAIエージェント群を打ち出しており、8t/8iシリーズの発表はその文脈を強化するものだ。NVIDIA対抗という側面からとらえるよりも、Google Cloud全体を“エージェント時代の受け皿”として売るための戦略といえそうだ。

本記事はアフィリエイトプログラムによる収益を得ている場合があります