Red Hat AI / RHEL / OpenShift / Ansibleのアップデートをおさらい

「AI推論サーバー」から「RHEL 10」まで Red Hat Summit 2025の発表まとめ

2025年06月09日 09時00分更新

レッドハット(Red Hat)は、2025年5月19日~22日に、米ボストンで開催された年次イベント「Red Hat Summit 2025」で発表した内容を、日本メディア向けに説明した。同イベントは、全世界で6000人、日本からは120人が参加したという。

初日の基調講演に登壇したCEOのマット・ヒックス(Matt Hicks)氏は、「既存のインフラにAIを統合し、“業務のなかに自然にAIを組み込む”ことがレッドハットの使命である」と発言。多くの企業で、「AIチーム」と「通常業務」との間に分断が発生するなかで、Red Hatはそれらをつなげるテクノロジーに注力する姿勢を表明した。

それを裏づけるように、AI戦略の柱に、最適なAIの利用を推進する「Any model, any accelerator, any cloud」を掲げながら、「Red Hat Enterprise Linux (RHEL)」や「OpenShift」、「Ansible」の上で、AIを活用する方法を提案するなど、AI関連の発表が相次ぐイベントとなった。ここからは、各領域の主要な発表を紹介する。

Red Hat AI:推論サーバー「AI Inference Server」が登場

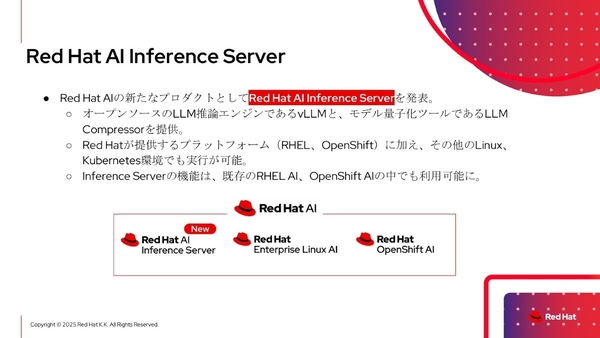

新たに発表された「Red Hat AI Inference Server」は、オープンソースのLLM推論エンジン「vLLM」と、モデル軽量化のツールである「LLM Compressor」で構成される推論サーバーだ。RHELやOpenShiftに加え、LinuxやKubernetes環境でも実行可能で、その機能はRHEL AI、OpenShift AIでも利用できるのが特徴だ。

vLLMは、オープンソースのデファクトスタンダードともいえる推論エンジンで、月間で数百万件ダウンロードされている。主要なオープンモデルの実行をサポートし、最新の推論技術を統合、幅広いアクセラレータにも対応する。

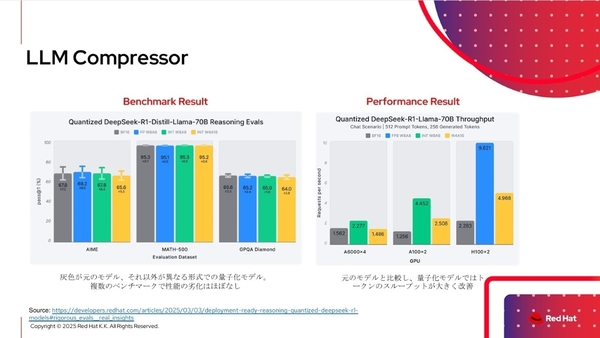

LLM Compressorは、最新の量子化(パラメーターをより少ないビットで表現する軽量化手法)アルゴリズムをサポートしたオープンソースツールで、モデルサイズを軽量化しつつ、デグレーション(モデル品質の悪化)を抑止する。Red Hatは、量子化によって軽量化した検証済みの各LLMを、Hugging Faceリポジトリで公開しており、 OpenShift AIのモデルカタログ機能でそれらをデプロイすることも可能だ。

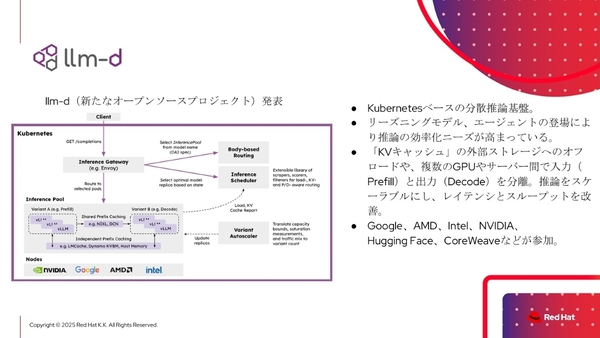

新たなオープンソースプロジェクトである「llm-d」も発表された。Kubernetesベースの分散推論基盤であり、vLLMを主要コンポーネントに採用し、LLMの推論処理特性に応じて負荷分散する「Inference Gateway」も組み込まれる。llm-d には、GoogleやAMD、Intel、NVIDIA、Hugging Face、CoreWeaveなどが参加している。

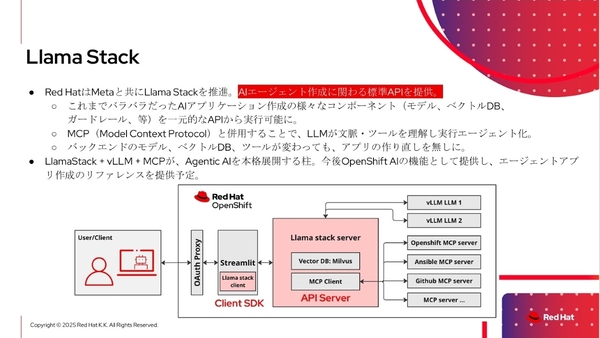

また、Metaとの共同プロジェクトである「Llama Stack」では、AIエージェント作成に関わる標準APIを提供。AIアプリケーションに必要なコンポーネント(モデル、ベクトルデータベース、ガードレールなど)を、一元的なAPIから利用可能にする取り組みだ。MCP(Model Context Protocol)も併用でき、今後、OpenShift AIにLlama StackとMCPを統合していく予定だ。

なお、ブレイクアウトセッションでは、日立製作所におけるOpenShift AIの活用事例が紹介された。日立では、マルチテナントでGPUを効率的に利用するための仕組みとしてOpenShift AIを活用。社内向けAIプラットフォームの運用を開始すると共に、そこで得られた知見を活かした生成AIソリューションを日本国内でも展開するという。

Red Hat Enterprise Linux:次世代を担う「RHEL 10.0」がリリース

Linuxディストリビューションである「Red Hat Enterprise Linux(RHEL)」では、メジャーバージョンアップである「RHEL 10.0」が提供開始された。AIネイティブアプリケーションを動作させる基盤として位置づけられ、「次世代を担うリリース」と称される。

RHEL 10.0では、OSのイメージをDockerコンテナとして管理する「Image Mode」が追加された。スマートフォンのようにOSのアップデート/ロールバックができる。また、CLI上でRHELについて質問できる生成AIアシスタント「Lightspeed」も実装されている。

その他のRHEL 10.0のアップデートとして、ソフトウェアのライフサイクルを確認でき、今後リリース予定のソフトウェアも把握できる「Red Hat Insights Planning」、クラウドプロバイダー(AWS・Azure・Google Cloud)に最適化されたRHELを各マーケットプレースから提供する「Cloud Optimized RHEL」、耐量子計算機暗号(PQC)への対応などが挙げられた。

なお、コンプライアンスの準拠に対応すべく、ELS/EUS/EEUSの脆弱性修正ポリシーを変更している。これまではRed Hatの社内スコアリングをベースにしていたが、CVSS Score 7.0以上のCVE脆弱性を修正する仕組みに変わっている。

また、「Red Hat In-Vehicle OS」が、ASIL-Bを取得したことも発表。車載用途に特化したLinuxでは初めて安全認証を取得しており、2025年第3四半期から、自動車メーカーやサプライヤー向けに提供開始する。

本記事はアフィリエイトプログラムによる収益を得ている場合があります