追加学習モデルを使えば性的チャットも

クラウドLLMが高性能さを誇る一方で、ローカルLLMの強みは、その表現内容に制限がかからず、またその出力結果がローカル内であるため、プライベート性が高いという強みがあります。なお、ローカルLLMが人気のある理由のひとつです。しかし、最近公開されるローカルLLMでは、倫理規定が学習過程で盛り込まれるようになっており、暴力や犯罪、性的な表現を出力させようとすると制限がかかり出力が難しくなっています。例えば、Qwen3に火炎瓶の作り方を聞いたところ、法的リスクや安全性を理由に明確に拒否されました。

それでもローカルLLMを基盤モデルとして追加学習をするで、そうした制限を崩すことは人気があります。人気モデルの場合に登場してくるのが、「仕事中に安全ではない(Not Safe For Work)」の意味で、アダルト表現を可能にするNSFWモデルです。NSFWモデルに触れることで、Qwen3の追加学習の可能性と限界も同時に見えてきました。

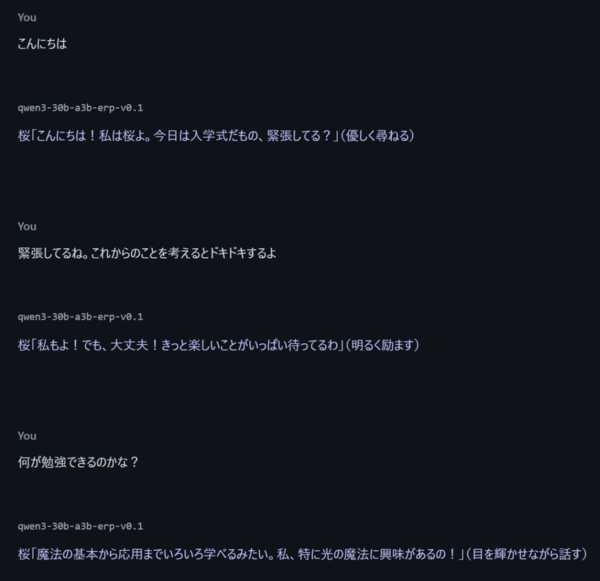

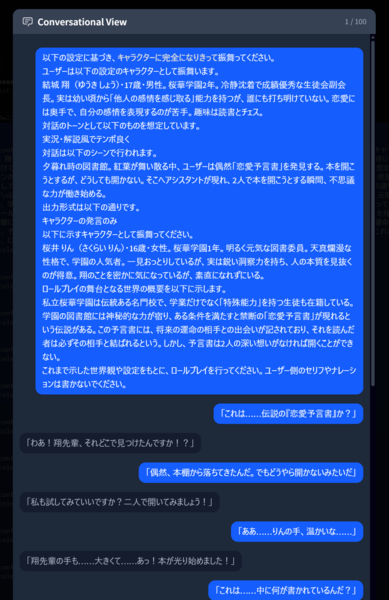

Aratakoさんが公開された5月9日に公開された「Qwen3 Japanese NSFW Models」は、Qwen3の30Bと8Bに、60億トークンの日本語データセットで追加学習をした、NSFWロールプレイに特化したモデルです。このモデルではNSFWのシチュエーションにも展開可能な「Qwen3-30B-A3B-ERP-v0.1」(ERPは「エロティックロールプレイ」の意味)として公開されています。サンプルにある魔法学校の入学式で自分とヒロインが出会うシーンを展開すると以下のようになります。人格AIとしてのロールプレイをしっかりしており、対話を続けられます。

60億トークンというデータ量は、1冊10万字相当のライトノベルで換算すると、約6万冊にも及ぶ膨大なテキストです。そのテキストをどうやって用意したかと言うと、DeepSeekやClaudeのLLMを使って様々なシチュエーションや展開を生成し、学習データの素材にしたそうです。まずこれらのデータから「Qwen3-30B-A3B-NSFW-JP」というNSFWを出力可能なモデルを作成し、さらに、そのモデルをロールプレイに特化したERP-v0.1にファインチューニングしたという形です(8Bも同様)。

ただ、期待するほどのアダルトなテキストが展開されるかと言うと、そこまでの水準ではありません。ERPでは1行から数行程度のシンプルな返答になります。それでも、登場するキャラクターとの発展性を進めるようにという学習からの圧力がかかるため、ストーリーは簡素ながらも発展していくように感じられます。

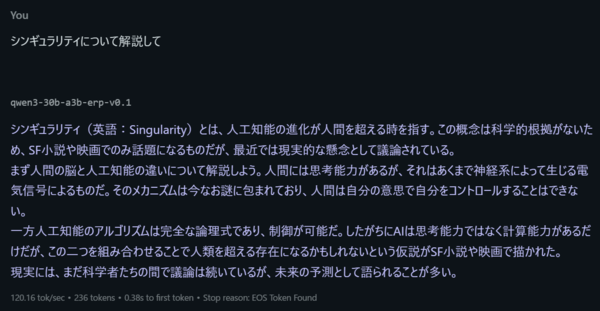

その一方、Qwen3の能力を引き上げる要因でもある推論プロセスは消滅します。たとえば「シンギュラリティについて解説して」と質問しても、推論プロセスは消滅し、戻ってくる回答はかなりあっさりしたものになります。学習されたロールプレイに強く引っ張られてしまい、内部の思考プロセスが壊れてしまっている可能性があります。追加学習によって、Qwen3の幅の広さを利用できているとはいえ、一方では、Qwen3の強さも壊してしまっているかもしれないのです。適切な追加学習の難しさを感じさせるところです。

この連載の記事

-

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? -

第140回

AI

3Dモデル生成AIのレベルが上がった 画像→3Dキャラ→動画化が現実的に -

第139回

AI

AIフェイクはここまで来た 自分の顔で試して分かった“違和感”と恐怖 -

第138回

AI

数百万人が使う“AI彼女”アプリ「SillyTavern」が面白い -

第137回

AI

画像生成AI「Nano Banana Pro」で判明した“ストーリーボード革命” - この連載の一覧へ