AIを使った偽音声による「判別できないオレオレ詐欺」の恐れ

―― AIの悪用についておうかがいしたいと思います。最近では、AIで作成した音声や動画を利用する投資詐欺があったり、海外ではディープフェイク動画を使った「いじめ」がすでにあると聞きます。

栗山 特に、有名人の成りすまし詐欺は目立っていますね。本当にうまくできているので、目で見て判断しないほうが良いのかなと思います。

―― あの詐欺は広告で被害者を釣ったあと、チャットのような一種の閉鎖空間に誘い込み、同調圧力などでお金を差し出すよう誘導する手口です。一律で無視することが重要ですね。

栗山 私はMetaさんやXさんに、うち(マカフィー)の「AIでAIを制する」対策ツールはいかがですか、と言いたいところですが(笑) ……現状でも、音声が合成された動画か否かは瞬時に判断できますので。

高橋 そろそろ対策ツールはSNSの基本機能として内包してもらいたいですよね!

栗山 ただ、うちのツールは「合成されていると判断された動画」をあえてブロックまではしません。「合成された可能性が高いですよ」とアラートをあげるまでです。なぜかと言いますと、世の中には音声を合成したパロディー動画がたくさん存在するからです。

たとえば、気心の知れたお友達の誕生日ににそういった動画を投稿することもあるでしょう。「相手も合成だと承知しているもの」も存在するという前提でツールを動かしています。あくまでもご本人に判断していただきます。

なお、お子さんが使っていてアラートが出た場合、保護者が可否をコントロールするファンクションもありますので、最終的にブロックしていだくことは不可能ではありません。そういった一連の行動を私たちはペアレンタルコントロールと呼んでいて、保護者のみなさんにコントロールする余地を残しています。

また、子どもと同様に、遠方で暮らしていらっしゃるご高齢の両親や祖父母も心配ですよね。未成年のお子さんとは異なりますが、同じようにケアが必要となります。

たとえば、オレオレ詐欺と言えば、「声が違うね」「いや風邪引いたんだ」というようなやりとりが有名ですが、サンプルさえあればAIで声を合成できてしまうので、受話器越しではまったく判別つかない偽の音声を作られてしまう恐れもあります。

防犯機能付きの電話機に買い替えることも対策の1つ

AIで作った詐欺音声を、マカフィーの「AI検知」で発見する

―― 対策はあるのでしょうか? あらかじめ自分の子どもの声を収録しておいて、連絡がニセモノかどうかを判断する……?

栗山 私も関わっている音声ディープフェイク検知技術「McAfee Deepfake Detector(旧称:プロジェクト・モッキングバード)」にもつながりますが、AIによる検知を用いることで、音声は周波数帯を見ることで合成か否かを判別できます。

つまり、本人かどうかではなく、合成されている音声か否かを探ります。AIを悪用した手口には、やはりAIで対抗するしかないのです。

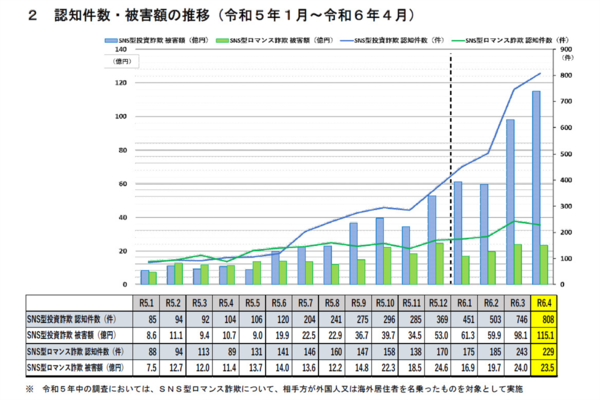

高橋 現在話題になっている詐欺にはAIが当たり前のように使われます。有名人がビデオ通話にオンラインで参加していると聞かされたうえで、ディープフェイクの音声や動画を見せられ、「いくらをいつまでにここに振り込んで」と言われるわけですから、それを被害者が人力で見破ることは非常に困難です。

そのため、AI生成されたものにメタタグを埋め込もうという流れが起きています。これがうまく回り出せば、少なくともマカフィーさんの対策ツールなどと併用することで判別は容易になります。SNSにアップされた時点で「AI生成物が組み込まれているか否か」は明記されるようになるでしょうし。

栗山 ちなみに、「IT系の会社に勤めているので私は大丈夫だろう」と思っている人こそ詐欺に引っかかるのです。実際、テクノロジーに詳しいパートナーさんからも「自分を過信してしまい、あっさりクレジットカード情報を持って行かれた」という方もいらっしゃいました。

高橋 過信が一番危ないのですね。もはや見破ることは無理だと思っていて、私も必ず検索して詐欺被害の有無を調べます。具体的には、出演している本人のアカウントや国民生活センターのサイトですね。そして本文リンクや電話番号には触らない、という対応は絶対です。

本記事はアフィリエイトプログラムによる収益を得ている場合があります