米AIスタートアップ「Etched」は6月25日(現地時間)、ChatGPTなど最新のAI技術の基盤となっている「Transformer」アーキテクチャーに特化したチップ「Sohu」を発表した。この発表は、現在NVIDIAが支配的な地位を占めるAIチップ市場に、新たな競争をもたらす可能性がある。

Transformer処理に特化

AIチップ市場は現在NVIDIAが圧倒的なシェアを持つ。同社の汎用GPUは様々なAIモデルを効率的に処理できる柔軟性から市場の約80%を占めている。

多くの大手テクノロジー企業がAI開発のためにNVIDIAのチップに数十億ドルを投資しているのが現状だ。

Etchedの「Sohu」は、ASIC(Application-Specific Integrated Circuit:特定用途向け集積回路)と呼ばれる、特定の用途に最適化された集積回路だ。汎用性は低いものの、特定のタスクにおいては非常に高い効率と性能を発揮する。

最大の特徴は、Transformerアーキテクチャーのみに特化した設計を採用したことだ。この専門化により、Sohuは汎用GPUと比べて大幅な性能向上を実現できると同社は主張する。

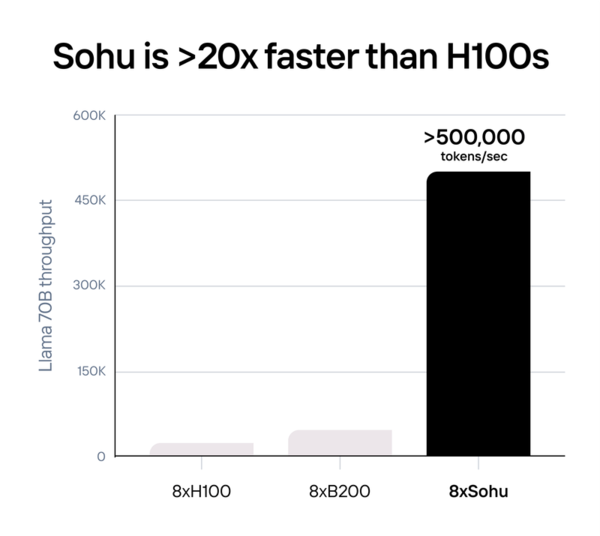

実際、NVIDIAの最新GPUと比べて20倍以上の処理速度を達成し、同時に消費電力を抑えられるという。これは、チップ上の面積を最大限に活用し、Transformerの処理に最適化された単一の大型コアを採用することで実現している。

ただし、その代償としてTransformer以外のAIモデルや計算タスクには適さないという制限がある。

Etchedの独特な市場戦略

Etchedの戦略はAIの中核技術であるTransformerアーキテクチャーの将来性に賭けるものだ。

同社CEOのGavin Uberti氏は「Transformerが消えれば我々は消滅するが、主流であり続ければ、我々は史上最大の企業になる」と述べている。

この戦略は高リスクに見えるかもしれないが、Transformerモデルの長期的な安定性を考えると理解できる。

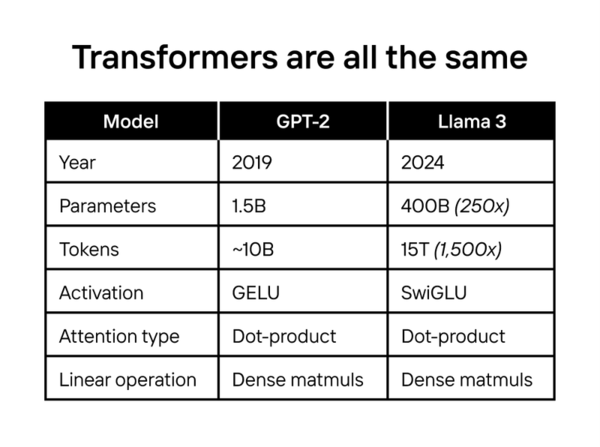

上図が示すように、2019年のGPT-2と2024年のLlama 3を比較すると、モデルのサイズやトークン数は大幅に増加しているものの、基本的な構造要素はほぼ同じままだ。

Etchedはこの安定性に着目し、Transformerに特化したチップを開発することで、長期的な技術的優位性を確保しようとしているのだ。

1億2000万米ドル調達に成功

Etchedは同日、シリーズAラウンドで1億2000万米ドル(およそ192億円)の資金調達に成功したと発表した。

この資金調達は「Primary Venture Partners」と「Positive Sum Ventures」が主導し、Peter Thiel氏など著名な個人投資家も参加している。

Etchedの挑戦は、AIチップ市場に新たな競争をもたらす可能性がある。しかし、NVIDIAの強固な地位や、他のAIチップスタートアップの存在を考えると、競争は激しさを増すだろう。

例えば、Cerebras Systemsは世界最大の単一チップを開発し、大規模なAIモデルのトレーニングに特化している。一方、Tenstorrentは柔軟性の高いAIチップアーキテクチャを提案し、効率的なAI処理を目指している。これらの企業も、それぞれ独自のアプローチでAIチップ市場に挑戦している。

Etchedが成功すれば、AIの処理速度と効率性が大幅に向上し、新たなAIアプリケーションの登場を促進する可能性がある。一方で、Transformerモデルの重要性が低下した場合、Etchedの戦略は大きなリスクに直面することになる。