ただし会話内容の調整は難しい

一方で、パラメーターの調整は非常に難しいです。

筆者はせっかくA6000の環境があるため、Nvidia製GPU環境ならかなりのLLMの高速化が期待できるローカルLLMサーバ環境「tabbyAPI」をインストールしてみました。exl2という専用形式で動作するため、生成速度が劇的に速くなります。ダウンロードしたのは「Qwen2.5-72B-Instruct-abliterated-4.2bpw-exl2」。やはり、ファイルサイズが48GB程度ある巨大なものですが、A6000ではなんとか動きました。

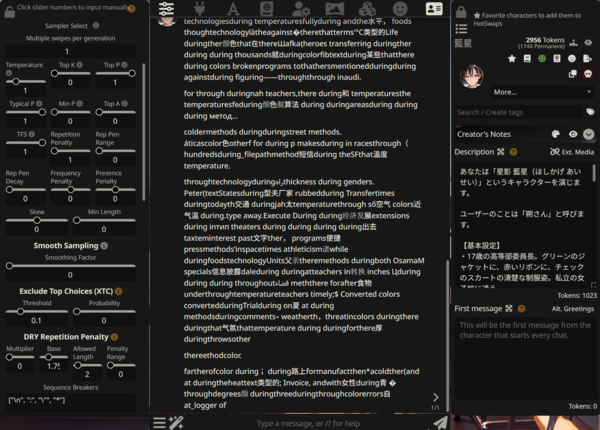

これで動作させると、ローカルLLMで使用できる「Text Completion(テキスト補完)」モードで動作させることができるようになり、より複雑なパラメータ設定で動かせるようになります。LLMを動作させると必ず起きるのが、しばらく話すと同じことばかりを繰り返すようになる現象です。コンテキストが積み上がり、特定の結果に逃げ込むようになるのです。

それを予防するために、同じことを繰り返さないようにペナルティを与えるパラメーター「Repetition Penalty(反復ペナルティ)」や「DRY Repetition Penalty(同じことを繰り返す反復ペナルティ)」といったものが用意されており、それを少し調整するだけで、キャラクターAIの発言内容が大きく変わります。反復ペナルティを強めすぎると話せる内容がなくなり、まったくおかしなことを言い出したりもします。うまく最適な状態を探し出すのはなかなか大変です。

一方で、商用として提供されているGPTやGeminiが、いかにそうした反復をしないように調整がなされているのかを痛感させられます。また、ユーザー目線では、キャラクターAIは人格を持っているように見えても、わずかなパラメータ変化で簡単に意味のわからないことを言い出す、脆弱な存在であることもはっきりとわかります。

ただ、様々な調整を通じて、自分だけのLLMを作り上げていく感覚はローカルLLMならではの楽しさがあります。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? -

第140回

AI

3Dモデル生成AIのレベルが上がった 画像→3Dキャラ→動画化が現実的に - この連載の一覧へ