国内大手データセンター事業者が第1号ノードに 半年後にサービス開始か

既存のデータセンターを「AIファクトリー」に 「Sovereign Grid」が実現する推論データセンター化

2026年05月13日 15時30分更新

「スターゲート」に代表される超大規模な推論データセンターのプロジェクトが進む北米に比べ、遅れをとる日本。2026年5月13日にAI insideが発表した「Sovereign Grid」は、AI InsideのAIスタックで既存のデータセンターを「推論データセンター化」していくというサービスになる。まずは30社1000億円規模の分散推論データセンターを目指す。

3年で今の1000倍のAIに 推論データセンターの領域で後れをとる日本

AI insideは独自のAI基盤や自律型AIの開発を手がける。主力プロダクトのAI OCR「DX Suite」や日本語ドキュメントの処理に特化したLLM「PolySphere」などの開発を手がけており、政府機関や自治体、民間企業など7万ユーザー以上の導入実績を誇る。

発表会に登壇したAI inside 代表取締役社長CEOの渡久地 択氏は、冒頭にAIの進化について言及。コンピュートリソースが年に約3倍増強され、アルゴリズムの性能が同じく年に約3倍程度強化されているため、1年に10倍、3年で1000倍の成長を遂げると指摘した。ただ、3年後に今より1000倍の能力を持つAIを実現するにあたっては、アルゴリズムよりコンピュートリソースの方が課題になるという。

AIの性能をスケールさせる要件として、従来はプリトレーニング(事前学習)されたLLMのパラメーター数が重視されていたが、現在は処理後の効果を学習するポストトレーニング、モデルに長く考えさせる推論の計算時間、そしてモデル単体ではなくエージェントやツールや高度化の3つにフォーカスされるようになっている。「とにかくAIの主戦場は大きなモデルを作ることより、推論をいかに効率化するかに移っている」と渡久地氏は指摘する。

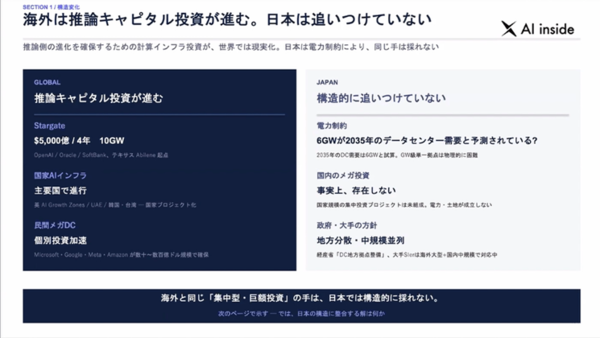

これに対して、北米では推論データセンターの建設ラッシュが加熱している。「スターゲート」プロジェクトでは、4年で5000億ドル規模の投資を行なわれる予定。単一プロジェクトだけで10GWを目指しているが、日本では2035年の時点で6GW程度にとどまるという調査もある。「1社で巨額の投資を行なうのは難しく、日本は構造的に追いついていけない」と渡久地氏は指摘する。

AI insideのAIスタックで分散型の推論データセンターを実現

この現状に対して、国内のデータセンター事業者と提携し、推論のAIインフラを分散グリッドとして構築するのが、今回AI insideから発表された「Sovereign Grid」になる。「かつてのデータセンターはファイルの置き場、サーバーの集積地だったが、これからは『AIファクトリー』になると言われており、LLMを載せて、トークンをどんどん生成していく必要がある。既存のデータセンターをAIファクトリー化するお手伝いをわれわれがやっていく」と渡久地氏は語る。

AI insideがSovereign Gridを提供する背景は、推論に必要なAIスタックをすべて自社で提供しているからにほかならない。推論ハードウェアの「Cube」、同日GAとなった推論オケストレーションプラットフォーム「Leapnet」、そして独自LLMのPolysphereという3層を提供できる強みを活かし、推論データセンターに実装していくという。「中期で100億円程度の推論データセンターを構築していきたい」と渡久地氏。Cubeに関しては、現行機種の144倍の能力のハードウェアを現在開発中だという。

事業者側としては、従来のデータセンターを最新の推論データセンターとして運用できる点が強み。Sovereign(主権)という名前の付くとおり、機密性の高いデータを国内に保持し、ユーザー企業自身がコントロールできる点もメリットとなる。現在、国内大手データセンター事業者と共同事業を検討している最中で、社名も順次公表されるとのこと。「うまくいけば半年でサービスインできる。30社で1000億円規模となれば、グローバルで戦えるレベルに少し近づく」と渡久地氏は抱負を語る。

本記事はアフィリエイトプログラムによる収益を得ている場合があります