Googleは9月29日、同社公式ブログにて「検索窓の枠を超えて:より直感的な検索の実現に向けて」と題し、Google検索とGoogleマップの新機能を紹介した。

9月28日に開催したGoogle検索に関する新機能や方向性を紹介する年次イベント「Search On ‘22」で発表したGoogle検索とGoogleマップの最新の取り組みのなかで、日本でも今後利用できる機能という。

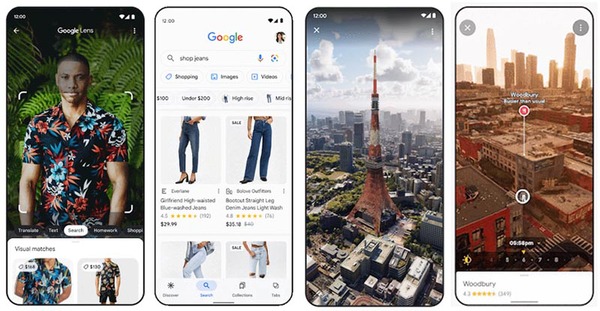

「マルチ検索」は、カメラや画像を使って見たものを検索できるGoogleレンズを使い、撮影した写真やスクリーンショットにさらにテキストを加えて検索できる機能。今年の始めに米国でベータ版として導入しており、今後数ヵ月で日本語を含む70以上の言語に対応する予定。

また、カメラを外国語にかざして画像の中のテキストを翻訳する機能では、複雑な画像の中で翻訳されたテキストをより自然な形で表示できるようになったという。外国語の雑誌にカメラを向けると翻訳されたテキストが自然に背景に馴染んだ形で表示される。年内に公開予定。

さらにスマホの検索結果から洋服、靴、アクセサリーといったファッションアイテムをより簡単に探すことができるようになった。例えば「カーゴパンツ」と検索すると、さまざまな色やスタイルのパンツが、購入可能なサイトや店舗へのリンク、スタイルガイドなどの役立つ情報とともに、より多くの画像で表示されるようになる。

Googleマップの新機能では、調べたいエリアを選択するとユーザーが提供する写真や情報によって人気のあるスポットや見どころを地図上に表示。たとえばパリを旅行する場合、その地域がおしゃれな雰囲気か、 地元の人気スポットがどこかなど、あらゆる情報を一目で簡単に得ることができるという。本機能はAIとGoogleマップユーザーから提供された情報(毎日2000万件以上のクチコミ、写真、ビデオなどが投稿)を組み合わせており、今後AndroidとiOSで展開する予定という。

さらに天候、交通、混雑状況などの重要な情報を重ねて、その地域を多次元なビューで見ることができる新機能も発表された。そのアイディアを進め、今後は予測モデリングを用いて、その場所の過去の傾向を自動的に学習し、明日や来週、さらには来月にその地域がどのような状態になるかを予測できるようにするとしている。たとえば、サンフランシスコにあるオラクルパークに行きたいと思ったとき、その日の計画を立てるのに必要な情報(駐車場や入り口の場所、試合当日の天候が肌寒いかどうか、近くのレストランの場所と中の様子、さらに混雑具合の予測など)を確認できるという。今後、まずは東京、ロサンゼルス、ロンドン、ニューヨーク、サンフランシスコでAndroidとiOS向けに公開する予定。

ライブビューも発展し、より直感的に周囲のものを見つけられるようライブビューから検索するという新機能も発表された。野外マーケットで現金が必要になった時、ライブビューの検索機能を使ってスマホを持ち上げて検索すると、そのエリアにあるATMを瞬時に確認することができるという。コーヒーショップ、スーパーマーケット、乗り換え駅など、さまざまな場所を見つけることもでき、営業時間や混雑状況も表示。場所をタップするとそのお店がどんなサービスを提供しているか、さらに詳しい情報を見ることもできる。ライブビューからの検索機能は、東京、ロンドン、ロサンゼルス、ニューヨーク、サンフランシスコ、パリで、AndroidとiOS向けに今後数ヵ月間にわたって展開する予定という。

本記事はアフィリエイトプログラムによる収益を得ている場合があります