GPUの推論アクセラレーションのみならず推論専用のチップも提供

「A little less conversation,a little more action,please」というエルビス・プレスリーの歌詞を引用した第4幕は、機械学習(ML)がテーマ。「機械学習に関してはいろいろ言われているし、確かに進捗も遅い。でも、一番大切なのは開発者にとって簡単にすることだ」とジャシー氏は語る。

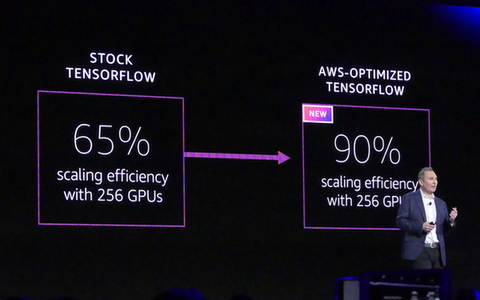

活用までに時間がかかると言われる機械学習だが、AWSではすでに1万以上のアクティブカスタマーがおり、事例も他社の2倍に上るという。AWSでは、機械学習サービスをを3つのスタックに分割しており、専門家向けのインフラ・フレームワークにおいては、機械学習に最適なGPUインスタンスを用意し、多くのフレームワークをサポートしている。たとえば、MLフレームワークとして人気の高いTensorFlowのクラウド上のワークロードのうち、約85%はAWS上で動いているとのこと。ジャシー氏は、「AWSのTensorFlowチームがGPUのスケーリングを改善したことで、256GPUでのリソース利用効率が65%から90%に向上できた」とアピールした。

TensorFlowのスケーリングで最適化を施し、リソース効率が拡大した

新発表としてはAmazon EC2インスタンスにGPUの推論アクセラレーションを追加できる「Amazon Elastic Inference」が挙げられる。コンピュータービジョン、自然言語処理、音声認識などの推論モデルに向け、3つのサイズが用意されている。

また、同じく新発表となる「AWS Inferentia」は機械学習の推論に最適化された専用チップになる。数百TOPSの推論能力を提供し、複数のInferentiaチップで推論スループットを大幅に向上させる。2019年にEC2インスタンスに提供し、Amazon Sage Makerとも統合され、Amazon Elastic InferenceのGPUの代替として利用できるようになるという。TensorFlor、MXnet、PyTorchなどのフレームワークに対応し、ONNXフォーマットのモデルをサポートするという。

ゲストとして登壇したFormula 1のマネジメントダイレクターであるロス・ブラウン氏は、F1というモータースポーツについて、「スピードが最優先であり、イノベーションの競争でもある。何百というエンジニアが空気力学、車体、シャーシ、エンジンについて考えている。立ち止まることはF1の世界では遅れを意味している。技術的に先進的な車がF1のレーシングカーだ」と説明する。

Formula 1 マネジメントダイレクター ロス・ブラウン氏

こうしたレーシングカーの車体には120ものセンサーが搭載され、大量のテレメトリデータが飛び交っている。これらをAWSインフラで分析し、よりよい車体の開発に活かしているほか、ファンとのエンゲージを高めるため、Sage Makerで解析した情報をビジュアル化して提供しているという。「次のシーズンでは、チーム側だけで共有されていた情報をファンにも見せることができるようになる。接戦の時も過去の履歴を比較することで、勝負の行方を予測できるようになる」とブラウン氏は語る。

アノテーションや強化学習まで拡がるSage Makerのフィールド

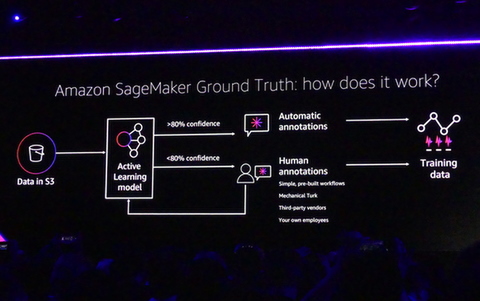

インフラより上位のML領域では、モデルの成否を分けるトレーニングデータセットの構築を容易にする「Amazon Sage Maker Ground Truth」が発表された。ジャシー氏は、「モデルの結果を出すためにはデータのラベル付けが必要になる。コンピュータービジョンにおいては、何千・何万時間の動画を用意し、人海戦術でラベル付けする必要がある。あきらかに高価だし、間違ったラベル付けも多いので、みんなあきらめてしまう」と課題に語る。

その点、Amazon Sage Maker Ground Truthでは、ラベル付けのコストを70%削減できるという。Amazon Sage Maker Ground Truthでは、ラベル付けを行なうS3のデータをポイントし、精度のしきい値を設定する。ある程度の精度を目指すのであれば自動アノテーションを行ない、より高い精度を目指すのであれば人によるアノテーションを実施するという。

Sage Maker Ground Truthの動作

また、アルゴリズムのマーケットプレイスである「AWS Marketplace for Machine Learning」も提供される。Amazon Sage Makerにはいくつかのアルゴリズムがあらかじめ組み込まれているが、これだけではビルダーのニーズに応えられなくなってきたという。そのため、マーケットプレイス化することで、ユーザーは150以上のアルゴリズムから迅速に利用できるようになる。

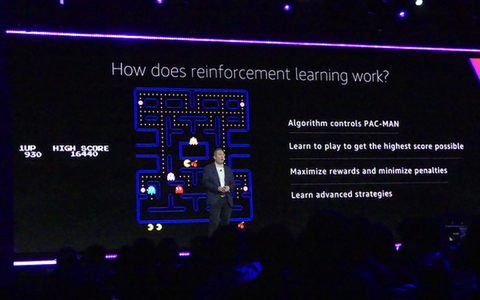

AWSとしてはとにかく機械学習の機会を拡げていく方向性だ。もともと機械学習には教師データありと教師データなしの方式があるが、これとは教師データなしである程度の精度を実現する強化学習(RL:Reinforcement Learning)という方式がある。強化学習の例としてジャシー氏が披露したのが古典ゲームの名作である「パックマン」。パックマンで高得点を得るため、強化学習では点数がもっとも高く、ペナルティがもっとも低くなる動作をシミュレーションでこれらを何度も反復する。「パックマンでは正しい道筋はない。でも、こうした答えのない問題でも、強化学習ならシミュレーションを反復することで、その答えを見つけられる」とジャシー氏は語る。

パックマンを使って強化学習について説明するジャシー氏

この強化学習の民主化を図るのが「Amazon Sage Maker RL」だ。Sage Maker RLでは強化学習のマネージドサービスで、TensorFlowやMXNetはもちろん、Intel Coach、RayRLなどのフレームワークをサポートし、Amazon Sumerianと発表されたばかりのAWS RoboMakerでのシミュレートも可能になっている。

強化学習のマネージドサービスAmazon Sage Maker RL

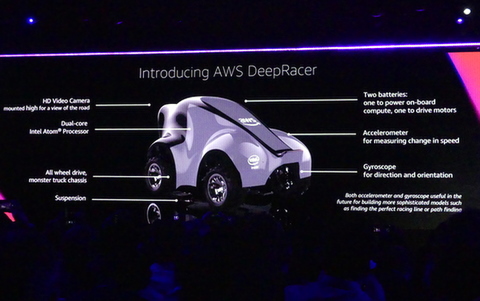

Amazon Sage Maker RLにはノートブックやチュートリアルも用意されているが、「やはり実践することがなによりの学習」とジャシー氏は語る。そのため、強化学習のハンズオンに使える1/18サイズのレースカーである「AWS DeepRacer」も発表された。先ほどのF1の登壇もこのDeepRacerの前振りだったのかもしれない。

AWS DeepRacerにはHDカメラや加速度計・ジャイロスコープを搭載されており、バッテリは演算用・駆動用の2つを搭載する。仮想の車とトラックで3Dシミュレーションさせ、アルゴリズムの学習が済んだら、Sage Maker RLからDeepRacerにデプロイすれば運転が開始される。

強化学習用の教材として利用きるAWS Deep Racer

AWS DeepRacerの提供は、機械学習を学ぶために作られた昨年の「DeepLens」と同じ手法だが、今年はプラス1の取り組みとして、自動運転者のグランプリ「AWS DeepRacer」も発表された。「社員が今日のためにDeepRacerの準備をしているのを見ていたら、彼らはお互いにレースをしている。そのうちチームができて、どんどん本格的になっていった。これは興味深いと思った」ということで、グランプリまで実現する。2019年のAWS Summitでレースを開催し、そのうち上位のメンバーが集まったチャンピオンカップをre:Invent 2019に実施するという。

本記事はアフィリエイトプログラムによる収益を得ている場合があります