TISと奈良先端科学技術大学院大学(以下、奈良先端大)は1月12日、音声・画像・言語などの複数の情報源を用いてロボットと人とのパブリックスペースにおけるスムーズなコミュニケーションをめざす「マルチモーダルインタラクションを用いた対話処理に関する研究」を開始した。研究期間は2015年11月~2016年3月。

マルチモーダルインタラクションは、視覚・聴覚を含め、複数のコミュニケーションモードを利用し、システムとインタラクションを行うこと。今後普及が期待されるロボットとの高度な対話コミュニケーション処理を実現するための重要な技術領域という。今回は、同技術による高度な対話処理を研究する。

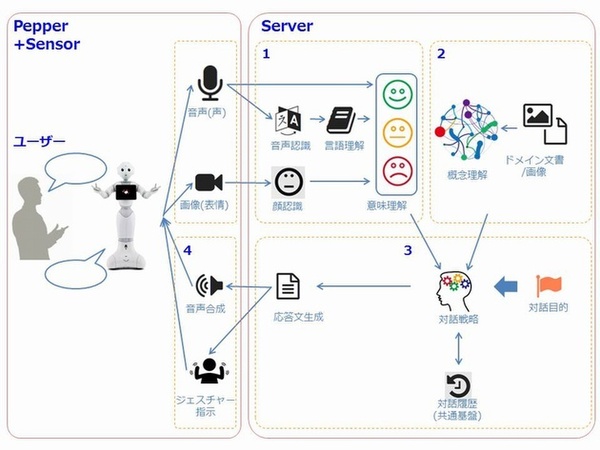

研究項目は、音声、画像、音声認識後のテキストを用いてユーザーの反応を理解し(ユーザー理解)、ユーザーに提案するのに必要な特定ドメインに関する知識構造を構築(ドメイン知識)。それらを基にユーザーにとって最適な提案を行い(対話制御)、ユーザーの感情などを反映した発話やジェスチャーを実現する(発話・ジェスチャー制御)。

TISは「機械学習」「自然言語処理」に関わるAI技術の強化のために「AI技術推進室」を2015年11月に新設し、ビジネス活用に向けた技術研究・検証などを進めている。一方、奈良先端大の情報科学研究科 知能コミュニケーション研究室は、2011年より「対話処理」の研究を行っており、対話に関する国際学会で発表するなど国内でトップレベルの研究成果を出している。

2015年11月~2016年3月の研究により、ロボットの対話機能の高速化、高度化を実現し、ロボットと人との高度な対話コミュニケーション処理のビジネス活用を目指していく。

本記事はアフィリエイトプログラムによる収益を得ている場合があります