スマホが、先回りして動く道具になる。

グーグルは5月12日、Android向けの新機能群「Gemini Intelligence」を発表した。最新のSamsung GalaxyとGoogle Pixelスマートフォンで2026年夏から順次展開し、2026年後半にはスマートウォッチ、ノートPCなどのAndroidデバイスにも提供を拡大する。

Gemini Intelligenceは、Androidを“知能システム”へ変えるためのアップデート。ユーザーがアプリをまたいでこなしていた細かな作業を、Geminiが文脈(コンテキスト)を読んで代わりに進めるのが狙いだ。

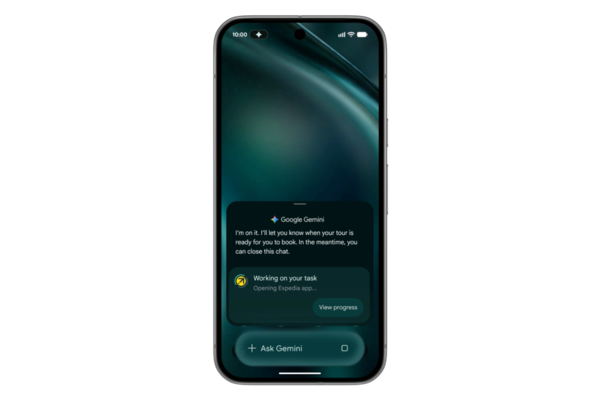

たとえば、Gmailにある授業のシラバスを探し、必要な本をショッピングカートに入れる。メモアプリにある買い物リストを見て、食材の宅配カートを作る。ホテルのロビーで見かけた旅行パンフレットを撮影し、「6人向けに似たツアーをExpediaで探して」と頼むといった複数ステップの作業を、Geminiがバックグラウンドで進められるようになる。

ただし、完全に勝手に動くわけではない。Googleは、Geminiはユーザーの指示で動き、作業が終われば停止し、最後の確認はユーザーがするとしている。

ChromeにもGeminiが入る。Android版Chromeでは2026年6月下旬から、調査、要約、比較を助ける「Gemini in Chrome」が使えるようになる。さらに「Chrome auto browse」により、予約や駐車場の確保のような面倒な作業も代行できるようになる。

あわせてフォーム入力も自動化される。Autofill with Googleは、GeminiのPersonal Intelligenceと連携し、Chromeやアプリ内の細かい入力欄をよりスマートに埋められるようになるという。接続はオプトインで、設定からいつでもオン・オフできる。

音声入力では「Rambler(雑談)」という新機能が加わる。言い直しや繰り返し、「えー」「あの」といった余分な部分を整理して、自然に話した内容を短く整った文章に変換するというもの。複数言語が混ざる話し方にも対応し、音声はリアルタイムの文字起こしに使われ、保存されないとしている。

ホーム画面の新機能では「Create My Widget」が発表された。自然言語で欲しい内容を説明すると、Geminiがカスタムウィジェットを作ってくれるというもの。高たんぱくな作り置きレシピを毎週出すウィジェットや、風速と雨だけを表示する天気ウィジェットのように、必要な情報だけを置いておける。

Gemini Intelligenceは、これまでのようにアプリの横にAIを表示するのではなく、OSの動きそのものにAIを“混ぜ込んでいく”仕組みだ。スマホは、ユーザーが命令を1つずつ入力する端末から、文脈を読んで勝手に作業をつなぐAIアシスタントに近づこうとしている。

本記事はアフィリエイトプログラムによる収益を得ている場合があります