5分程度で“見える”レベルの3D生成

とはいえ、競合他社が目標としていると思われるため、Tencent HY 3Dを調べて、現状の最先端の3D生成の実情を探るべく試してみました。画像から人型のキャラクターを作り、それをアバター方式のVRM形式で扱い、自由にポーズが取り、それを応用するところまでを紹介してみたいと思います。

以前に比べて、3D生成を成功させるコツもはっきりしてきています。Google Deepmindの画像生成AIモデル「Nano Banana」によって「3Dっぽい画像」を作り、リファレンス画像として使う方法です。3D AIは、元々は3Dモデルで学習しているために、リファレンス画像に立体感などの情報が含まれている方が、正確にその形を再現しやすいようです。

たとえば、SF的なキャラクターモデルを作るとします。素材をまずMidjourneyで作成しますが、2Dのアニメ風のままだと、3D生成があまりうまく行きません。特に、顔が板状に解釈されることが多く、失敗する可能性が高まります。

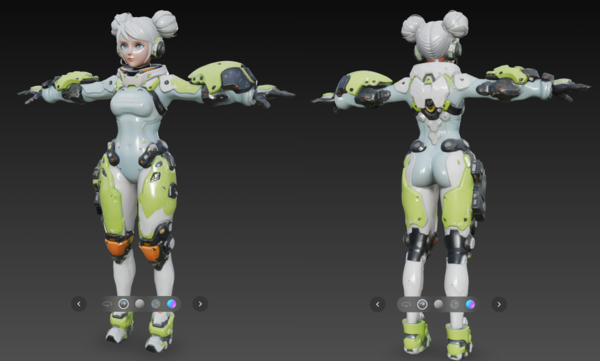

そこで、Nano Banana Proを使って、3Dグラフィックス風の見た目にします。手と身体がモデルとしてくっついたりしないように、3Dモデルの一般的なポーズの「Tポーズ」姿勢になるように指定します。そうすることで、より生成しやすいデザインになります。最低限、前と後ろの二面図があれば、3Dにすることができます。

<プロンプト>

画像1を、3Dグラフィックス風の画像の前と後ろの二面図のTポーズにして。3DCG、リアルタイムレンダリング、実写風。背景は白のシンプルなものに。

Tencent HY 3Dの設定は、生成するポリゴン数を50万(500k)以下に指定して生成します。これは後に、自動でボーン(骨)を入れることができる「Adobe Mixamo」を使うためです。Mixamoは処理できるデータ量に限界があるようで、筆者が試した限り50万ポリゴン以下である必要がありました。

5分ほど待って生み出された生成結果は、それなりの水準で出てきます。ディテールが潰れているなどの問題はありますが、以前に比べるとだいぶ「見える」レベルになってきました。PBR(物理ベースのレンダリング)テクスチャも生成してくれるため、表面のライティングもきちんと反映されています。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第150回

AI

無料でここまで? 動画生成AI「LTX-2.3」はWan2.2の牙城を崩すか -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 -

第147回

AI

ゲーム開発開始から3年、AIは“必須”になった──Steam新作「Exelio」の舞台裏 -

第146回

AI

ローカル音楽生成AIの新定番? ACE-Step 1.5はSuno連携で化ける -

第145回

AI

ComfyUI、画像生成AI「Anima」共同開発 アニメ系モデルで“SDXL超え”狙う -

第144回

AI

わずか4秒の音声からクローン完成 音声生成AIの実力が想像以上だった -

第143回

AI

AIエージェントが書いた“異世界転生”、人間が書いた小説と見分けるのが難しいレベルに -

第142回

AI

数枚の画像とAI動画で“VTuber”ができる!? 「MotionPNG Tuber」という新発想 -

第141回

AI

AIエージェントにお金を払えば、誰でもゲームを作れてしまうという衝撃の事実 開発者の仕事はどうなる? - この連載の一覧へ