次世代ラックスケールシステム「Kyber」を2027年に出荷予定 NVIDIAのエンタープライズ戦略

2025年05月23日 11時00分更新

Physical AIとロボティクスの進化を加速

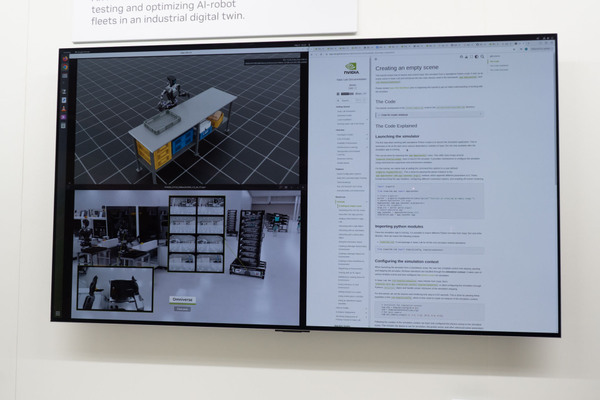

NVIDIAはAIエージェントやPhysical AIの構築環境にも注力しており、展示コーナーではロボットのトレーニングに必要なデータ生成プロセスが紹介された。主にIsaac Simを使って加速空間上でロボットの動きをシミュレーション・再現し、その映像をCosmosという生成AIパイプラインを使ってさまざまな環境に変換する。

これにより、1つのシミュレーションデータから多様な環境に対応するための豊富なトレーニングデータを効率的に生成可能となる。人間が多くの動きをデモンストレーションするのは大変だが、いくつかのデモンストレーションを見ることでAIが大量のデータを生成できるという。加速空間上で膨大な練習を重ねることで、Physical AIに必要な多様な状況への対応能力を高められる。

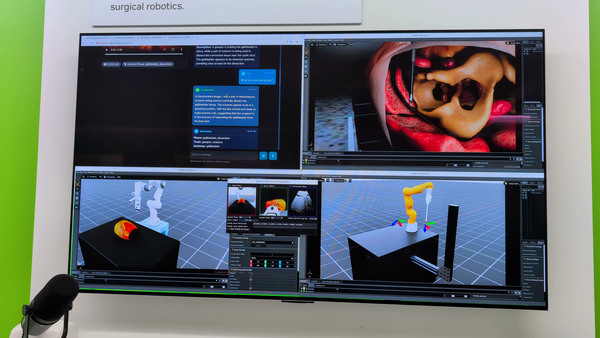

具体的なPhysical AIおよびロボティクスのデモとして、複数の事例が示された。ロボットアームが超音波スキャンを行ない、AIが対象臓器を学習し、画像情報を利用してスキャン方法を学ぶデモ。また、ロボットアームがテーブル上の糸を探し、掴み上げることを学習するデモ、さらに外科手術向けのロボットも紹介された。これらは、データセンターで学習されたAIをエッジデバイスに展開し、物理世界で動作させるというPhysical AIの応用例である。

デジタルツインによる設計・運用・サプライチェーンの最適化

デジタルツイン技術も、エンタープライズにおけるAI活用の重要な要素として強調された。NVIDIA自身、AIファクトリー構築のためにデジタルツインを積極的に活用しているという。実際の構築作業に入る前に、広大な施設の設計を加速空間上でシミュレーションし、電力や熱といったさまざまな要素を検証する。これにより、構築前の時間短縮や、トラブルなく確実に稼働させることが可能になる。稼働中の状態をモニタリングし、生産性を維持するための最適な制御を行なうことにも活用される。

特にデータセンターのデジタルツインについては詳細な紹介があった。その目的は主にふたつ。ひとつは新しいデータセンターを構築する際に必要な要件を理解するためのフレームワークとして。もうひとつは稼働中の既存データセンターの運用データを可視化し、新しいデータセンターのサイズや構成を検討する際の参考にすることだ。

デジタルツイン上では、温度や電気容量などのパラメーターを変更すると、その影響が即座に更新されて表示される。総所有コスト(TCO)の理解が重要であり、特定の構成におけるTCOや運用要件を確認できる。多くのGPUを搭載する高密度構成 や、ラックの列数を増やすといった設定変更も可能。運用シミュレーションでは、障害率や負荷容量などのパラメーターを調整し、過剰効率の状態からフル稼働、さらには障害が発生する状況などを視覚的に確認できる。

このシミュレーションは、電源障害や冷却システムの障害なども含めて実行可能であり、負荷に対する障害発生時期やシステムの自己修正能力を確認できる。シミュレーションは、昨年の10月から12月にかけて30分ごとに取得された実データに基づいているとのこと。

各サーバーの負荷を可視化することもでき、大規模言語モデルや地球モデルなどの計算負荷を確認できる。このデジタルツインモデルは非常に詳細であり、ピンレベルに至るまで忠実に再現されたエンジニアリングモデルが、設計から製造、そして運用に至るまで活用でき、将来のデータセンター計画にも利用されるという。

さらに、異なるエンジニアリング分野間のワークフロー最適化にもデジタルツインが活用される。Cadence、Siemens、Synopsysなどの異なるEDAツールからの設計結果をOmniverseにインポートすることで、電気、機械、ファン設計などの各分野が個別に設計を加速できるだけでなく、Omniverse上で統合的に評価することで全体を効率化できる。

例えば、機械エンジニアは設計変更が基板設計に与える影響を、基板エンジニアは部品配置が放熱やエアフローに与える影響を、Omniverseという共通言語を通じて理解し、効率的なコミュニケーションを図ることが可能。ビデオカードの設計に活用しているデモを展示していたが、NVIDIA自身も40シリーズや50シリーズGPUの開発において、異なるチーム間の連携を通じて設計上の制約を改善するためにこれを活用しているという。

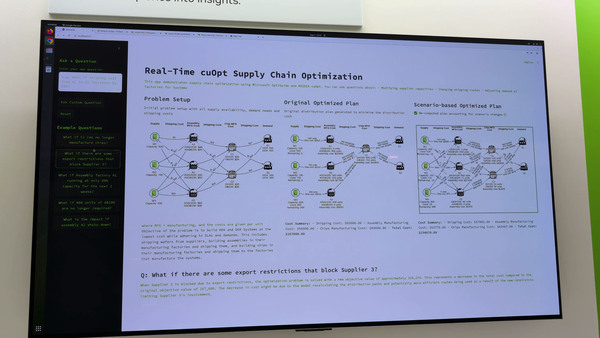

サプライチェーンの最適化にもOmniverseライブラリーが活用される。チップ製造、組み立て、パッケージング、システム構築といったサプライチェーンの各段階における課題に対応するため、従来のプログラミング最適化ソルバーをGPUに移植し、高速化を図っている。

さらに、LLM(大規模言語モデル)と連携させることで、オペレーターが自然言語でサプライチェーンに関する質問、例えば特定の製造コストが10%増加した場合の影響をたずねると、LLMがこれを理解し、アクションシミュレーション結果と合わせて迅速な意思決定を支援する。これはデモ段階であるものの、あらゆるシミュレーションに応用可能な強力な方法であり、仮想世界と物理世界を接続するというアイデアがここでも重要になる。

NVIDIAのAIファクトリーでも活用されており、実際の工場と似たシミュレーション環境を構築、生産ラインからのデータをフィードバックし、生産適用前にシミュレーションと最適化を実行する。

LLMを活用したオペレーター支援により、機械の状態確認や仮想世界でのカメラ操作などが単純な入力で行え、仮想世界で問題修正の練習をしてから実際のアクションに移るといった利用法が可能になる。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第53回

スマホ

クアルコムを抜いたMediaTek、6Gや新Chrombookチップ、NVIDIAとの協業をアピール -

第52回

PCパーツ

“美しさ”と“スマートさ”に注目! Phanteksの新しいPCケース/簡易・本格水冷CPUクーラーをCOMPUTEXで見てきた -

第52回

sponsored

エモいPCケースに最新パーツ搭載、SilevrStone「FLP02」でレトロなPCデスク環境を作れる! -

第51回

ケース

かなり難解。ウッドパズルのようなPCケース「Puzzle」 -

第50回

PCパーツ

無茶なことを考えたな! 3基のM.2 SSDを同時冷却できる水冷ユニット -

第49回

sponsored

be quiet!の音がしないキーボード、着脱式テンキーがおもしろい -

第48回

サーバー・ストレージ

水冷コネクターが日本製で結露が起きない! データセンター構築を簡素化するSupermicro「DCBBS」を見てきた! -

第47回

PCパーツ

Noctuaがポンプのないサイフォン式クーラーのデモを公開 -

第46回

PCパーツ

え?聞いてないよ。Noctuaから掟破りの水冷ユニットが発売予定 -

第45回

PCパーツ

XPGの新CPUクーラーは空冷・水冷それぞれの分野で最新技術と使いやすさを両立、液晶付きでビジュアル面も充実 -

第44回

デジタル

MSIってEV充電製品も出してるの? 日本でも展開予定の製品をCOMPUTEXで見てきた - この連載の一覧へ