rinnaは9月9日、日本語に特化した画像生成モデル「Japanese Stable Diffusion」を公開した。また、このモデルを用いた画像生成サービスも提供開始した。

今回同社は、Stability AIがオープンソースで公開する画像生成モデルStable Diffusionに、日本語のキャプション付き画像を用いて追加学習することで、日本語に特化した画像生成モデル「Japanese Stable Diffusion」を開発。本モデルにより、テキストプロンプトとして日本語を考慮し、翻訳では表現が難しい日本語圏の文化を反映した画像生成が可能になる。AIモデルライブラリー「Hugging Face」と「GitHub」でこのモデルを公開している。

同社のAIキャラクターサービス「キャラる」や、キャラるの公式DiscordでもJapanese Stable Diffusionによって日本語で入力したプロンプトから画像の生成が可能。また、同社のChief AI Communicator「りんな」の特定のツイートにリプライを送るとJapanese Stable Diffusionから生成された画像が返信される。開発者向けに公開しているAPIサイトのrinna Developersにて、本モデルを使用したAPI「Text To Image API v2」を公開中。

Stable Diffusionは、英語のキャプション付き画像から学習されているため、日本語から画像を生成するためには、英語に翻訳したテキストプロンプトを用意する必要があった。しかし、日本語固有の表現(例えば固有名詞、和製英語、オノマトペ)の翻訳が難しかったり、学習データが多い英語圏の文化を色濃く反映した画像が生成されたりするなどの課題があった。

Japanese Stable Diffusionは、学習データとして、LAION-5Bの日本語サブセットをはじめとしたおよそ1億枚の日本語キャプション付き画像を利用している。また、日本語のテキストプロンプトに対応させるために、Stable Diffusionの生成モデルパラメーターを固定し、テキストエンコーダーのみ日本語キャプション付き画像を用いて追加学習を行なった。その後、テキストエンコーダーと生成モデルのパラメーターを同時に更新する追加学習により、さらに日本語の画像生成に最適化している。

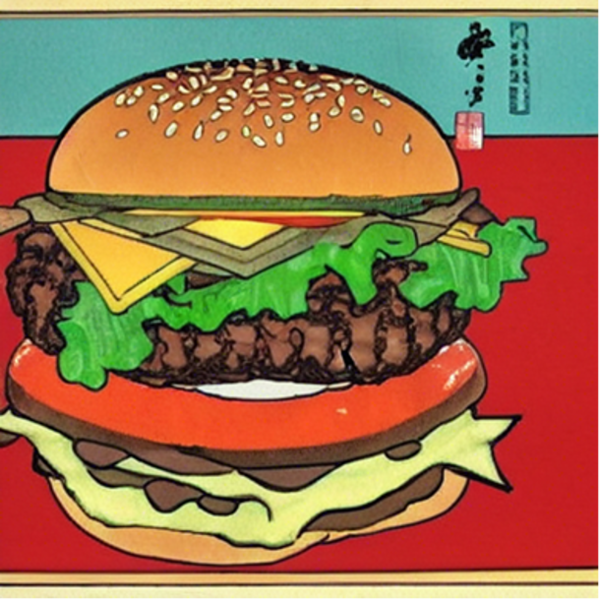

以下は、日本語のテキストプロンプトから生成された画像のサンプル。

本記事はアフィリエイトプログラムによる収益を得ている場合があります