Stable Diffusion入門 from Thailand 第42回

【無料ローカルAI】音声付き動画を生成できる「LTX-2.3」ComfyUIでの使い方をわかりやすく解説!

2026年04月17日 17時00分更新

RTX 4070(12GB)で本当に動くのか

今回検証に用いるRTX 4070(12GB)という環境は、最新の動画生成AIを動かすには本来まだまだ厳しい。モデルの肥大化が進む中、12GBというVRAM容量は「最低ライン」に等しい。だが、SNSなどではこの環境での成功例も多数報告されていたのでダメ元でやってみることにした。

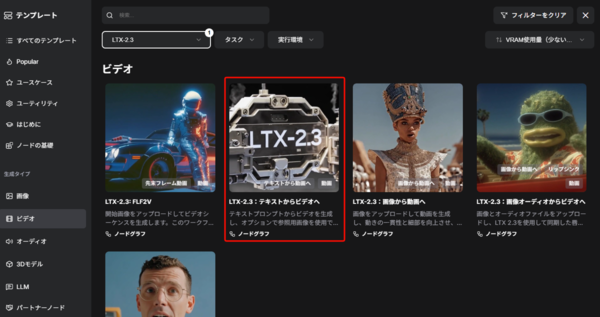

ベースにしたのはComfyUIが提供するデフォルトテンプレート「LTX-2.3:テキストからビデオへ」。テキストエンコーダーにグーグルの「Gemma 3 12B (fp4)」、動画モデルに「LTX-2.3 (fp8)」という軽量な量子化モデルを使用している。さらに起動ファイルの「run_nvidia_gpu.bat」をエディターで開き、ComfyUIの起動オプションに「--lowvram」を指定した。巨大なモデルデータをVRAM内でリレー方式に処理させ、12GBという狭い空間でも計算を継続可能にすることが狙いだ。

まずはテンプレートのデフォルトプロンプト(ロゴアニメーション)を用い、解像度を段階的に引き上げていく方針にした。

768×512/Duration2:生成時間112秒

最初は速度よりも、まずは「動く」ことを確認するため、かなり安全に振った設定で試してみた。VRAMには余裕があるが、メインメモリへのスワップがこの時点で発生し始めている。

1024×576/Duration4:生成時間105.29秒

解像度を一段階上げたところ、なんとさっきよりも速い105秒を記録した。結果的にこれが、この環境では最も速度と画質のバランスが取れた「デフォルト設定」となった。

1280×704/Duration2:生成時間95秒

さらに解像度を上げてみる。生成自体は95秒で完了したが、デコード処理の直後に「WinError 10054(通信切断)」が頻発。GPUメモリの限界を叩いたことでシステムの通信維持に支障をきたしたのかもしれない。

とは言えこのエラーは、深刻なものではなく単なる「UI上のタイムアウト」だ。つまり、12GBのVRAMであっても、計算能力そのものはHD解像度に対応できるということだ。

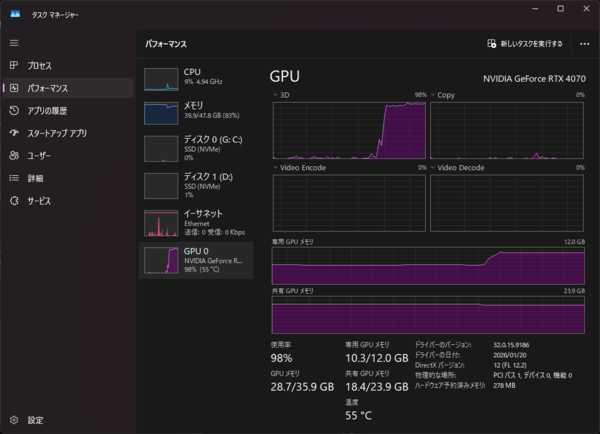

この設定で生成できたとは言え、タスクマネージャーを見てみると、12GBというVRAMの制約がいかにギリギリのラインで運用されているかがわかる。

特筆すべきは、専用GPUメモリの使用量だ。検証中、専用GPUメモリ(VRAM)は10.2GBまで埋まっており、ほぼ限界に近い。ここで処理を支えているのが、18.4GBという「共有GPUメモリ」の存在だ。本来VRAMに収まりきらない巨大なモデルデータを、48GB積載したメインメモリ側へ逃がし、物理メモリ全体で30GB近い「広義のGPUメモリ」として運用している。

この際、システム全体のメモリ使用量も39.9GB(約83%)に達しており、16GBや32GBの標準的な環境ではこの時点でOSごとクラッシュするか、生成が停止していた可能性が高い。なお、GPU使用率が96%とフル稼働している状態でも、温度は63度と安定している。4070の電力効率の良さと、メインメモリによるスワップが、ハードウェアへの過度な熱負荷を抑えつつ完走を支えているのだろう。

とは言え、1280というピーク性能を「出せる」と分かったことは大きい。その上で、実制作におけるトライ&エラーの効率(UIの応答性や生成リズム)を優先し、以降の具体的活用シーンでは1024×576を「この環境でのデフォルト解像度」とした。限界を把握した上で、あえて余裕を持たせて運用するのが不要なエラーに悩まされない現実的な落としどころだろうと考えたのだ。

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第41回

AI

グーグル画像生成AI「Nano Banana 2」が変えた3つのポイント -

第40回

AI

Suno級がローカルで? 音楽生成AI「ACE-Step 1.5」を本気で検証 -

第39回

AI

欲しい映像素材が簡単に作れる! グーグル動画生成AI「Veo 3.1」の使い方 -

第38回

AI

最新の画像生成AIは“編集”がすごい! Nano Banana、Adobe、Canva、ローカルAIの違いを比べた -

第37回

AI

画像生成AIで比較!ChatGPT、Gemini、Grokどれを選ぶ?得意分野と使い分け【作例大量・2025年最新版】 -

第36回

AI

【無料で軽くて高品質】画像生成AI「Z-Image Turbo」が話題。SDXLとの違いは? -

第35回

AI

ここがヤバい!「Nano Banana Pro」画像編集AIのステージを引き上げた6つの進化点 -

第34回

AI

無料で始める画像生成AI 人気モデルとツールまとめ【2025年11月最新版】 -

第33回

AI

初心者でも簡単!「Sora 2」で“プロ級動画”を作るコツ -

第32回

AI

【無料】動画生成AI「Wan2.2」の使い方 ComfyUI設定、簡単インストール方法まとめ - この連載の一覧へ