処理が軽いのも特徴

現在、オープンな動画AIモデルはWan2.2が最も強い状態にありますが、LTXはアーキテクチャを工夫することで、全体的に軽い処理を実現しており、計算時間を大幅に減らすことに成功しています。技術論文によると、H100で1推論ステップをするのにLTX-2は1.22秒に対して、Wan2.2は22.3秒と、18.3倍の速度差があるとアピールしています。

実際、筆者のNVIDIA RTX 4090搭載PCで比べてみると、5秒の720p(1280x720)での生成が、LTXでは約1分なのに対し、Wan2.2(14B)ではVRAMがあふれてしまうため、そもそも生成できませんでした。Wan2.2(14B)では480p(854x480)にまで落とす必要があり、さらに生成にかかる時間は約5分かかりました。要求されるVRAM量も相対的に小さく、オフロードを前提とすればVRAM10GB~12GBでも動作し、16GBでは概ね快適に動作するとしています。

△LTX-2.3の公式Text-to-Videoのサンプルプロンプト。筆者のPCで15秒の生成にかかった時間は1280x720で132秒だった

この軽量化を実現しているのは、アーキテクチャ上の工夫があり、時間を8フレーム、空間を32x32ピクセルをそれぞれ1トークンとしています。Wan2.2では時間を4フレーム、8x8ピクセルを1トークンとしています。例えば1秒間24フレームを生成する場合、0.33秒分の動きを1トークンに圧縮しています。これはWan2.2が0.17秒分の圧縮に比べると2倍近い差が出るので、生成も高速化できるわけです。

激しいアクションには不向き

ただし、このアーキテクチャーには、大きな弱点もあり、圧縮率が高いことで、激しいアクションをさせるとディテールの崩壊が起こりやすくなります。そのため、激しいアクションには向かないようです。

△明日来子さんがカンフーをしている動画。生成された結果は、プロンプトに高速化を指示してもスローモーションになりがちな印象

△LTX-2.3が苦手とするタイプの激しい動き。ゲストキャラの田中さんによる激しい動きでバトンや顔が崩れている

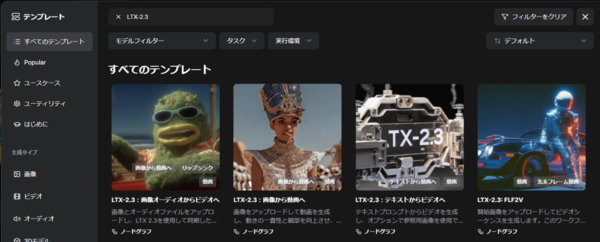

また、品質を上げるための処理方法も、通常の動画AIの方法と比べても、少し変わっています。3段階で生成をしています。LTX-2.3の環境は、ComfyUIの公式テンプレートにワークフローが登録されているため、環境を整えることは容易です。その中に品質を引き上げる方法が組み込まれています。(1)粗く生成して、(2)それをアップスケールして画像サイズをあげ、(3)細かいディテールを作り込んでいくというやり方です。通常の動画AIモデルのように1段階だけで生成するとノイズが大きく、とても見るに耐える水準には達しません。

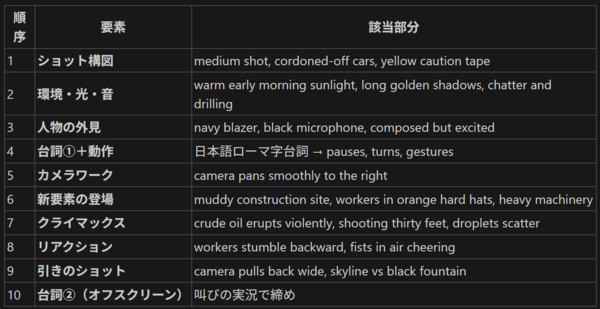

また、テキストエンコーダーにグーグルの「Gemma 3 12B」を使っており、LTX-2.3ではこれまでよりもテキストコネクタを4倍に引き上げたこともあり、プロンプトへの追従力がかなり引き上げられています。そのため、詳細に設定したほうがいいようです。ト書きのように書いて、時系列に指定していくとうまくいく傾向があります。田舎町での油発見のニュースを読み上げるプロンプトを、渋谷で油が吹き出ているという設定に変えています。

英文しか理解しないこともあるため、GeminiなどのAIと共同で作成することをお勧めします。

△渋谷で原油が吹き出したというニュースを作成したもの

本記事はアフィリエイトプログラムによる収益を得ている場合があります

この連載の記事

-

第158回

AI

SDXLの次はこれ? アニメ特化のローカル画像生成AI、驚きの実力 -

第157回

AI

AIだけでゲームは作れるのか? Codexに7本作らせて見えた実力と限界 -

第156回

AI

ChatGPTの画像生成AIは本当に最強か Nano Bananaと比べて見えた“弱点” -

第155回

AI

非エンジニアが数百万円級のツールを開発 画像&動画生成AIツールがゼロから作れた話 -

第154回

AI

ChatGPTの画像生成AIが強すぎる AI画像が世界中に氾濫する時代へ -

第153回

AI

ChatGPTの画像生成AIが「Nano Banana」超え? 漫画や動画風カットが実用レベルに -

第152回

AI

Seedance 2.0×AIエージェントでAI動画が激変 “AI脚本家”や“AI絵コンテ作家”との共同作業で、アニメ制作が身近に -

第151回

AI

画像・動画生成AIの常識が変わる、Claude Codeに全部やらせる方法論 -

第149回

AI

AIと8回話しただけで“性格が変わる” 研究が警告する「おべっかAI」の影響 -

第148回

AI

AIが15万字の小説を1週間で執筆──「Claude Opus 4.6」が示した創作の未来 - この連載の一覧へ